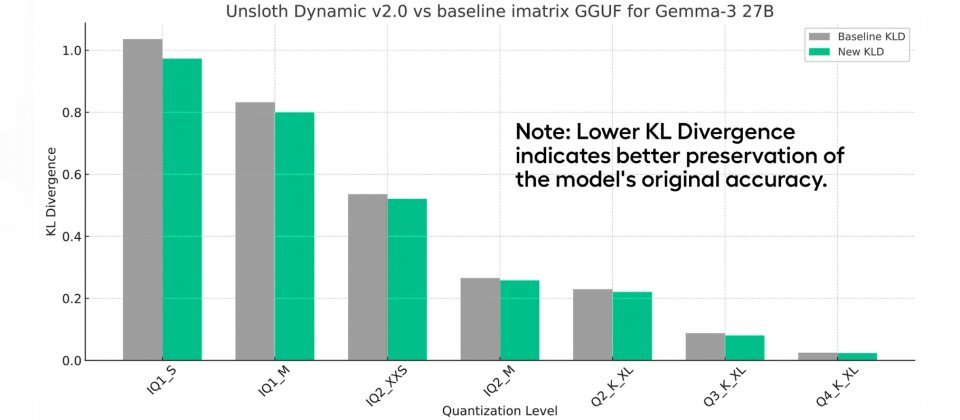

Unsloth Dynamic v2.0在各种量化设置上,相较基准 imatrix GGUF,一致降低Gemma-3 27B模型的KL散度(KL Divergence),显示量化后更能保留原始模型的行为与准确度。

开源大型语言模型微调工具Unsloth团队公开Dynamic v2.0模型量化方法,并表示后续将基于Dynamic 2.0生成和更新GGUF模型文件,供llama.cpp与LM Studio等常见本地推理引擎使用。官方表示该方法着重于在控制GGUF文件大小与量化误差之间取得平衡,使量化后的输出行为更接近原始模型,尽可能保持准确性。

Unsloth是一套大型语言模型微调与强化学习的开源工具,团队近年来也拓展至量化模型文件的发布,以及主流推理框架的兼容性维护。GGUF并非新的模型架构或训练标准,而是llama.cpp生态系统中常用的模型文件格式,通过单一文件封装模型推理所需的所有信息,并借助可扩展的键值型元数据结构,使推理端能更一致地加载模型。

而Dynamic 2.0是对量化方法的升级,主要变化在于针对每个可量化层动态决定量化类型,不再仅处理少数层,且不同模型将采用不同的量化配置。同时,Unsloth表示,后续发布的GGUF量化模型将引入新版校准数据集。官方描述其规模约为150万个词元(Token),用于提升对话型模型在量化后的对话质量与稳定性。

Unsloth指出,此前的Dynamic量化主要适用于混合专家(MoE)架构模型,而Dynamic 2.0已可应用于包括MoE与非MoE在内的各类模型,降低了方法对模型架构的依赖门槛。Unsloth也将Apple Silicon与ARM设备列为性能与兼容性的优先目标,并在文档中明确列出新增的Q4_NL、Q5.1、Q5.0、Q4.1与Q4.0等量化格式,使同一组GGUF模型文件在不同设备与推理引擎间拥有更完整的格式选择。

Unsloth以Gemma 3 27B模型为例说明Dynamic 2.0的性能表现,进行了两种对比测试。在与标准imatrix量化的对比中,Dynamic 2.0在多个量化类型的KL散度(KL Divergence)上均有下降,但GGUF文件大小略有增加,体现出以小幅文件体积增长换取更接近原模型输出分布的收益。

此外,在5-shot MMLU基准测试中,Unsloth的Dynamic 2.0 4-bit量化(Q4_K_XL)得分为71.47,文件大小为15.64 GB。若以Google的QAT版本为基础再应用Dynamic 2.0,得分为71.07,文件大小同样为15.64 GB。相比之下,Google原生QAT版本得分为70.64,文件大小为17.2 GB。Unsloth版本在示例中得分略高且文件更小。