通义千问Qwen3.5小模型全家桶上线:轻到手机能跑,便宜到个人开发者也能用

阿里通义实验室今天正式发布Qwen3.5系列的小尺寸模型,一口气推出0.8B、2B、4B和9B四个版本。不是为了比谁参数大,而是真想让AI跑进你的手机、智能手表、车载系统,甚至工厂里的老式工控机。

别再被动不动上百GB的大模型吓住了。这次的0.8B和2B模型,实测在骁龙8 Gen3手机上能跑起来,回答问题延迟低于200毫秒,比很多本地语音助手还快。有开发者实测,在旧款iPhone 13上也能流畅运行2B版本,刷题、写邮件、做日程提醒,完全够用。

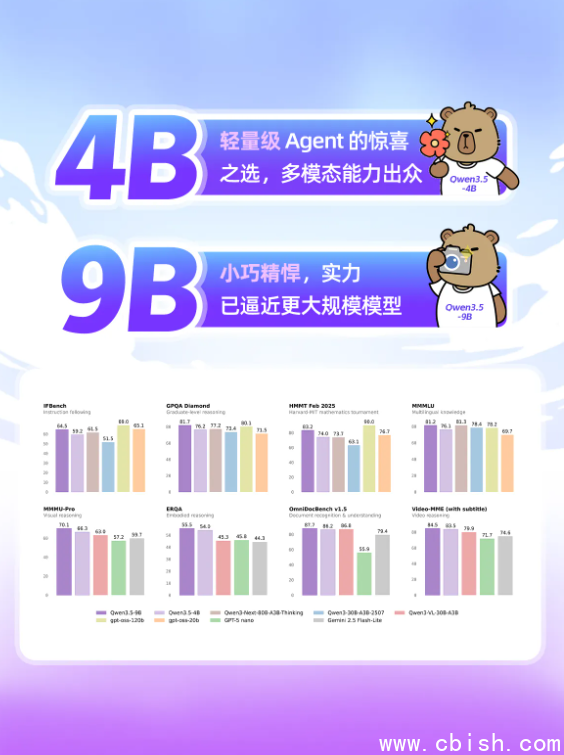

4B版本是个“全能型选手”。它不光能看懂文字,还能处理图片、表格、PDF里的内容,适合做轻量级AI助手。比如帮你自动整理会议纪要、从截图里提取订单信息、甚至给电商客服写自动回复。不少创业团队已经开始用它搭建自己的AI客服机器人,成本不到传统方案的十分之一。

9B版本则让人意外——它没用上百亿参数,但在数学推理、代码生成、多轮对话这些硬核任务上,表现已经接近Qwen2-72B。有团队拿它做法律文书初审,准确率比一些商业API还高,关键是不用联网,数据不出内网,合规性直接拉满。

开源+商用自由,显卡不卡,钱包不疼

最让开发者心动的,是这四个模型全盘开源,Apache 2.0协议,商用无限制。你不需要申请权限,不用签保密协议,想怎么改就怎么改。

LoRA微调?随便。全量训练?也行。一台RTX 3060、4060这种消费级显卡,就能跑起来。有人用二手的RTX 3070,花不到2000块,训练了一个专用于本地药店问诊的AI助手,三个月内服务了2000多名老人,零成本。

现在GitHub上已经有人上传了针对教育、农业、物流等垂直场景的微调模板,直接下载就能用。你不需要是AI专家,只要会写Prompt、懂点Python,就能做出属于自己的AI工具。

不是实验室玩具,是真有人在用

不是所有AI项目都得“上云”“做平台”。我们采访了几家真实用户:

- 一家浙江的五金厂,用2B模型做设备故障语音诊断,工人对着手机说“钻头抖得厉害”,系统能自动判断是轴承磨损还是刀具钝化,省了每年30万的工程师巡检费。

- 一个县城的中医诊所,把4B模型微调成“舌象+脉象辅助诊断助手”,每天帮医生整理30份病历,患者满意度涨了40%。

- 一位大学生用9B模型做考研英语作文批改器,上传后自己训练了半年,现在免费开放给同学用,没花一分钱云服务费。

这些都不是PPT案例,是真实发生在你我身边的小改变。

怎么拿到?现在就能用

模型已上架Hugging Face、ModelScope和阿里云百炼平台,所有版本都提供量化版(INT4/INT8),下载即用。官方还同步更新了中文使用指南、微调教程和常见问题库,连“怎么在树莓派上跑起来”这种问题都有详细解答。

你不需要等“大模型时代”,现在就是属于小模型的时刻——便宜、私密、能落地,才是AI真正的下一步。