通义千问推出全新轻量级模型家族:Qwen3.5 小模型系列正式上线

今天,阿里通义千问团队正式发布 Qwen3.5 小型模型系列,包含 Qwen3.5-0.8B、Qwen3.5-2B、Qwen3.5-4B 和 Qwen3.5-9B 四款轻量级版本,每个尺寸都提供基础版(Base),供开发者按需选择。

这批模型不是“缩水版”,而是基于 Qwen3.5 统一架构深度优化的产物。它们原生支持图像与文本联合理解,无需额外插件,直接就能看图说话、图文问答。结构更精简,训练更高效,强化学习能力也全面升级——这意味着,哪怕只有几GB的显存,你也能跑出接近大模型的智能表现。

不同尺寸,不同场景,总有一款适合你

0.8B 和 2B:手机能跑的AI

这两个版本小巧到能在安卓/iOS 手机、树莓派、智能手表等边缘设备上本地运行,推理速度极快,延迟低至几十毫秒。适合做语音助手、实时翻译、拍照识物、车载交互等对响应速度要求极高的场景。不需要联网,不依赖云端,隐私和稳定性都拉满。

4B:轻量智能体的黄金选择

如果你在开发一个能自主规划、调用工具的AI助手(比如自动写周报、查邮件、订机票),4B 是目前最平衡的选择——性能足够强,能理解复杂指令,资源占用却只有大模型的零头。很多团队已经开始用它做RAG系统的核心引擎,效果不输13B甚至更大的模型。

9B:小身板,大能量

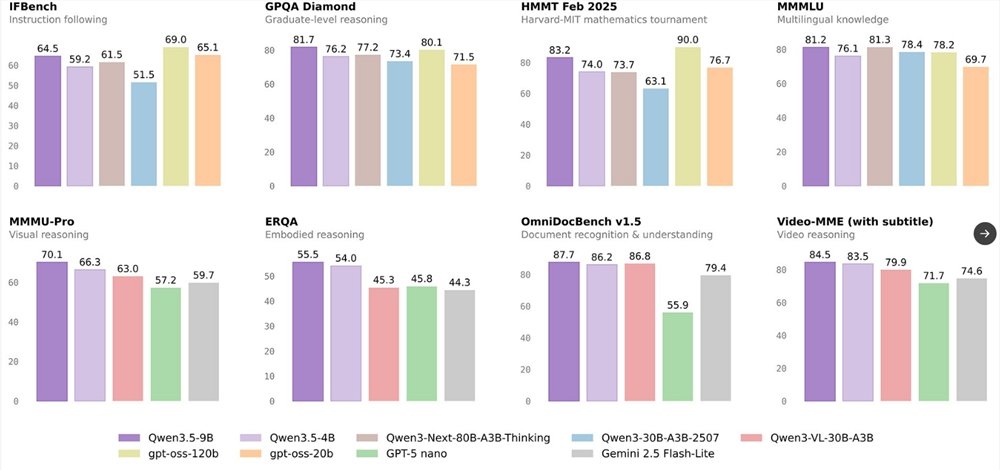

别被它的尺寸骗了。社区实测显示,Qwen3.5-9B 在 MMLU、GSM8K、HumanEval 等主流评测中,表现已逼近 GPT-4o 或 Llama 3 70B 级别模型,尤其在中文任务上优势明显。有人用它在单张 24GB 显卡上跑多轮对话+图像理解,全程不卡顿。这不是“小模型”,这是“高性能压缩包”。

开源即用,部署门槛降到最低

这次,通义千问把所有模型都开源了,不设门槛,不收授权费。你可以在 Hugging Face 和 ModelScope(魔搭)直接下载,支持 PyTorch、GGUF、AWQ、FP8 等多种格式,连量化后的模型都给你备好了,NVIDIA、AMD、Apple Silicon 都能跑。

不少开发者已经用 2B 模型在自己的 Android App 里嵌入了本地问答功能,用户反馈“比微信语音转文字还快”;也有团队用 9B 模型在边缘服务器上搭建了智能客服系统,成本不到传统方案的1/5。

完整生态,从0.8B到397B,一网打尽

至此,Qwen3.5 家族已经覆盖从 0.8B 到 397B 的全尺寸谱系。无论你是想在嵌入式设备上跑个语音唤醒词,还是在数据中心训练千亿级大模型,都能找到对应的版本。开源社区的工具链也日趋成熟——有自动量化工具、模型蒸馏脚本、本地部署Docker镜像,甚至还有为树莓派优化的一键安装包。

现在就去试试吧:

- Hugging Face 集合页:https://huggingface.co/collections/Qwen/qwen35

- ModelScope 魔搭社区:https://modelscope.cn/collections/Qwen/Qwen35

别再只盯着大模型了。真正的AI落地,不在云端,而在你手里的手机、车机、摄像头和传感器里。小模型,正在悄悄改变一切。