DeepSeek V4 正式发布:Flash 和 Pro 双模型上线,价格直击行业痛点

今天,DeepSeek 正式推出新一代模型 DeepSeek V4,不再搞“大而全”的单一模型,而是直接分出两个版本:Flash 和 Pro。一个主打快、便宜、能跑通日常对话;另一个专攻复杂推理、长文本处理和工程级任务。简单说,你要的是效率,选 Flash;你要的是深度思考,选 Pro。

这次更新最实在的,不是参数有多高,而是价格降得狠。以前用大模型,调一次贵一次,企业算成本算得头疼。现在 DeepSeek 把“缓存”玩明白了:同一个问题,你第一次问,按正常价收;第二次再问,系统记得住,价格直接打到十分之一。

举个例子:你做客服机器人,每天有上万条重复提问。用 Flash,缓存命中后,每百万词只要 0.2 元——比一杯奶茶还便宜。就算没缓存,1 元/百万词,也比市面上多数同类模型便宜一半以上。

Flash 和 Pro,到底该选哪个?

DeepSeek-V4-Flash:适合日常对话、内容生成、客服问答、简单摘要。响应快、延迟低,适合高并发场景。你不需要它“想太多”,它只要“答得准、跑得快”。

DeepSeek-V4-Pro:专为复杂任务设计。比如写代码、分析财报、做多步推理、处理长文档(支持 100 万字上下文)、输出结构化 JSON 或调用工具。如果你在做智能代理、自动报告生成、法律或金融分析,Pro 就是你的主力。

两个版本都支持:

- 100 万字上下文(能读完整本《红楼梦》+ 附录)

- 最大 38.4 万字输出(写长文、做报告不用分段)

- JSON 格式输出,方便对接系统

- 工具调用(Tool Calls),能连数据库、查天气、跑程序

- 对话前缀续写(Beta),适合做智能助手的上下文记忆

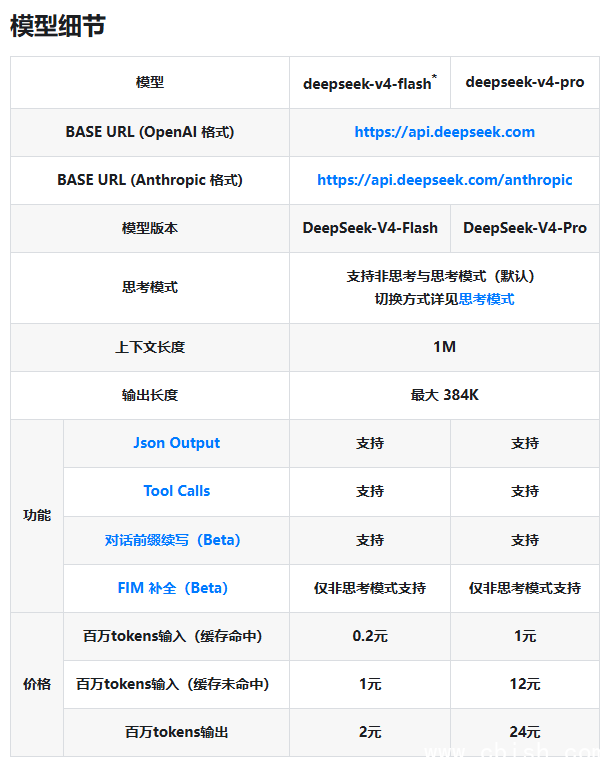

价格表:清清楚楚,没有隐藏收费

官方把价格表贴得明明白白,单位是“每百万 Token”,直接对比:

| 模型 | 输入(缓存命中) | 输入(缓存未命中) | 输出 |

|---|---|---|---|

| DeepSeek-V4-Flash | 0.2 元 | 1 元 | 2 元 |

| DeepSeek-V4-Pro | 1 元 | 12 元 | 24 元 |

扣费顺序也很透明:先用你账户里的免费额度,用完了才扣你充值的钱。没有隐藏服务费,没有调用次数限制,也没有“按并发收费”这种让人头疼的套路。

拿 Pro 来算:12 元/百万输入,意味着你用它分析一份 50 页的年报,大概花不到 0.5 元。而市面上同类模型,光输入就要 30 元起步。

为什么这个价格能改变行业?

过去,国内企业用大模型,要么选国外的,贵得离谱;要么选国产的,效果又不稳定。DeepSeek 这次直接把价格拉到“能用得起”的水平。

尤其 Flash 版本,1 元/百万词(未缓存)的定价,让中小团队、个人开发者、创业公司第一次能用上接近顶级性能的 MoE 模型。你不需要百万级预算,就能搭建一个能自动写周报、做客服、处理工单的系统。

而 Pro 版本,12 元的输入价,让企业敢把大模型用在核心业务里——比如金融风控、法律文书生成、自动化审计。以前是“能用就行”,现在是“用得上、用得起、用得稳”。

更关键的是,它不靠“烧钱补贴”撑价格,而是靠技术优化:缓存机制、推理效率、模型压缩,都是实打实的工程能力。这意味着,这个价格不是短期促销,而是长期可持续的商业模式。

旧模型即将下线,现在就得迁移

官方明确提醒:老的 deepseek-chat 和 deepseek-reasoner 模型,后续将不再维护,API 会逐步关闭。

现在就要开始切换:

- 原来用

deepseek-chat的 → 改用deepseek-v4-flash - 原来用

deepseek-reasoner的 → 改用deepseek-v4-pro

新模型兼容旧接口,改个名字就能跑,迁移成本极低。官方已更新 API 文档,所有参数、调用方式、错误码都列得清清楚楚,没套路。

开发者能做什么?

如果你是:

- 创业公司:用 Flash 做智能客服、内容生成,月成本不到百元。

- 企业技术团队:用 Pro 做自动化报告、合同分析、数据提取,效率提升 50% 以上。

- 个人开发者:用 Flash 写个 AI 小工具,挂到公众号或微信小程序,零成本试水。

- 高校研究者:100 万字上下文,能直接处理整本论文、长篇访谈录音转文字分析。

DeepSeek 没有吹“世界最强”,也没有搞“参数大战”。它只做了一件事:把顶级模型,做成人人都能用的工具。这,才是真正的国产 AI 落地。

官网文档:https://api.deepseek.com