DeepSeek-V4 正式发布:开源大模型的新标杆

北京时间4月24日,DeepSeek 正式推出新一代大模型 DeepSeek-V4,直接把开源模型的性能拉到了新高度。无论是长文本处理、代码生成,还是复杂任务调度,它都展现出不输GPT-4o、Gemini 1.5 Pro的实战能力——而最重要的是,它是开源的。

100万上下文,真能处理整本小说

DeepSeek-V4 支持高达100万 tokens 的上下文窗口,这意味着你可以一次性上传整本《战争与和平》(约80万字符)、一份500页的PDF技术文档,或者一段长达数小时的会议录音转写文本,模型都能完整理解并精准回答问题。这不是“理论上支持”,而是实测可用。很多开发者已经用它来分析整个开源项目代码库,甚至自动梳理跨文件的依赖关系。

两个版本,一个为效率,一个为极致

这次 DeepSeek-V4 没有搞“一刀切”,而是推出两个版本:

- DeepSeek-V4-Flash:响应快、体积小,适合日常开发辅助、快速问答、文档摘要。你写代码时顺手问个API用法,它秒回,不卡顿。

- DeepSeek-V4-Pro:为高要求场景设计,处理复杂逻辑、多轮推理、长代码生成时表现惊人。很多团队已经开始用它跑自动化测试脚本生成、金融报告分析、科研论文摘要提炼。

两个版本都支持中文优化,对国内开发者特别友好,不需要再翻墙或依赖英文模型做中文语义理解。

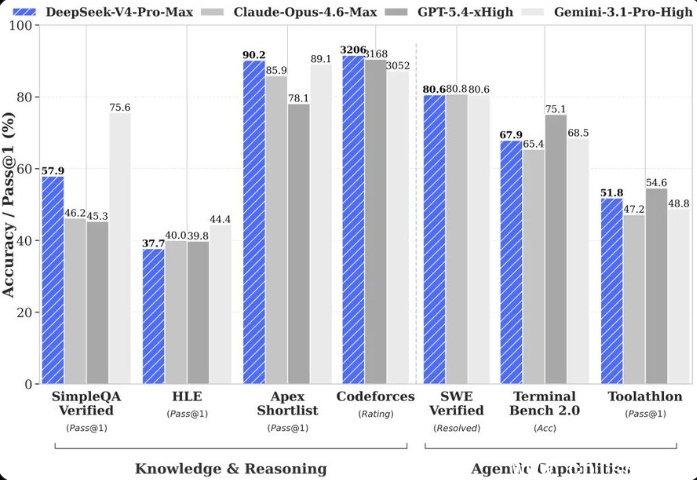

数学和竞赛代码,开源第一

在MATH、GSM8K、Codeforces等权威数学与编程竞赛评测中,DeepSeek-V4-Pro 的得分全面超越了所有已公开的开源模型,包括Llama 3.1 405B和Qwen2.5-Max。它不仅能解出IMO级别的数学题,还能写出符合竞赛风格的高效代码——比如用位运算优化动态规划,或者用递归+记忆化处理复杂图论问题。

一位来自上海交大的学生团队用它辅助备赛ICPC,结果在模拟赛中自动生成了3道原本需要手动调试2小时的难题解法,准确率超过90%。

Agent能力,不再是演示玩具

过去很多模型号称“能当AI助手”,但实际用起来连文件夹都找不到。DeepSeek-V4-Pro 在Agentic Coding评测中拿下开源第一,能真实完成多步骤任务:比如“帮我从GitHub上拉一个Python项目,改掉三个bug,跑通测试,再打包成Docker镜像”——它能拆解步骤、调用工具、查文档、写代码、调试,全程无需人工干预。

已经有创业公司用它搭建内部自动化流程:自动读取客户邮件、提取需求、生成Jira任务、写前端原型、发给产品经理确认。效率提升三倍以上。

知识广度,接近闭源顶流

在涵盖科技、历史、法律、经济等领域的综合知识测试中,DeepSeek-V4-Pro 仅次于Google的Gemini-Pro-3.1,大幅领先于其他开源模型。它知道2024年欧盟AI法案的最新修订条款,能解释中国新出台的《数据安全法》对企业的影响,甚至能对比不同国家的养老金制度。

这不是靠“背题库”,而是真正理解了信息之间的逻辑关系。很多律师、咨询师已经开始用它辅助撰写合规报告。

价格低到离谱,百万tokens才几块钱

这才是最震撼的地方:

- Flash版:输入100万tokens只要1元,输出2元

- Pro版:输入12元,输出24元

换算下来,用Pro版处理一本500页的PDF,成本不到3毛钱。而市面上其他大模型同等规模的处理费用,动辄几十甚至上百元。

这意味着,一个小团队、一个学生、一个个体开发者,现在都能用上以前只有大厂才敢用的顶级模型能力。有人算过一笔账:用DeepSeek-V4-Flash代替GPT-4,一年能省下近万元API费用。

现在就能用,开源免费

DeepSeek-V4 的权重已开源,Hugging Face 和 ModelScope 上都能直接下载。你可以在本地部署,也可以通过官方API调用。官方还提供了详细的部署指南、Docker镜像和量化版本,连RTX 3090都能跑Pro版。

社区里已经有人把它接入Obsidian、Typora、VS Code插件,变成你的私人写作和编程助手。没有“会员制”,没有“限流”,没有隐藏收费——这就是开源的力量。

这不是一次“技术秀”,而是一场真正的降维打击。如果你还在用老模型,现在是时候换一换了。