DeepSeek-V4正式开源:百万字上下文,免费可用

今天,DeepSeek正式发布全新模型系列DeepSeek-V4,并同步开源全部权重。这不是一次普通的升级——这是国内首个在开源模型中实现1M(一百万字)上下文长度稳定运行的系统,而且免费、可商用、无隐藏收费。

你不用再为处理一份500页的PDF、整本小说、长代码库或数十万行日志而头疼。以前,这类任务要么卡死,要么得花几百块买闭源API。现在,你只需要打开Hugging Face或魔搭社区,下载模型,本地跑起来就行。

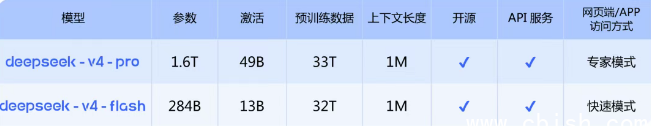

两个版本,按需选择:要性能选Pro,要省钱选Flash

DeepSeek-V4推出两个版本,不玩虚的,直接告诉你怎么选:

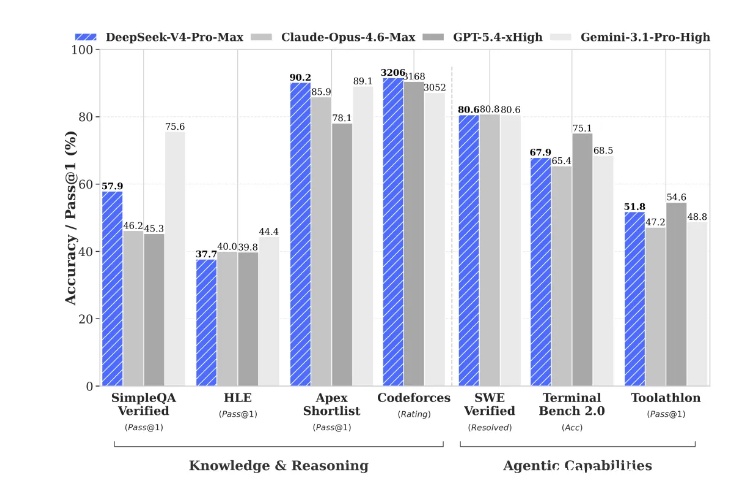

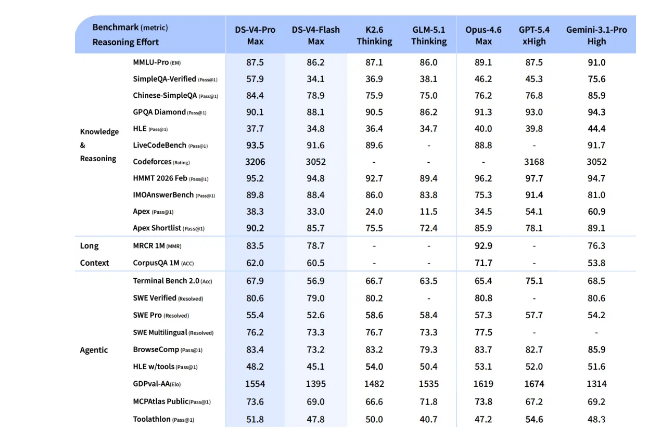

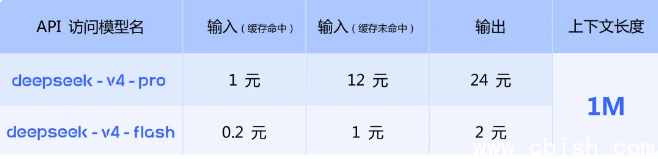

- DeepSeek-V4-Pro(1.6T参数,激活49B):性能直逼GPT-4o和Claude 3.5。在代码生成、数学竞赛题、复杂逻辑推理上,开源模型里没人能打。实测在HumanEval+上得分超过92%,接近闭源顶流。如果你是开发者、研究员,或者需要处理高难度任务,这个版本就是你的主力。

- DeepSeek-V4-Flash(284B参数,激活13B):体积小、速度快、成本低。虽然知识总量略少于Pro版,但在日常任务——写邮件、总结报告、改代码、回答问题上,表现几乎一样好。部署在普通服务器上都能跑,API响应快过多数竞品,适合中小企业、个人开发者和高频调用场景。

为什么能处理一百万字?他们改了模型的“大脑结构”

过去,模型处理长文本慢、贵、吃显存,是因为注意力机制要算所有词之间的关系。一个1M上下文,普通模型需要几百GB显存,根本跑不动。

DeepSeek-V4用了一个叫DSA(Dynamic Sparse Attention)的新机制,不是把所有词都看一遍,而是智能筛选“真正相关”的部分。就像你读一本厚书,不会每个字都死记,而是抓住关键段落、转折点、结论。模型也这么干。

结果是什么?1M上下文不再是奢侈品,而是标配。你上传一份1000页的合同,它能记住每一条条款;你给它一整个React项目,它能理解所有文件间的调用关系。关键是,显存占用只比处理10K文本高一点点。

专为开发者和Agent工具优化,不是摆设

很多模型号称支持Agent,但实际用起来卡顿、反应慢、逻辑乱。DeepSeek-V4不一样——它从设计之初就为CodeBuddy、Claude Code、AutoGPT这类工具做了针对性优化。

它支持两种模式:

- 非思考模式:快速响应,适合日常问答、摘要、翻译。

- 思考模式:开启后,模型会像人一样“慢慢想”,分步骤推理,适合写复杂代码、分析数据、做决策。

API还开放了一个叫reasoning_effort的参数,你可以设为low、high或max,控制它“动脑”的程度。写个脚本?用low,快;调试一个分布式系统?用max,让它慢慢推。

旧模型即将下线,别用错了

从2026年7月24日起,deepseek-chat和deepseek-reasoner这两个旧模型将停止服务。如果你还在用它们,赶紧升级。新模型不仅更强,还支持更稳定的API接口。

现在访问官网或官方App,就能直接体验V4。API文档和调用示例已更新,GitHub和Hugging Face上都有完整教程。

开源地址:现在就能下载

模型权重、推理代码、评估报告,全部公开,无任何限制:

技术报告PDF已同步上传,包含详细评测数据、推理延迟、显存占用、多语言表现等,全是真实测试结果,没修图。

这不只是模型升级,是开源生态的转折点

过去,顶尖AI能力被几家大公司锁在API后面,动辄每千token几美分,中小企业用不起。现在,DeepSeek-V4证明了:开源模型不仅能追上闭源,还能在关键能力上实现突破——而且免费。

你不需要买云服务,不需要交会员费,甚至不需要GPU集群。一张3090,就能跑通1M上下文。这背后的意义,远不止于“又一个好模型”。它让普通人、独立开发者、偏远地区研究者,第一次拥有了和大厂同等级的AI工具。

别再等了。去下载,去跑,去用它写代码、读合同、分析财报。真正的AI普惠,不是口号,是现在就能下载的权重文件。