英伟达发布Nemotron3Super:开源大模型的新标杆

3月12日,英伟达正式推出Nemotron3Super——一款专为AI智能体打造的开源大模型。它不是又一个参数堆砌的“玩具”,而是面向真实场景、能跑得快、做得准、用得起的实用工具。发布当天,开源社区迅速刷屏,开发者纷纷下载测试,原因很简单:它在不牺牲性能的前提下,把推理成本砍掉了一半。

这款模型总参数1200亿,但每次推理只激活其中120亿,类似“只动用最需要的引擎”。这种Mamba-MoE混合架构,让它的响应速度比同类开源模型快3倍,每秒能处理的请求量提升5倍。更关键的是,它能处理长达100万字的上下文——这意味着你可以一次性喂给它一份完整的合同、一整本技术文档,甚至一段长达一小时的会议录音转文字,它都能理清逻辑、抓住重点,不会“忘东忘西”。

真实任务表现:不是榜单数据,是实测结果

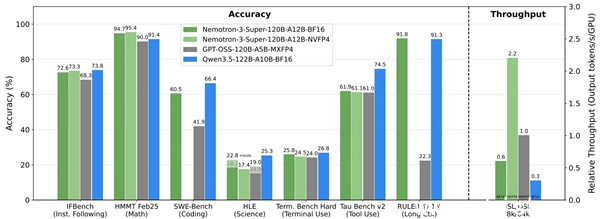

很多模型在榜单上“登顶”,但在实际任务中一碰就碎。Nemotron3Super不一样。在OpenClaw这个以复杂多步任务著称的智能体评测中,它的任务完成率达到85.6%——这个数字,已经接近闭源模型Claude Opus和GPT-5的水平。而它不像那些闭源模型,你得排队、得付费、还得看API配额。

在DeepResearch Bench上,搭载Nemotron3Super的英伟达自研AI智能体,同时拿下“推理准确率”和“响应速度”双榜第一。这不是实验室里的模拟,而是真实环境下的测试:它能自主分析论文、调用工具、生成报告、修正错误,全程无需人工干预。不少开发者反馈:“它不像在‘回答问题’,更像在‘帮你干活’。”

专为英伟达硬件优化,训练成本直降

如果你用的是英伟达最新Blackwell架构的GPU,那Nemotron3Super还能进一步省下一大笔钱。它首次支持NVFP4——一种英伟达自研的4位浮点训练格式,比传统FP8节省近40%显存,训练速度提升30%以上。这意味着,一家中小公司用4块H200就能完成过去需要16块A100才能跑完的训练任务。

不只是训练,推理也一样省。模型支持BF16和FP8两种主流格式,适配现有主流硬件,不需要换设备就能上手。不少AI团队表示:“我们本来在等GPT-5开放API,现在发现,用Nemotron3Super跑本地服务器,反而更便宜、更可控。”

大厂都在用,云平台已上线

这不是一个孤零零的开源项目。发布一周内,Perplexity、Palantir、西门子、戴尔等企业已将其接入内部系统,用于自动化报告生成、客户工单处理、工业设备故障预测等核心业务。AWS、Azure和Google Cloud三大云平台同步上线该模型,开发者可以直接通过API调用,无需自己部署。

更关键的是,它完全免费开源,商用无限制。你不需要签NDA,不需要申请白名单,不需要担心哪天突然涨价或停服。GitHub仓库上线24小时,Star数突破12万,Fork数超过3.5万,成为历史上增长最快的AI开源项目之一。

为什么它能火?因为它不画饼

过去几年,我们见过太多“革命性”模型,但最后都成了PPT里的概念。Nemotron3Super不一样——它不靠宣传语打动人,靠的是实打实的效率、清晰的文档、开放的代码,以及对真实开发者需求的回应。

有人问:“它能替代GPT-4吗?”答案是:它不需要替代谁。它只是给了你一个选择:一个不靠垄断、不靠收费、不靠神秘黑箱,却能干得比很多闭源模型还好的工具。对开发者来说,这比任何宣传都更有吸引力。

现在,你可以在Hugging Face上直接下载,也可以在云上一键部署。不需要技术背景?官方提供了完整的教程和预训练微调模板。你不需要成为AI专家,也能让它帮你干活。