谷歌发布新一代多模态嵌入模型:文本、图片、视频、音频、PDF 一网打尽

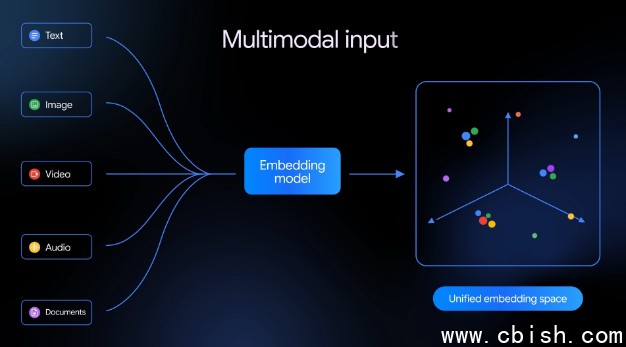

谷歌刚刚推出了 Gemini Embedding2,一个能同时理解文字、图片、视频、音频和PDF文档的全新嵌入模型。过去,处理这些不同形式的内容,你需要用好几个模型——文本用一个,图片用另一个,音频还得转成文字再处理。现在,Gemini Embedding2 把这一切都统一了:你扔进去一张图加一段话,或者一段视频配上字幕,它能直接告诉你它们“说的是同一个意思”。

这不是概念演示,而是实打实能用的工具。开发者现在可以通过 Gemini API 或 Vertex AI 直接调用,无需额外训练,也不用自己写代码去对齐不同模态的数据。你甚至可以一次请求里混合输入:比如上传一张产品图,再加一句“这是我在超市看到的蓝色包装饮料”,系统就能立刻匹配到相似的商品图片或相关商品描述。

支持更长、更多、更原生的输入

新模型在输入能力上大幅提升:

- 文本支持长达 8192 个 token,是上一代的四倍,能完整处理整篇论文、长篇报告或复杂对话记录;

- 单次请求最多可处理 6 张 JPG/PNG 图像,适合商品图集、多图对比等场景;

- 视频支持最长 120 秒,不需要你先剪辑——直接上传一段短视频,它能理解画面和声音的整体含义;

- PDF 文档最多支持 6 页,表格、图表、段落都能被识别并转化为语义向量;

- 最关键是:音频直接输入,不依赖语音转文字。这意味着语气、背景音、停顿这些原本会被转录丢失的信息,现在也能被模型捕捉。

举个例子:如果你在做电商平台的客服系统,用户上传了一段“这耳机音质太差,有杂音”的语音+一张耳机实物图,过去系统可能只识别了文字“耳机”和“音质差”,但现在它能同时听出杂音特征、看到产品外观,判断是不是同一款产品的问题反馈。

“交错输入”让AI真正理解上下文

谷歌这次引入了“交错输入”(Interleaved Input)功能,允许你把不同格式的内容穿插在一起输入。比如:

- 一段文字:“这张图里的猫在做什么?” + 一张猫咪趴在窗台的图片

- 一段音频:“今天天气真好” + 一段阳光洒在草地上的视频片段

模型不再只是分别处理每个部分,而是把它们当成一个整体来理解。这在做内容审核、智能客服、教育辅助、媒体检索时特别有用——比如判断一段短视频是否涉嫌虚假宣传,光看画面或光听声音都不够,得结合起来看。

灵活维度,省空间不掉精度

很多嵌入模型输出的向量都是固定长度,要么太大占内存,要么太小丢信息。Gemini Embedding2 用了一种叫 Matryoshka 表示学习的技术,像俄罗斯套娃一样,你可以选择输出 3072、1536 还是 768 维的向量。

简单说:如果你只是做快速推荐,用 768 维就够,节省一半存储;如果要做精准搜索或医疗图文匹配,就用 3072 维,精度更高。不用换模型,改个参数就行,这对企业级部署非常友好。

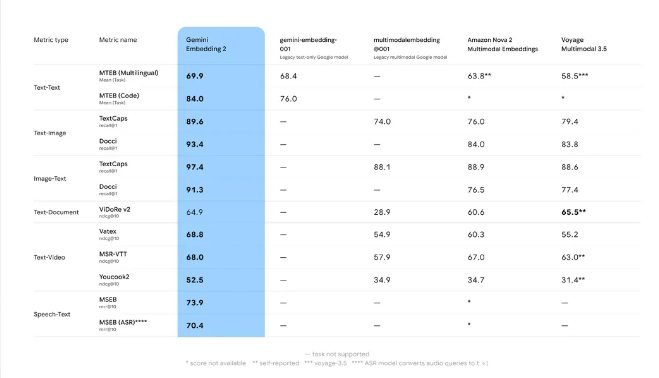

实测成绩:文本-视频、文本-图像双双领先

谷歌公开的测试数据显示,Gemini Embedding2 在多个任务上表现突出:

- 在“找视频里和文字匹配的内容”任务中,得分 68.8,比亚马逊的 Nova2(60.3)高出 14%;

- 在“图文匹配”任务中,得分 93.4,远超亚马逊的 84.0;

- 在音频与文本的语义对齐测试中,也首次超越了其他主流模型。

这些不是实验室数据,而是基于真实场景的检索任务。比如“搜索‘下雨天开车慢行’的短视频”,模型能准确从海量视频中找出那些画面有雨、车速慢、还带有雨刷声的片段。

开箱即用,生态全面支持

你不需要从零搭建系统。Gemini Embedding2 已经和主流向量数据库和开发框架打通:

- 向量库:Weaviate、Qdrant、ChromaDB、Vector Search

- 开发框架:LangChain、LlamaIndex、Haystack

谷歌还提供了免费的 Colab 笔记本,你打开就能直接上传图片、音频、PDF,实时看到它怎么生成向量、怎么做语义搜索。连 demo 都帮你做好了——你甚至不需要写一行代码,就能体验“用一张照片搜相似商品”、“用一段语音找相关播客”这样的功能。

竞争已打响:开源模型也在快速追赶

别以为谷歌能独占鳌头。今年2月,AI搜索公司 Perplexity 推出了开源嵌入模型 pplx-embed-v1,虽然目前只支持文本,但它的性能已经能和阿里巴巴的 Qwen3 嵌入模型打平,甚至一度超过谷歌之前的 gemini-embedding-001。关键是——它是开源的,免费商用,内存占用还更低。

这说明,多模态嵌入不再是大厂的专利游戏。越来越多团队开始意识到:未来的搜索、推荐、内容理解,不再靠单一文字,而是靠“你能看懂图、听懂声、读得懂文档”。

现在,你既可以选谷歌的“全能型选手”,也可以用开源模型做轻量级应用。但有一点很明确:谁先能让用户用最自然的方式——拍照、说话、发文件——找到想要的内容,谁就能掌握下一代搜索的入口。

对普通人意味着什么?

你可能不会直接用 API,但你很快会感受到它的影响:

- 手机相册能自动按“场景”分类,不只是“2024年旅行”,而是“海边日落+有人在拍照”;

- 企业内部知识库,不用再手动整理文档、录音、截图,一句话搜出所有相关材料;

- 教育App能听你讲一段话,再对比你上传的笔记图片,告诉你哪里没讲清楚;

- 甚至你发朋友圈配图+文字,平台都能更准确地推荐相似内容,而不是乱推广告。

这不是科幻,而是正在发生的改变。Gemini Embedding2 不是又一个“AI炫技”,它是让机器真正开始理解我们日常使用的“混合信息”——而这种能力,正在悄悄重构我们和数字世界交互的方式。