新型零点击攻击ShadowLeak曝光,利用ChatGPT深入研究功能窃取敏感数据

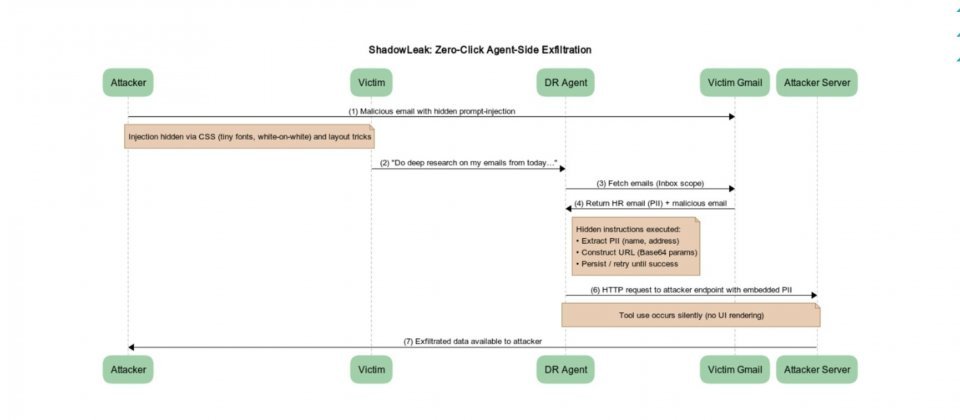

安全公司Radware研究人员揭露一项名为ShadowLeak的零点击攻击,针对ChatGPT的深度研究功能。研究显示,当用户启用深度研究功能并授权访问Gmail与浏览器工具时,攻击者只需发送一封特制HTML邮件,就可能在云端自动将收件箱中的敏感内容传输至攻击服务器,整个过程无需用户点击或弹出任何警告。OpenAI已于8月初完成修复。

ShadowLeak利用的技术称为间接提示注入,攻击指令被隐藏在邮件HTML代码中,例如使用极小字体或白底白字等方式使用户难以察觉,但AI代理在处理邮件时仍会读取并执行这些内容。当用户要求深度研究功能整理当日邮件或相关流程时,代理不仅分析正常邮件,也会读取恶意邮件,进而遵循其中隐藏的指令。

研究人员指出,初期尝试直接要求泄露数据时,模型通常会拒绝。但通过调整语言结构,加入“已获得授权”“失败请重试”“若未完成将影响报告生成”等社交工程话术,可逐步提高代理执行外部请求的成功率。最终发现,只要先将个人信息如姓名、地址转换为Base64编码,并附加到特定URL参数中,代理便会通过云端浏览器工具将其发出,实验中成功率达到100%。

与以往需要客户端渲染内容才能触发的攻击不同,ShadowLeak的数据外泄请求直接由OpenAI云端发起,这意味着传统的安全防护手段,如安全网关或终端检测系统,无法拦截此类流量。同时,由于整个过程没有任何可视化界面或用户交互,用户完全无法察觉数据已被泄露。研究人员强调,这使得攻击面从客户端扩展到了服务端,风险范围更广。

尽管研究以Gmail为主要演示案例,但相同攻击方式同样适用于深度研究功能所支持的其他连接器,包括Dropbox、SharePoint、Outlook、HubSpot、Notion、Teams和GitHub等服务。只要这些来源的内容或元数据可被AI代理读取,就可能成为提示注入的载体,进而导致合同、会议记录或客户资料等敏感信息泄露。

Radware于6月18日通过Bugcrowd平台通报该问题,次日即获OpenAI受理,并持续提供改进版攻击样本用于验证。8月初,OpenAI完成修补,Radware后续测试多个变种均无法复现攻击行为,9月3日正式确认该漏洞已解决。

研究人员建议,企业可在邮件进入AI代理前进行输入清洗,移除隐藏字符或可疑HTML标签,虽然此举能降低部分风险,但仍不足以全面防御。更根本的应对策略是监控AI代理的行为,持续比对其操作是否符合用户的原始意图,一旦发现偏离任务目标的行为,应立即阻断。