Check Point在RSAC 2025发布的AI安全报告,揭露多种正在暗网兴起的AI犯罪服务(Evil-AI as Service),其执行长Nadav Zafrir更进一步示警,随着AI代理程序(AI Agent)的兴起,有心人士更有可能进一步发展出具备高度自主能力的AI骇客兵团,足以发动更个人化、更自动化、更即时性、更具威胁性的大规模攻击。

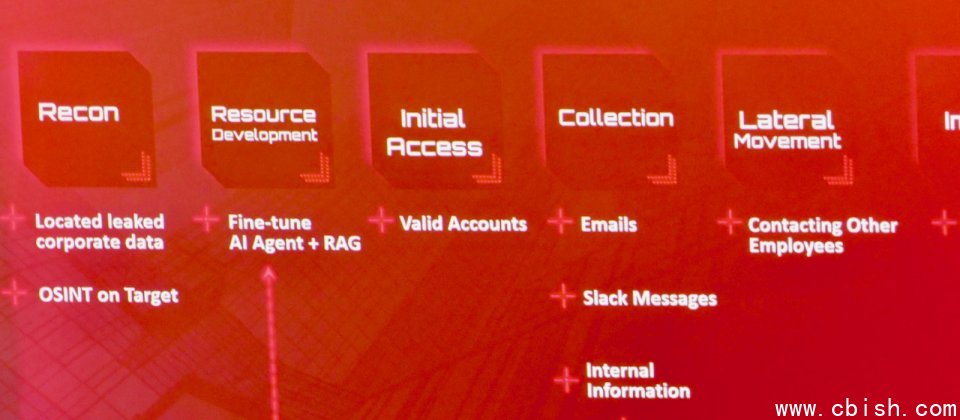

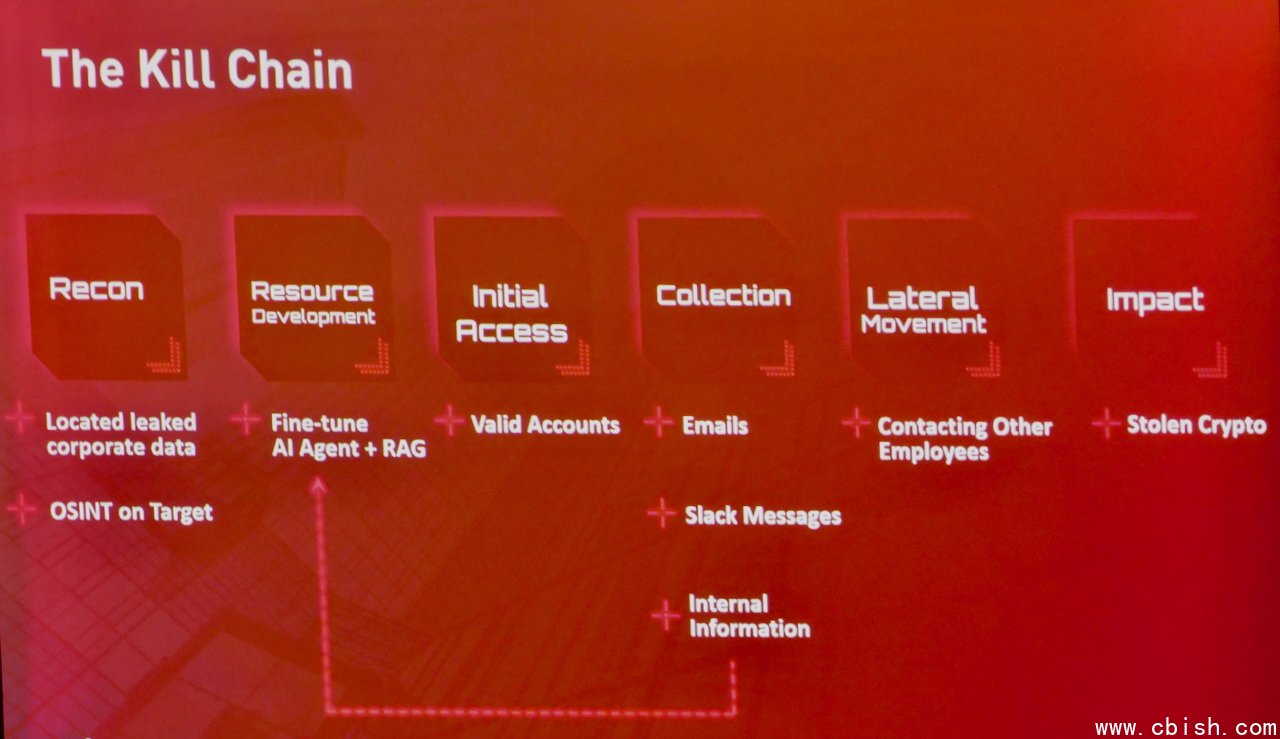

Zafrir提出一个结合生成式AI与AI代理程序,以窃取加密货币的新攻击情境。从攻击链流程来看,这个攻击情境的起手式与过往的攻击有一部分相同,都是先蒐集被锁定对象的资料,例如从被公开的外洩资料中寻找帐号与密码,作为发动钓鱼邮件或入侵受害者电脑的初始机制;然而不同的是,新型态AI攻击还会再利用个人资料训练专属AI模型,创造出模拟受害者特徵与行为模式的数位分身(Digital Twin)。

紧接着,攻击者会利用蒐集到的帐号密码等凭证资讯,入侵受害者的电脑或企业网路,一旦成功入侵,攻击者会持续潜伏,蒐集更多受害者的资料,如电子邮件、视讯会议、聊天资讯或是组织内部的资料,以持续训练最佳化AI模型。

一旦数位分身AI模型建立好了,攻击者就会据以发展能够模拟受害者行为的多种AI代理程序,并将这些AI恶意程序部署至受害者的电脑或网路,由它们自主操作攻击行动,进行横向移动攻击,例如伪冒受害者发送电子邮件或聊天讯息、模拟其帐户行为在内网侦察或移动,甚或操作加密货币转帐等交易行为。

生成式AI与AI代理程序成为攻击者的新武器之后,将会对网路攻击带来根本性的改变。Zafrir指出,过往要做到上述的自动化攻击情境相当困难,除了需要投入大量资源,还要耗时数月甚至数年,这么长的準备时间很容易让防守方有足够的时间反应而功亏一溃。然而,现代AI恶意程序不再需要回传指令至C&C(Command & Control)后端控制中心,一旦防线被攻破,AI恶意程序将会自主运作,不需要依赖后端控制,攻击行动可能在几天内就能结束。

再者,这种攻击方式一旦创造出拟真的数位分身后,就可以利用伪造的数位分身进行恶意行为,而不再需要利用真实的受害者。因此,吊诡的是一旦伪造的数位分身产生了,如果没有被识别出来,即使受害者拥有正确的资安习惯与资安防护,即便所有资安防护系统都正常运作,也无济于事。

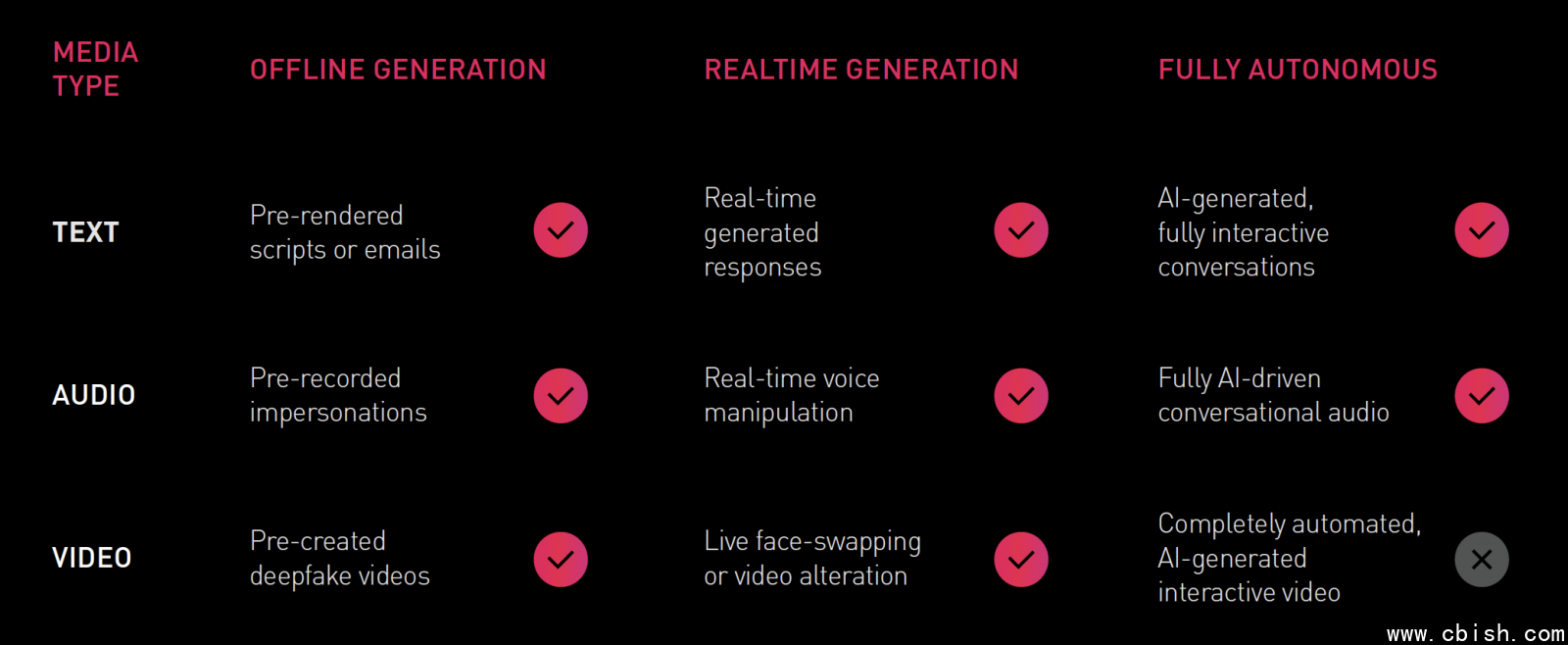

根据Check Point的AI安全报告评估,拜生成式AI技术之赐,文字、语音与视讯的深伪仿冒已是随手可得的技术。现今文字与语音的自主对话互动已可由AI全盘操作,诸多钓鱼攻击已展现文字完全自动化与接近完美的语音。而在影像自主对话互动方面,目前要全靠AI达成还有难度,但谁能知道是否会在接下来的几个月或几年内发生呢?

Zafrir表示,上述攻击情境看似危言耸听,但这些攻击能力其实已经存在,而更令人忧心的是,AI代理程序一旦启动就会自主决策,如何中止其流程将是个挑战。面对基于AI技术的攻击,他认为防御端的AI 必须具备与攻击等速的防御能力,因此未来的资安防护系统势必是要「AI原生」,才能即时反应与对抗。他认为借镜生物的社群与分形,建立複杂适应系统,可以分散式自主运作,避免单点故障,又可即时回应,以及持续学习与适应新的威胁,将会是一个可行的新方向。