图片来源:

图片来源:

MIT FutureTech

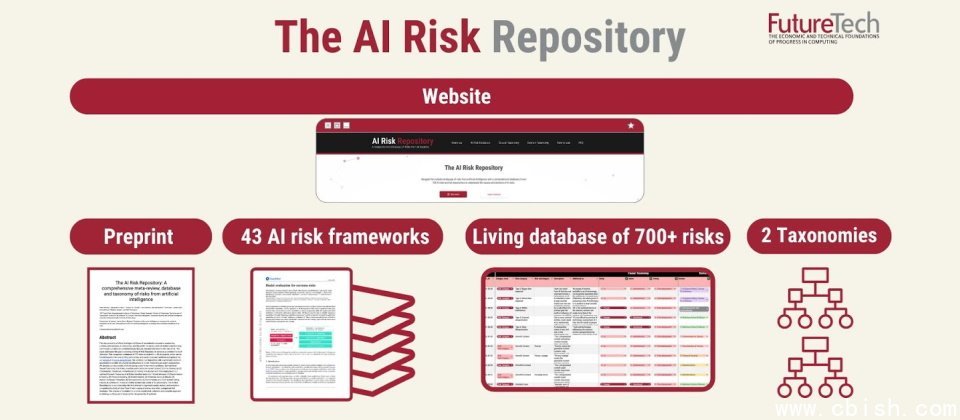

AI风险已成为公众关注议题,麻省理工学院(MIT)等学者集结了一个AI风险储存库(AI Risk Repository),供企业与政策、研究单位决策或评估系统之用。

这个AI风险储存库旨在以共通而完整的框架,协助用户辨识、了解和缓解AI相关风险和漏洞,克服知识碎裂化造成资讯互通困难及决策速度耽搁。

本储存库的作者来自MIT FutureTech、MIT电机与AI实验室、澳洲昆士兰大学、荷兰鲁汶大学等研究机构。

这个储存库主要分成三部分。一是AI风险资料库,提供由现有43个框架汲取出的777多种风险。二是AI风险原因分类,分成三种,包括实体(人)、意图(有意、无意)及时间点(部署前、部署后)。三是AI风险领域分类,将风险分成7种领域(如「假讯息、歧视/毒性、安全/隐私、恶意行为者/误用、社经/环境风险、人机互动、AI系统安全」)及23种次领域(如「虚假或误导资讯」。)

AI风险储存库提供AI风险概要、会定期更新最新风险和研究资讯来源,并给立法人士、主管机关、企业、开发人员、研究、稽核者等角色的共通参考架构。对AI团队而言,本储存库可提升风险管理能力,以充份资讯协助更有效辨识和缓解可能的风险,以确保安全AI系统的开发。立法议员则可用这储存库从事更有效的立法。这资源也有于培育AI风险专业人才。

但学者们也指出,这个储存库还是有些不足,像是涵盖面有漏失,未能完全包括新兴风险,检视过程不免有人为偏见,分类系统也可能过度简化问题複杂性。最重要的是储存库目前还无法提供风险影响及可能性百分比的资讯,而减损了实用性。不过即使有这些问题,仍不致减损它对推动负责任AI部署的贡献。

用户可以自由下载这个储存库,MIT专家也欢迎提供回馈意见或补充。

AI服务业者Gradient Flow则建议,为发挥AI风险储存库的功能,最好能将之提供的知识和洞见整合到AI开发流程和组织架构中。例如企业组织根据本资料库建立事件回应策略,像是清楚的事件定义、多向度监控及预先定义的事件控制方法,作为有效的事件管理、减低对营运和商誉的冲击。或是建立统一的平台,减少碎裂化的AI生态系统,确保AI系统在合法、合乎伦理及效能要求下运行。

本AI储存库也反映全球因应AI安全风险及威胁的尝试。欧盟制定全球第一部AI法案,也在8月初生效。