腾讯混元发布“混元3D世界模型2.0”,AI能直接造出可玩的3D世界了

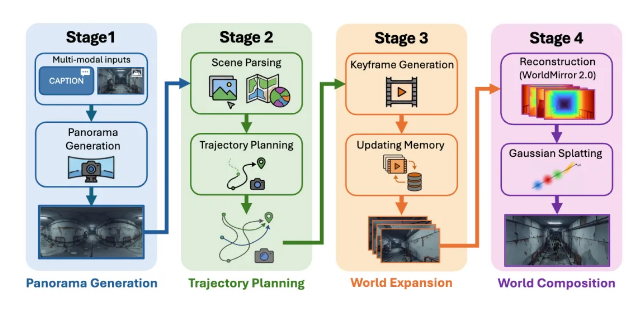

今天,腾讯混元团队正式开源“混元3D世界模型2.0”(HY-World2.0),这不只是又一个AI生成视频的工具,而是一个能从文字、图片或短视频中,直接构建出完整、可交互3D场景的系统。你只要说“一个阳光洒进的复古咖啡馆,角落有猫,窗外是下雨的街道”,它就能给你一套完整的3D资产——包括模型、材质、光照、碰撞体,还能导出成Unity或Unreal Engine能直接用的格式。

过去AI生成3D,大多只能“捏个模型”,要么是静态的,要么得靠人工一点点调碰撞、摆灯光、配动画。HY-World2.0不一样——它生成的场景,角色能真实地走动、撞墙会停下、跳下台阶会下坠,完全符合物理规律。这意味着,独立开发者、游戏工作室,甚至短视频创作者,现在不用再花几周搭建一个简单的关卡原型,几句话、一张图,就能拿到一个能跑能跳的3D世界。

不用相机参数,也能还原真实空间

传统3D重建靠的是多角度照片或激光扫描,成本高、门槛高。HY-World2.0的核心技术HY-Pano-2.0,可以直接从一张360度全景图,甚至一段手机拍的晃动视频,推断出整个空间的结构,连墙角、天花板、家具的深度关系都算得出来,完全不需要你提供相机位置或焦距。

更厉害的是它的“WorldStereo”机制。当你在已有场景里加一个新房间,它不会突兀地“贴”上去,而是会自动匹配光照方向、阴影角度、材质纹理,让新旧部分看起来像同一个设计师手笔。这在做游戏地图扩展、数字孪生城市改造时,省掉的不仅是时间,还有大量人工对齐的麻烦。

AI自己会“逛”你造的世界

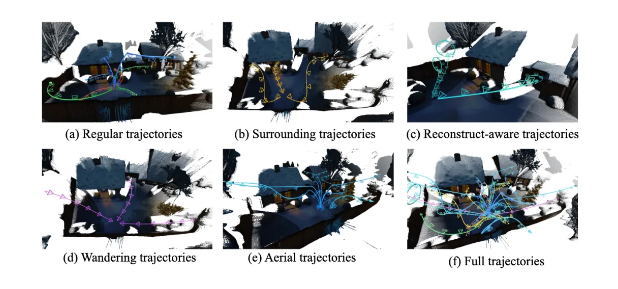

这次模型不只会“造”,还会“走”。它内置了自研的“空间Agent”,能理解你给的指令,比如“让一个角色从客厅走到阳台,避开沙发”,它会自动规划路径,识别哪里能走、哪里要绕、哪里有台阶。这个能力不是摆设——它能帮你测试关卡设计是否合理,比如玩家会不会卡在角落,NPC会不会撞墙。

开发者可以导出这些路径数据,直接导入Unity的NavMesh系统,连脚本都不用重写。对做VR体验、元宇宙应用的团队来说,这意味着原型验证周期从几天压缩到几小时。

真实场景一键复刻,数字孪生不再遥不可及

如果你有一段实地拍摄的视频,比如一个老厂房、一个民宿房间,HY-World2.0的WorldMirror2.0架构能一次性生成高密度点云、精确的相机轨迹,甚至还原出窗户的透光效果和地面的磨损痕迹。这不是简单的3D扫描,而是AI在理解“这个空间为什么长这样”。

已经有团队在用它做文物数字化、老旧厂房改造预演。一位深圳的建筑设计师告诉我们,他们用手机拍了2分钟的旧仓库,30分钟后就拿到了可编辑的3D模型,原本需要专业团队花两周才能完成的工作,现在一个人在家就能搞定。

为什么这次不一样?

谷歌的Genie 3、Meta的3D Gen等模型,虽然也能生成3D内容,但大多停留在“看起来像”,实际用起来不是模型穿模,就是角色卡在半空,碰撞体全是空壳。HY-World2.0是第一个在开源版本里,把“物理真实”和“引擎兼容”做到一起的。

现在,你下载模型后,可以直接拖进Unity,用Mecanim控制角色,用Timeline做动画,用Addressables打包资源——完全不用改引擎底层。导出格式支持Mesh、3DGS、点云,适配主流工具链,不搞“封闭生态”。

这不是实验室里的Demo,是能上生产线的工具。对于独立游戏开发者、影视特效团队、AR/VR内容创作者,这可能是今年最值得关注的AI工具升级。开源地址已上线,社区里已经有开发者上传了用它生成的“赛博朋克地铁站”“山间木屋”“废弃医院”等完整项目。

腾讯混元这次没喊“颠覆”,但确实把AI从“画图工具”变成了“世界引擎”。你不再需要会建模,只需要会想象。