腾讯混元开源DisCa:视频生成快11.8倍,还能不崩图

做视频生成的团队,最头疼的不是模型多复杂,而是生成太慢、算力太贵。哪怕你用上了最先进的模型,生成一段10秒的480p视频,可能要等上几十秒,甚至几分钟。算力成本高,上线难,迭代慢——这一直是行业里心照不宣的瓶颈。

现在,腾讯混元团队把这个问题往前推了一步。他们开源了名为DisCa的视频生成加速方案,代码和模型权重全公开,任何人都能直接用。这项工作刚被CVPR 2026收录,不是那种“发完就躺”的论文,而是实打实能跑起来、能落地的工具。

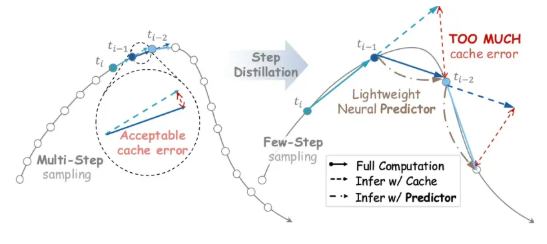

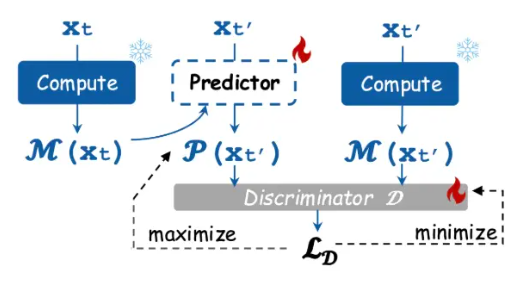

传统做法是靠“蒸馏”压缩模型步数,比如从50步降到5步,速度是快了,但画面经常糊、抖、变形,像低画质老电视。DisCa的聪明之处在于:它不直接扔掉中间步骤的特征,而是加了个“小脑”——一个轻量级的神经网络预测器。这个预测器不是瞎猜,是通过对抗训练学会“看懂”缓存特征的走向,提前预判下一步该长啥样。

结果很直观:在保持画面质量几乎不变的前提下,推理速度提升最高达11.8倍。也就是说,原来要等1分钟的视频,现在不到6秒就能出。而且它不挑模型,能直接挂到现有的蒸馏视频模型上,不用重训,拿来就能用。

不只是快,还要稳:R-MeanFlow的务实调整

光快还不够,得稳。去年MIT何恺明团队提出的MeanFlow,号称“一步生成图像”,听着很酷,但用在视频上,反而成了负担。视频不是单帧,前后帧要连贯,一步到位太激进,训练根本收不住,生成的视频不是卡顿就是鬼影。

混元团队没硬扛,也没盲目追热点。他们做了一件更工程师的事:把训练里那些“一步生成”的极端样本全砍了,只保留步长在3~15之间的合理区间。简单、直接、有效。

这个调整,和谷歌、MIT同期的实验不谋而合。现在,这个思路已经被用在HunyuanVideo-1.5的训练中——也就是当前开源圈里表现最好的视频生成模型之一。换句话说,你看到的那些流畅自然的开源视频,背后可能就有这一刀的功劳。

这不是论文,是工具包

很多人看AI新闻,看到“顶会论文”就以为是实验室玩具。但DisCa不一样。它不靠炫技,不靠参数堆砌,而是解决了一个真实场景里的痛点:怎么让视频生成又快、又便宜、还能稳定输出。

你不需要懂扩散模型、不需要改代码结构,只要下载开源代码,替换几个模块,就能在自己的服务器或云上跑起来。支持主流框架,有详细文档,连训练日志和对比样例都给了。

对中小团队来说,这意味着:不用花几十万买算力卡,也能做出接近大厂水准的视频生成服务。对创作者和开发者,这意味着更快的试错周期——今天改个脚本,明天就能看到成片效果。

如果你正在做短视频生成、AI动画、电商视频自动化,或者只是想低成本跑个视频模型,这份开源方案,值得你花一小时试一试。它不喊口号,只给你一个能跑通的解法。