蚂蚁灵波开源LingBot-Map:一部手机就能实时建三维地图

4月16日,蚂蚁灵波科技正式开源了一款名为 LingBot-Map 的流式三维重建模型。它最大的突破在于:你只需要一部普通手机上的RGB摄像头,边走边拍,它就能在视频播放的同时,实时算出你在哪里、周围环境长什么样,并生成一个可交互的三维地图。不需要专业设备,不需要提前录好再处理,拍完就能用。

不是“事后重建”,是“边走边画”

过去做三维重建,要么靠激光雷达,要么得把一整段视频拍完,再用服务器跑几个小时才能出结果。LingBot-Map 不一样——它像一个实时的“空间速写本”。你拿着手机走进一间屋子,它立刻开始估算你的移动轨迹,同时一点点把墙壁、家具、角落的形状“画”出来。整个过程延迟不到50毫秒,画面一动,地图就跟着更新。

这个能力在实际场景中有多重要?想象一下:AR眼镜帮你找办公室的会议室,机器人在你家自动避障绕开玩具和宠物,无人机在室内仓库自主巡航——这些都依赖“实时知道我在哪、周围有啥”。而过去,这类应用要么贵得离谱,要么反应慢、容易丢定位。LingBot-Map 让这一切变得像发微信一样简单。

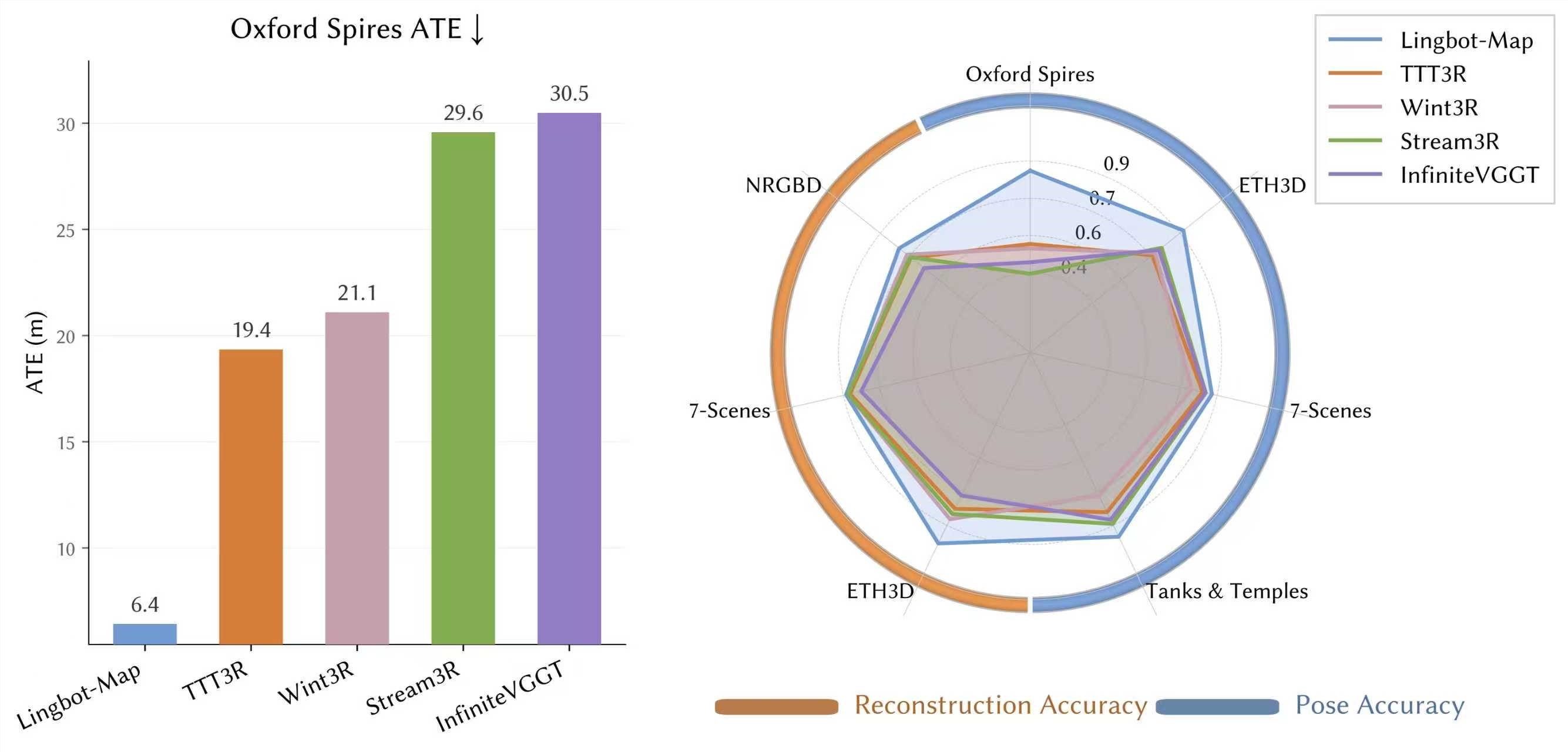

真实数据说话:比很多专业方案还稳

团队把模型放到业界公认的“最难测试集”之一——牛津Spires数据集上比拼。这个数据集以光照变化大、纹理缺失、快速运动著称,连很多用双目相机或IMU辅助的系统都容易出错。结果:LingBot-Map 的轨迹误差只有当前主流流式方法的1/3,甚至超过了部分依赖多传感器融合的离线方案。

更惊人的是它的耐力。在超过1万帧(约5分钟)的连续视频中,它的精度几乎没有衰减。这意味着它不光能“开局准”,还能在你逛完整个商场、穿过多个走廊后,依然清楚自己在哪。目前实测帧率稳定在20FPS,主流安卓旗舰手机上都能流畅运行。

不只是技术秀,是给开发者和创业者开了一扇门

这次开源,不是为了发论文。蚂蚁灵波想做的,是把过去只有大厂才用得起的高精度空间感知能力,变成人人都能用的工具。

如果你是做机器人创业的,不用再花几万块买雷神或Intel RealSense;如果你是做AR应用的,不用再为定位漂移头疼;如果你是学生或极客,想试试让AI理解你家的三维结构——现在,一个模型、几行代码,就能上手。

这背后是蚂蚁灵波继深度估计、大语言动作模型(VLA)、世界模型(World)之后,补齐了具身智能最关键的“空间感知”一环。简单说:以前AI能“看懂”画面、能“听懂”指令,现在,它终于能“知道”自己在物理世界中的位置了。

怎么用?免费,开源,开箱即用

模型已全面开源,无需申请,直接下载:

Hugging Face: https://huggingface.co/robbyant/lingbot-map

ModelScope: https://www.modelscope.cn/models/Robbyant/lingbot-map

官方提供了Python推理示例、预训练权重和轻量化部署指南。GitHub上也有配套的可视化工具,你甚至可以用它把手机拍的客厅视频,直接转成一个能在Web端旋转查看的3D模型。

这不是未来科技,这是现在就能拿在手里的工具。你只需要一部手机,和一点好奇心。