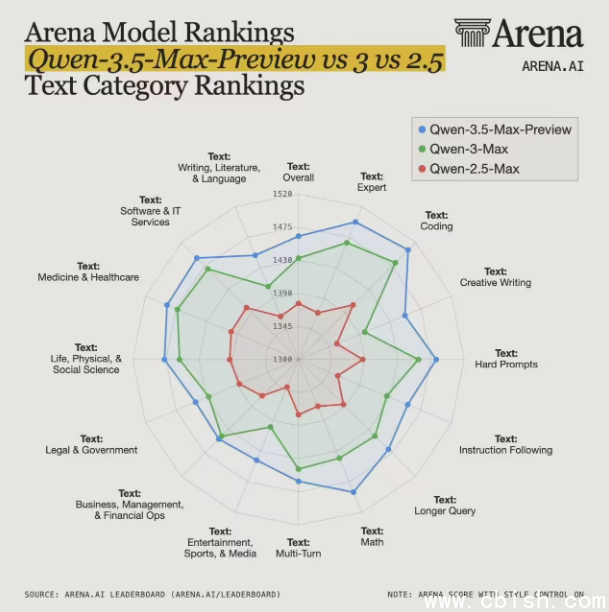

通义千问Qwen3.5-Max-Preview登顶LM Arena,中国大模型首次跻身全球前五

3月20日,阿里通义千问正式发布Qwen3.5-Max-Preview,这款新模型在国际权威大模型评测平台LM Arena上一鸣惊人,以1464分的综合得分冲进全球前五,成为中国首个进入这一梯队的大模型。这一成绩不仅打破了此前由国外厂商主导的排名格局,也让全球开发者第一次认真看待中国大模型的实战能力。

LM Arena由开源研究机构LMSYS运营,其评测机制极为严苛:所有模型以匿名形式接受用户真实提问和对比投票,用户不知道哪个是GPT-4、哪个是Claude、哪个是通义千问——全靠实际表现说话。这种“盲测”方式被业界称为“最接近真实体验的排行榜”,没有营销话术,只有用户用脚投票。

在这场没有彩排的公开对决中,Qwen3.5-Max-Preview的表现让不少人意外:

- 数学推理能力全球第五,远超多数同规模模型,尤其在复杂代数和逻辑推演题上稳定压过Gemini 1.5 Pro;

- 综合性能排名第六,在无任何风格引导的开放问答中,胜率接近GPT-4o;

- 长文本处理能力进入全球前十,能准确处理超过10万字的文档摘要、多轮合同分析和跨段落推理,实用性远超多数“参数堆砌型”模型。

不靠参数堆料,靠架构“省电又高效”

很多人以为大模型比的就是参数规模,但Qwen3.5-Max-Preview偏偏反其道而行。它没有盲目堆到1000B以上,而是延续了通义千问系列“小激活、大性能”的设计思路——用更聪明的架构,激活更少的参数,干更多活。

据阿里云技术团队透露,该模型在同等算力下,推理速度比前代提升40%,内存占用降低35%,这意味着它不仅能跑在高端服务器上,也能在消费级显卡上流畅运行。不少开发者反馈:“用3090就能跑,响应比某些闭源模型还快。”

自今年除夕起,通义千问已开源8个不同规模的模型,从0.8B的小巧版到397B的旗舰版,覆盖手机端、PC端到数据中心。这种“全家桶式”开源策略,让个人开发者、中小企业甚至高校实验室都能找到适合自己的版本。有人在GitHub上评价:“这是今年最实在的开源动作,不是PPT模型,是真能跑起来的。”

从“能用”到“好用”,中国AI正在被重新定义

过去几年,中国大模型常被贴上“参数大、响应慢、中文强、英文弱”的标签。但这一次,Qwen3.5-Max-Preview在英文场景下的表现,让很多国外用户都感到惊讶。一位美国AI工程师在X平台写道:“我以为这是GPT-4o的变体,结果是通义千问?这性能,比我用的Claude 3.5还顺手。”

更重要的是,它不是实验室里的“演示品”。目前,Qwen3.5-Max-Preview已作为预览版向全球开发者开放,可通过阿里云百炼平台直接调用。不少企业已在内部测试,用于客服系统、法律文书分析和金融报告生成。一位深圳金融科技公司的CTO告诉媒体:“我们换掉GPT-4了,成本降了60%,效果没差。”

这不是一场简单的技术升级,而是一次话语权的转移。当中国团队不再只盯着“世界第一大模型”的名号,而是专注解决真实问题、开放真实能力、接受真实检验时,世界才真正开始重新认识中国AI。

通义千问没有喊“颠覆”,但它的表现,正在悄悄改写规则。