OpenAI于周二(3月17日)推出GPT-5.4 Mini和GPT-5.4 Nano,强化小型模型产品线。OpenAI表示,这两款模型在保留GPT-5.4核心能力的同时,提供更高速度与更低的成本,适用于高并发与低延迟场景。

在定位上,GPT-5.4 Mini主打需要实时响应且具备一定复杂度的任务,包括代码助手、电脑操作与多模态理解,并支持工具调用与多步骤处理;GPT-5.4 Nano则是该系列中最轻量的版本,主要用于分类、数据提取与排序等基础任务。

关键在于使用方式的变革。OpenAI指出,开发者可将不同规模的模型协同工作:由大型模型负责规划、协调与最终决策,而搜索代码库、审阅文档或处理辅助任务等具体操作,则交由GPT-5.4 Mini等小型模型并行执行。

在这种架构下,小模型不再是能力较弱的替代方案,而是承担实际任务执行的核心单元。由于智能体系统通常包含大量子任务,若全部由大型模型处理,将面临高昂成本与延迟问题,小模型因此成为支撑整体系统运行的重要基础。

这种多模型分工的模式过去已在开发者实验和部分应用中出现,但受限于小模型的能力与稳定性,实际应用中仍多依赖单一大型模型。随着小模型能力显著提升、成本差距进一步拉大,加之OpenAI在产品说明中明确推荐此类架构,这种设计正逐步从可选方案转向主流趋势。

根据OpenAI公布的API定价,GPT-5.4每百万Token的输入与输出成本分别为2.50美元和15.00美元;GPT-5.4 Mini为0.75美元与4.50美元;GPT-5.4 Nano则为0.20美元与1.25美元。

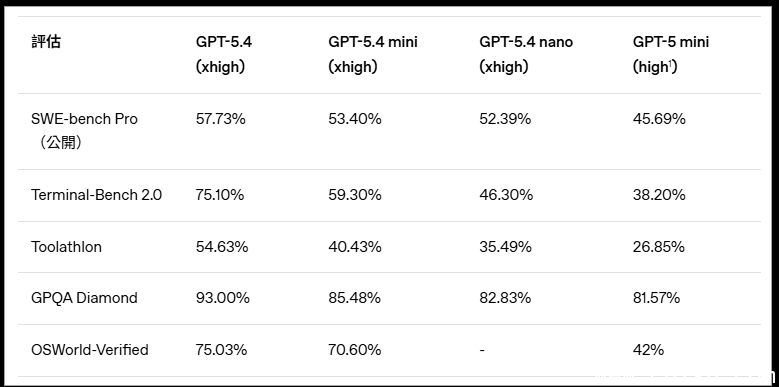

在能力方面,GPT-5.4 Mini在多项基准测试中表现已接近GPT-5.4。例如在SWE-Bench Pro(基于真实开源项目评估AI修复代码错误能力)中,GPT-5.4 Mini得分为53.40%,接近GPT-5.4的57.73%,并显著高于GPT-5 Mini的45.69%;在OSWorld-Verified(评估AI在电脑操作环境中完成任务的能力)测试中,GPT-5.4 Mini达到70.60%,明显优于GPT-5 Mini的42%,与GPT-5.4的75.03%差距不大。这表明小模型在保持效率优势的同时,也能胜任编程与电脑操作等高复杂度任务。

总体而言,GPT-5.4 Mini与Nano的推出不仅是小模型性能的升级,更反映出AI应用正从单一模型主导,转向多模型协同的新型范式:大型模型负责规划与决策,小型模型则承担大量具体任务的执行。