AReaL v1.0 正式开源:让任何智能体都能自动进化

3月4日,蚂蚁集团联合清华大学正式发布开源强化学习训练框架 AReaL v1.0。这个新工具的核心目标很直接:不用改一行智能体代码,就能让它学会从真实使用中不断变强。

过去一年,LangChain、Claude Code、OpenClaw 等智能体框架迅速流行,开发者能快速搭建出能写代码、能做规划、能对话的AI代理。但问题也随之而来——这些智能体一旦部署,能力就基本定型了。它们不会因为用户反馈而进步,也不会根据实际任务表现调整策略。想要优化?必须重新训练模型、重新部署,成本高、周期长,很多人干脆放弃。

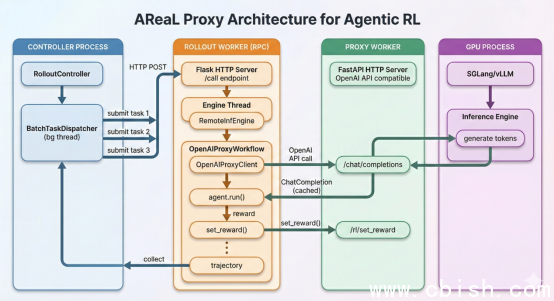

AReaL 打破了这个僵局。它不是另一个智能体框架,而是一个“训练中间层”。你用什么智能体?LangChain?自研的?OpenClaw?都没关系。只要在配置里把请求地址指向 AReaL 的网关,你的智能体就能自动接入强化学习训练流程。它依然像以前一样工作,用户依然正常交互,只是后台开始悄悄记录每一次任务表现,并根据你给的反馈(比如“这次回答很好”或“这个操作太蠢了”)自动优化决策逻辑。

(图说:AReaL 无缝接入智能体的异步训练架构)

一个配置就能启动训练,OpenClaw 用户实测可行

以 OpenClaw 为例,开发者只需要修改两个字段:

- 把

base_url从原来的 OpenClaw 服务地址,改成 AReaL 提供的代理地址 - 把

api_key替换为 AReaL 分配的密钥

其他一切不变——你的提示词、工具调用、任务流程,全都不用动。智能体还是按原来的方式运行,只是现在,每次它完成一个任务,AReaL 都会记录下输入、动作、输出和你给的评分。每隔一段时间,系统自动收集这些数据,用强化学习算法更新模型权重,再把新版本推回服务端。整个过程完全透明,无需人工干预。

这意味着,一个用于客服的智能体,用得越多越懂用户;一个用于代码辅助的智能体,越多人用它改bug,它就越会避开那些容易出错的模式。这不是“一次性训练”,而是真正的“持续进化”。

自研训练引擎 Archon,1人32天搞定千亿参数并行系统

AReaL 背后支撑这套能力的,是一个叫 Archon 的训练引擎。它不是基于 Hugging Face 或 DeepSpeed 的二次封装,而是从零用 PyTorch 原生接口实现的完整分布式训练系统,支持5D并行:

- 数据并行(Data Parallel)

- 流水线并行(Pipeline Parallel)

- 张量并行(Tensor Parallel)

- 上下文并行(Context Parallel)

- 专家并行(Expert Parallel,专为MoE模型优化)

这意味着它能高效训练千亿参数的MoE模型——这类模型在智能体场景中特别有用,因为不同任务可以调用不同“专家”模块,效率高、响应快。

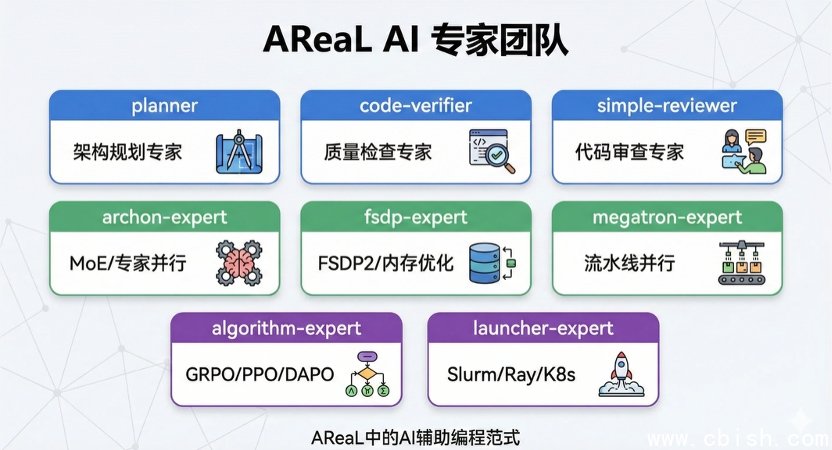

更惊人的是,这个复杂系统从立项到稳定运行,只花了一个人32天。团队没有靠几十人的工程组,而是靠一套深度集成的AI辅助开发系统,完成了原本需要数月的底层代码编写。从架构设计、并行逻辑实现、内存优化,到单元测试和文档生成,AI助手全程参与,每一行关键代码都有人机协同校验。

这不是“自动写代码”的噱头,而是把AI变成了工程协作的“协作者”——它能理解你写的代码意图,指出潜在的并行冲突,建议更优的内存复用方案,甚至帮你写测试用例。开发者不再被底层系统拖住,而是专注于“我要让智能体学会什么”。

开源即用,开发者可立即上手

AReaL v1.0 已在 GitHub 完全开源,包含完整的文档、示例代码和部署脚本。无论你是个人开发者、创业团队,还是企业内部AI小组,都可以直接下载使用。

- GitHub 仓库:https://github.com/inclusionAI/AReaL

- 技术论文:https://arxiv.org/abs/2505.24298

目前支持主流智能体框架(LangChain、AutoGen、OpenClaw 等)的接入模板,后续将扩展对多模态输入(图像、语音、视频)的支持,让智能体不仅能“说”,还能“看”和“听”中持续学习。

我们不再满足于“能用的AI”。现在,我们要的是“越用越聪明的AI”。AReaL v1.0,是这个方向迈出的第一步。