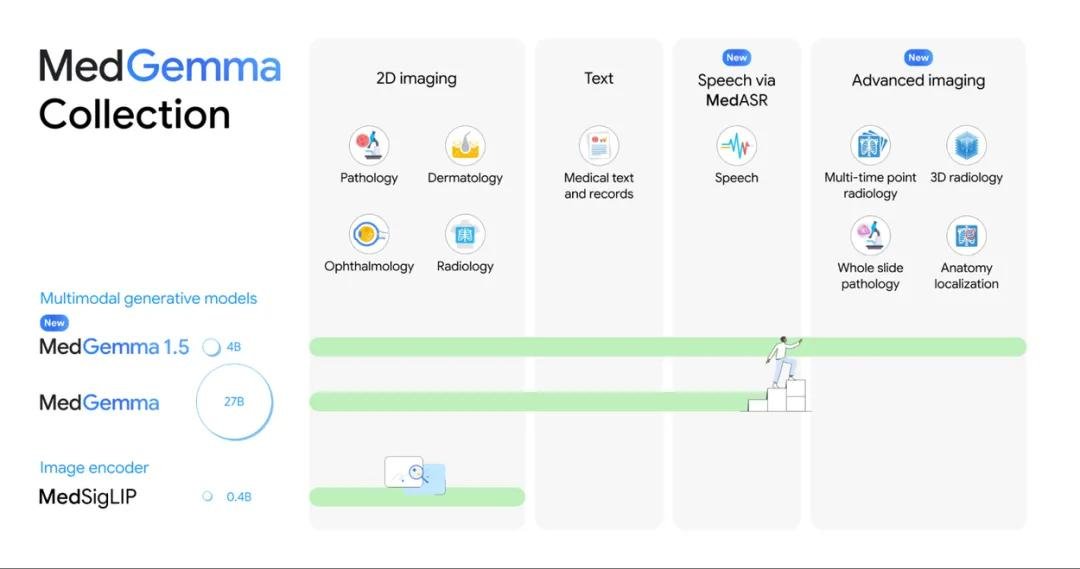

MedGemma 1.5重磅升级:首个开源多模态医学AI模型,全面支持三维影像与语音交互

自MedGemma系列发布以来,已在全球范围内获得数百万次下载,成为医疗AI领域最受关注的开源项目之一。如今,谷歌正式推出MedGemma 1.5版本,带来颠覆性升级——这是全球首个能够同时处理三维医学影像、时间序列数据与临床文本的开源多模态大语言模型,标志着AI在医学辅助诊断领域迈入新阶段。

突破性能力:从二维到三维,从静态到动态

MedGemma 1.5 4B首次实现对高维医学影像的原生理解。它不仅能处理传统的X光片和超声图像,还能直接分析CT、MRI等三维体数据,甚至支持全切片数字病理图像(WSI)——这意味着医生上传一整套肺部CT的200+层切片,模型能自动识别病灶分布、体积变化与组织结构异常,无需人工预处理。

在纵向分析方面,模型可追踪患者数月甚至数年的胸部X光变化,自动标注肺部浸润、心影扩大、胸腔积液等关键指标的演变趋势,辅助医生判断慢性病进展或治疗响应。在解剖定位上,其交并比(IoU)从3%跃升至38%,精准锁定肋骨、膈肌、心脏轮廓等关键结构,为AI辅助阅片提供可靠空间参考。

此外,它能从杂乱的实验室报告中提取结构化数据:如血常规中的白细胞计数、肝功能指标、凝血时间等,自动归类为可查询的JSON格式,大幅减少临床数据录入负担。

性能飞跃:多项指标刷新开源记录

在权威基准测试中,MedGemma 1.5的表现令人瞩目:

- CT疾病分类准确率提升至61%(+3%),显著优于同类开源模型

- MRI分类准确率从51%飙升至65%(+14%),在脑肿瘤与多发性硬化识别中表现突出

- 胸部X光解剖定位交并比达38%(原为3%),提升达35个百分点

- 时间序列分析宏观准确率提升至66%(+5%),可识别隐匿性肺炎进展

- 实验室报告数据提取F1分数达78%(+18%),接近人类专业录入水平

这些数据不仅来自公开数据集(如MIMIC-CXR、BraTS、TCGA),也在多家三甲医院的脱敏临床数据中完成验证,展现出强大的泛化能力。

语音+影像双引擎:MedASR让医生“开口问诊”

与MedGemma 1.5同步发布的,是专为医疗场景打造的语音识别模型——MedASR。基于Conformer架构,仅1.05亿参数却在5000小时真实医学语音语料上训练,专攻放射科、急诊科等高频语音场景。

在与Whisper large-v3的对比测试中:

- 胸部X光报告转写词错误率低至5.2%,较Whisper降低58%

- 跨科室(如心内、神外、ICU)术语识别错误率下降82%

更重要的是,MedASR可无缝对接MedGemma 1.5,实现“医生口述—AI自动转录—影像智能分析—结构化报告生成”的全流程闭环。一名放射科医生只需对着语音终端说:“患者65岁,男性,咳嗽三周,右下肺野可见斑片状阴影,建议对比去年片”,系统即可自动调取历史影像、比对变化、生成初步分析摘要,节省大量文书时间。

免费开放,全场景可用

谷歌宣布,包括MedGemma 1.5系列(4B/7B)、MedASR、MedSigLIP图像编码器在内的全部模型,均采用Apache 2.0开源协议,**可免费用于研究、教学、商业产品开发**,无需授权费或版税。

开发者可通过Hugging Face直接下载模型权重,或通过Google Cloud Vertex AI一键部署API服务,支持私有化部署与企业级安全合规。已有超过120家医疗机构与AI初创公司接入测试,涵盖远程影像诊断、基层医院辅助系统、智能电子病历等场景。

重要提醒:AI是助手,不是医生

谷歌明确强调:所有模型均为**辅助决策工具**,不可替代临床判断。模型输出结果需由持证医师复核,尤其在急诊、肿瘤、儿科等高风险场景中,必须结合患者病史、体征及其他检查综合评估。模型训练数据不包含未脱敏的个人身份信息,符合HIPAA与GDPR规范,但使用者仍需自行确保合规性。

目前,谷歌已联合斯坦福、梅奥诊所等机构启动“AI临床验证计划”,首批10个真实世界研究项目正在推进中。未来,MedGemma系列还将支持超声动态视频分析、病理切片细胞级分割等前沿功能。医疗AI的未来,正从“能看图”走向“能思考”。