随着企业训练大型AI模型、部署大规模AI推理服务,并构建可处理海量企业数据的AI代理,存储性能已成为能否充分发挥AI算力的关键因素。Google Cloud指出,虽然GPU与TPU是AI计算的核心,但一旦数据供给或检查点写入跟不上计算节奏,计算资源就难以充分发挥效能。Cloud Storage Rapid正是为应对这类需求而设计,在保留对象存储易用性与可扩展性的同时,大幅提升AI工作负载所需的数据访问性能。

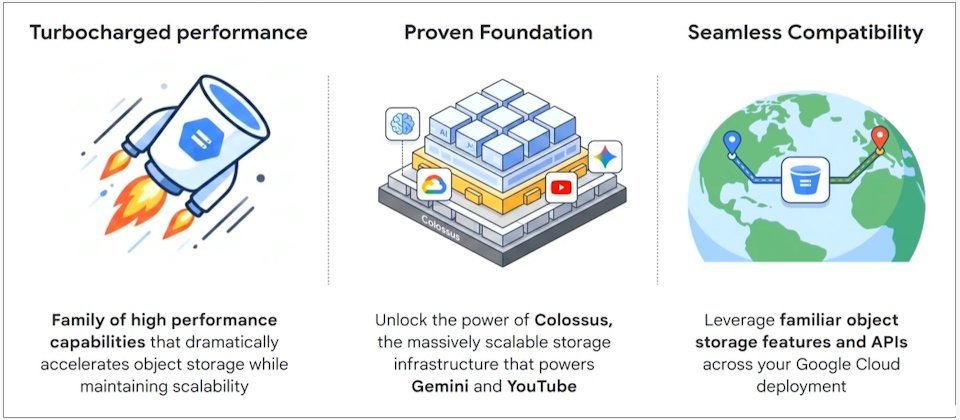

Cloud Storage Rapid目前包含两项核心能力。Rapid Bucket已正式上线,其前身是Rapid Storage,是一种高性能区域级对象存储桶,底层采用Google分布式存储系统Colossus——即支撑Gemini与YouTube的存储基础设施。Google Cloud表示,单个Rapid区域存储桶可提供超过15 TB/s的聚合读取吞吐量,并支持每秒最高2000万次查询。

Rapid Bucket主要应用于数据准备、模型训练、检查点处理、批处理与流式分析,以及分布式数据库架构优化等高性能需求场景。Google Cloud宣称,在多模态训练任务中,Rapid Bucket可将GPU空闲等待时间减少50%,数据加载速度最高提升2.5倍;相比传统对象存储,检查点恢复速度最高提升5倍,写入速度提升3.2倍。

另一项能力Rapid Cache,其前身是Anywhere Cache,可为现有的Cloud Storage存储桶加速读取,且无需修改代码。Google Cloud表示,Rapid Cache可在数据准备、训练及推理期间应对突发的模型加载需求,提供高达2.5 TB/s的聚合读取吞吐量;在推理工作负载中,模型加载速度最高提升2.1倍,并可降低47%的总体拥有成本(TCO)。

Google Cloud此次为Rapid Cache新增了“写入即同步缓存(ingest on write)”功能,使数据在写入Cloud Storage存储桶时,同步进入Rapid Cache,避免首次读取时才建立缓存而导致的性能延迟。Google Cloud指出,该功能可将检查点恢复时间最高加快2.2倍,特别适用于训练中断后需快速恢复的AI工作负载。

Google Cloud以AI研究与产品公司Thinking Machines Lab为例指出,该公司在AI/ML流程中引入Rapid Cache,用于数据处理、多模型训练与模型加载等任务后,稳定读取吞吐量峰值超过1.8 TB/s,并显著降低了长尾延迟与429错误。Google Cloud表示,Rapid Cache目前已由客户部署数千个缓存实例,过去一年部署量增长20倍,最高可承载Cloud Storage全球对外数据流量的20%。