小米开源机器人大模型后训练全流程,真机实测:20小时学会“精准收纳耳机”

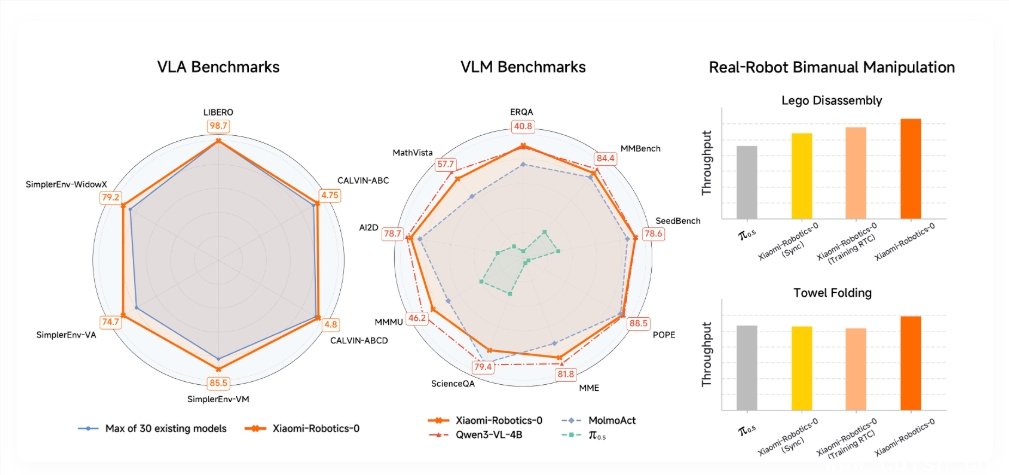

今年2月,小米发布开源视觉语言动作(VLA)大模型Xiaomi-Robotics-0,一度登上HuggingFace全球下载榜前六。如今,这家公司又甩出一记实锤——正式公开该模型的完整后训练(Post-training)全流程,包括训练数据、微调代码、奖励函数设计和真实机器人部署方案。这不是概念演示,而是让开发者能直接在自家机器人上复现“耳机收纳”这种高精度任务的全套工具。

在最新公开的视频里,一台搭载Xiaomi-Robotics-0的机械臂,仅用20小时的真实任务数据训练,就完成了“连续收纳真无线耳机”这一动作。不是模拟环境,不是实验室专用道具,而是市面上常见的AirPods Pro同款耳机和充电盒。机器人能精准识别每个耳机的朝向,轻柔抓取,对准仅比耳机宽0.3毫米的槽位,稳稳嵌入,全程无滑动、无磕碰。

这背后的技术,远比看起来复杂。耳机表面光滑到Ra0.03μm,比镜面还滑,手指轻轻一碰就可能偏移。而充电盒内槽的公差控制在亚毫米级——这意味着模型必须在毫秒级内感知接触力、调整抓取角度、修正位姿。小米团队公开了他们如何用触觉传感器+视觉反馈联合建模,让模型学会“感觉”到耳机是否卡住,而不是靠预设轨迹硬怼。

更关键的是,小米把所有能给的都开源了:训练用的20小时真实操作视频、标注好的动作序列、奖励函数的Python实现、甚至包括如何用低成本力控模组替代昂贵的六维力传感器。GitHub仓库里,连“如何用树莓派+USB摄像头跑通推理”都有详细说明。

这不是为了炫技。小米的工程师在技术报告里写得很直白:“我们见过太多实验室里的机器人,一出实验室就废了。我们要的不是能跳舞的机器人,是能进工厂、进仓库、进家庭,真正干活的机器人。”

目前,已有国内多家机器人初创公司基于这套开源方案,快速复现了“组装USB接口”“分拣手机摄像头模组”等任务。一位在深圳做自动化设备的开发者在社区留言:“之前买一套商用机器人控制方案要30万,现在用小米这套,硬件成本不到5万,开发周期从3个月缩到3周。”

你可以在以下平台获取全部资源:

- 技术官网:https://robotics.xiaomi.com/xiaomi-robotics-0.html#pack-earbuds

- GitHub仓库:https://github.com/XiaomiRobotics/Xiaomi-Robotics-0

- HuggingFace模型库:https://huggingface.co/Xiaomi-Robotics

如果你手头有机械臂、力控夹爪、或只是想试试AI能不能控制真实世界里的小物件——现在,你不需要等大厂开放API,也不用花几十万买方案。小米已经把门打开了。