DeepSeek 大幅降价,国产大模型打响价格战

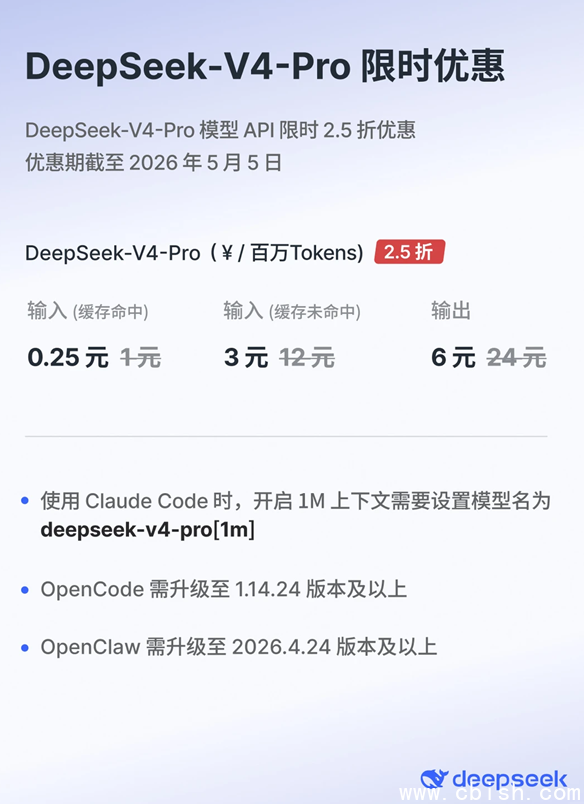

近日,国产大模型厂商 DeepSeek 宣布对全线 API 服务进行价格调整,核心变化是:缓存输入价格直接降到首发价的十分之一。这意味着,企业使用 DeepSeek V4-Pro 处理重复性请求时,每百万 Token 的成本仅需 0.1 元,若赶上限时活动,实际支付甚至低至 0.025 元——比一杯奶茶还便宜。

这个价格不是噱头。对比目前海外主流模型,DeepSeek 的缓存输入成本不到 GPT-4o 或 Claude 3.5 的 1/700。不是“差不多”,是真·断层式便宜。不少开发者在社区反馈:“以前不敢用大模型做客服自动回复,怕成本崩了;现在,一天百万次调用都敢试。”

不只是缓存,全链路都在降

这次降价不只针对“命中缓存”的场景。即使没命中缓存,输入和输出的价格也统一下调到原价的四分之一。这对大量使用 RAG(检索增强生成)的企业来说,简直是雪中送炭。比如做知识库问答、合同分析、客服系统,过去每月花几千上万的算力费,现在可能不到一千块就能搞定。

一位来自杭州的 SaaS 创始人告诉笔者:“我们系统每天要处理 300 万条客户咨询,以前用国外模型,光 API 费一个月就要 8 万。换上 DeepSeek 后,直接降到不到 6000 块。省下的钱,我们用来加了两个客服机器人。”

为什么能这么便宜?技术背后有真功夫

DeepSeek 能打价格战,不是靠补贴,而是靠自研架构。他们用的是自研的“稀疏注意力”技术,能在处理超长文本(最高支持 16 万 Token)时,大幅减少内存占用和计算量。简单说,就是同样的算力,能干更多活。

过去,大模型处理一份 50 页的合同或一份长篇报告,动不动就卡顿、贵、慢。现在 DeepSeek 不仅能一口气读完,还跑得快、耗电少。这直接让服务器成本降了三成以上,技术红利终于变成了用户能感知到的实惠。

已经接入主流云平台,企业随时能用

DeepSeek 没有把自己锁在自家服务器里。目前,它已经深度适配华为云、阿里云、腾讯云、百度智能云、火山引擎、京东云、天翼云和 AWS 中国区。这意味着,不管你是用哪个云平台,都能一键接入,不用改代码,不用换系统,直接替换掉原来贵的模型就行。

不少企业已经开始行动。某大型银行的智能客服团队负责人说:“我们测试了三个月,效果不输 GPT-4,价格不到零头。下个月全量上线。”

行业正在被重新定义

这不是一次简单的促销,而是一场“价格革命”。过去,大模型是大厂的专利,中小企业连试都不敢试。现在,DeepSeek 把成本压到极致,让 AI 从“高大上”的实验室,变成了“能用、敢用、用得起”的工具。

海外模型厂商已经开始感受到压力。有消息显示,OpenAI 和 Anthropic 内部正在评估是否要对亚太市场推出阶梯定价。但无论如何,国产模型已经证明:便宜,不等于低质;性价比,才是真正的竞争力。

对开发者和企业来说,现在不是“要不要用 AI”,而是“什么时候开始用”。而 DeepSeek,已经把门打开了。