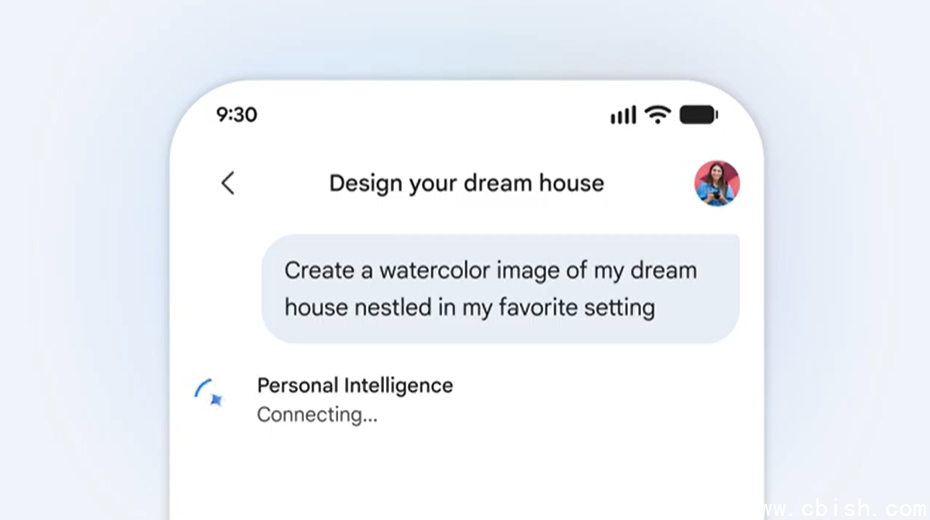

Gemini 现在能看你的照片,帮你生成更像你的图片

最近,谷歌给它的AI助手Gemini加了个新本事:它能直接看你手机里的照片,然后根据你或家人的真实模样,生成一张看起来“像你”的新图片。以前你想让AI画一张你穿着西装站在海边的图,得写一大段描述:“男,35岁,黑发微卷,戴细框眼镜,身高178,穿深灰色羊毛西装……”现在不用了。你只要说“帮我画一张我去年夏天在海边和孩子玩的照片风格的图”,Gemini就会翻你相册里那张照片,看你的脸、你的衣服、你的表情,然后照着样子来画。

不是靠猜,是真看你的照片

这项功能靠的不是什么玄乎的“大模型”,而是谷歌最近优化的图像处理技术,内部叫Nano Banana2。简单说,它比以前更懂“这张照片里的人是谁”“这个场景是什么时候拍的”“这个人平时爱穿什么风格”。它不会凭空编造,而是从你自己的照片里“偷”细节——比如你眼角的那道细纹、你女儿头发的卷度、你家后院那棵老树的轮廓,全都用上了。

这不是孤立的功能。谷歌这几年一直在推“个人智能”——意思是,你的AI助手不该只回答“今天天气怎么样”,而该知道你上周刚去过洛杉矶,你妈喜欢红色,你儿子总在周六早上吃煎饼。这次,照片库成了它了解你生活的新窗口。未来,它可能还会结合你的日历、邮件、地图记录,比如:“你下个月要去巴塞罗那?要不要我帮你生成一张你穿着当地风格衬衫,在圣家堂前的想象照?”

隐私问题:你的全家福,成了AI的素材?

但问题是,谁允许AI翻你相册的?

很多人第一反应是:这不就是把我的回忆,喂给机器当饲料?那些孩子第一次走路、老人过生日、婚礼上的泪眼……这些本该只属于家人的瞬间,现在成了AI生成图片的“参考图库”。过去几年,Meta、OpenAI都因为用用户照片训练模型被骂过,谷歌这次走得更近——它不是“训练模型”,而是“实时调用”你的私人照片。

有人担心:万一哪天AI生成了一张你和已故亲人“重逢”的照片,你会不会更难过?或者,如果有人黑进系统,是不是就能用你的照片伪造出你没做过的事?

谷歌怎么说?能关,能查,不训练

谷歌没回避问题。他们说:这功能**默认关闭**,你得自己点“同意”才能用。目前只对美国地区的Google One AI Premium用户开放,不是谁都能用。

他们还承诺:你相册里的照片**不会被用来训练任何AI模型**。也就是说,你的照片只在你用的时候“临时看看”,用完就忘,不会存进数据库,也不会被别人用。

更贴心的是,每次你生成一张图,点一下“来源”按钮,就能看到系统是参考了哪几张照片——是这张你和老婆在公园的合影,还是那张你儿子骑自行车的抓拍。你清楚知道AI从哪“抄”的,也能随时删掉这些关联。

这功能,真的有用吗?

说实话,对很多人来说,这功能可能根本用不上。但对另一些人——比如想给妈妈做一张“年轻时的样子”当生日礼物的子女,想给远在老家的父母看“你穿婚纱的样子”的年轻人,或者想给宠物狗生成一张“它当超人”的趣味图的主人——这功能省了大功夫。

它不是科幻,也不是监控。它更像一个懂你家事的助手,不问你“你长什么样”,而是直接翻你相册找答案。技术本身没对错,关键是你愿不愿意让它看。

现在,你手里的手机,比你想象中更了解你。而这次更新,只是它开始“看”你生活的第一步。