谷歌Cloud Next '26发布全新AI基础设施,企业智能体时代正式开启

在Cloud Next '26大会上,谷歌没有再谈“大模型”或“多模态”,而是直接亮出了它为真实企业场景打造的AI运行底座。这一次,重点不再是模型有多聪明,而是:如何让AI真正干活,而且能持续、安全、大规模地干。

算力不再拼单芯片,改拼“集群规模”

谷歌这次彻底放弃了“单颗TPU跑得最快”的宣传路线。第八代TPU被拆成两个版本:TPU8t专攻训练,TPU8i专攻推理——不是为了炫技,而是因为企业真正需要的是:训练一次,推理百万次。

更关键的是,谷歌推出了名为“Virgo”的新一代互联网络,能把多达一百万个TPU芯片连成一个整体。这不是概念演示,而是为真实场景准备的——比如一家全球银行要同时跑上千个财务审核代理,或一家制造企业要实时分析全球工厂的传感器数据。过去需要几十个集群并行,现在一个Virgo网络就能搞定。

TPU8i在芯片上增加了更多SRAM缓存,专门适配混合专家模型(MoE),让每次调用更省资源。配合全新的Boardfly拓扑结构,芯片之间的通信延迟降低了近40%。这意味着,你的AI代理不再“卡顿”,响应速度接近人工操作。

让AI代理自己“上手”工作,不再靠人盯着

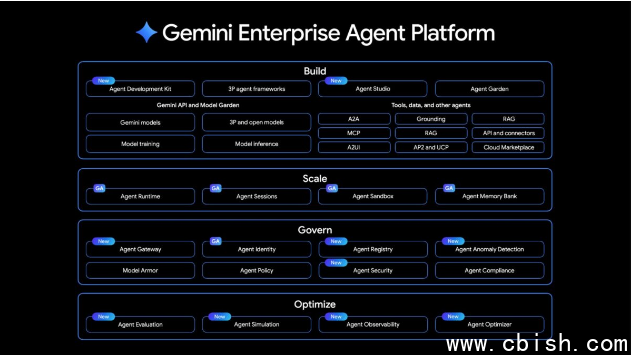

谷歌推出了基于Vertex AI的“Gemini企业代理平台”,不是又一个聊天机器人界面,而是一套让AI能独立完成复杂任务的工具箱。

在“Agent Studio”里,企业可以定义一套工作流:比如“自动处理报销申请”——AI能读邮件、查发票、核对预算、调取审批记录、发通知、归档文件,全程不需要人工干预。它还能记住历史决策,下次遇到类似情况,不用从头学起。

这听起来很美好,但企业最怕的,是AI乱来。为此,谷歌内置了三道防线:

- 加密身份验证:每个AI代理都有独立数字身份,像员工一样被授权访问特定数据。

- 异常行为检测:如果某个代理突然大量下载客户名单,系统会立刻冻结并报警。

- 沙盒模拟测试:上线前,所有代理都要在虚拟环境中跑一遍,模拟黑客攻击、数据污染、流程中断等极端情况。

把AI塞进你每天用的办公软件里

最让人意外的是,谷歌没搞一个新APP,而是把AI直接嵌进了Gmail、Docs、Drive这些你天天用的工具里——新推出的“Workspace Intelligence”层,让AI能跨应用理解上下文。

举个例子:你在Gmail里收到一封供应商发来的合同,附件是PDF。你把它拖进Docs,AI自动识别出关键条款,对比历史合同,发现付款周期比去年延长了15天,然后在Drive里查到上一份合同的审批记录,最后在你的日历里提醒:“建议明天10点前与法务确认延期条款,上次类似情况耗时3天。”

这套系统不只支持Gemini 3.1 Pro,也开放给Claude Opus 4.7、Mistral等第三方模型。企业可以自由选择谁来“干活”,谷歌只负责提供稳定的基础设施和安全框架。

这不是AI的升级,是工作方式的重构

过去几年,AI被当成“高级助手”——帮你写邮件、做PPT、总结会议纪要。而今天,谷歌真正想做的,是让AI成为“数字员工”:能独立负责流程、有权限边界、能被审计、能长期积累经验。

对IT部门来说,这意味着运维压力变了:不再管模型参数,而是管代理的权限、流程和异常日志。

对业务部门来说,这意味着:报销流程从平均3天缩短到3小时;客服能自动处理80%的常规投诉;供应链预测不再依赖人工经验,而是由多个代理实时协同调整。

谷歌这次没喊“革命”,但它的动作,正在悄悄改写企业里谁在做事、怎么做事、谁来负责的底层逻辑。