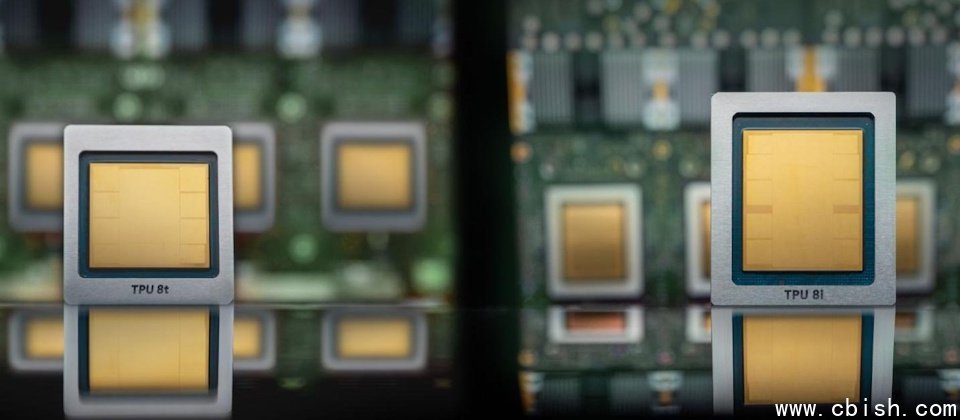

Google周三(4月22日)在Cloud Next大会期间发布了第八代张量处理单元(Tensor Processing Unit,TPU),首次将TPU产品线拆分为训练与推理两种专用芯片,分别为TPU 8t与TPU 8i,主打支持AI代理(Agentic AI)所需的高性能计算与低延迟响应能力。

Google指出,AI代理的兴起使模型从单纯生成转向推理与任务执行,对计算架构的需求显著提升,原先兼顾训练与推理的单一设计已逐渐出现瓶颈,因此在第八代TPU中采用专业化设计,推出TPU 8t与TPU 8i以应对不同计算需求。

其中,TPU 8t主要面向大型模型训练场景,强调高计算吞吐量与大规模扩展能力。其架构可在单个超级计算集群(Superpod)(由数千颗TPU组成)中运行,并通过高带宽内存与强化的芯片间互连设计,支持大规模分布式训练。Google表示,相较于前一代产品,TPU 8t在训练性能上可提升近3倍,有助于缩短大型模型的开发周期。

而TPU 8i则聚焦AI推理与实时推理场景,特别是多个AI代理同时运行的应用。其设计重点在于降低延迟与提升并发处理能力,使AI在回答问题或执行任务时能更快响应。为此,TPU 8i强化了内存与芯片内数据处理能力,减少数据往返传输时间,并优化多芯片间的通信效率。Google表示,相较于前一代产品,TPU 8i在推理的成本效益可提升约80%,可在相同成本下支持更多使用需求。

美国金融科技公司Citadel Securities技术长Josh Woods表示,使用Google Cloud第七代Ironwood TPU,已能将最具挑战性的工作负载执行速度提升2至4倍,同时降低30%成本,并期待进一步引入搭载TPU 8t与TPU 8i的Google Cloud AI Hypercomputer,以持续优化训练成本结构并提升系统扩展能力。

两款芯片预计将于今年晚些时候正式上线,并整合至Google AI Hypercomputer平台。该平台为一体化AI计算架构,融合了定制化硬件(包括计算、存储与网络)以及框架与推理引擎等软件资源,TPU 8t与TPU 8i则是其中的核心计算引擎。