谷歌推出全新研究助手:Deep Research 与 Deep Research Max 正式开放预览

谷歌近日正式推出两款基于 Gemini 3.1 Pro 架构的新型研究助手——Deep Research 和 Deep Research Max,并通过 Gemini API 的付费层级向开发者和企业用户开放预览。这两款工具不是简单的问答机器人,而是能像人类研究员一样,自主规划任务、调用多源数据、反复推敲结论,最终输出结构化报告的智能系统。

如果你经常需要整理行业报告、分析市场趋势、对比竞品数据,或者为投资决策搜集大量资料,这两款工具可能正是你一直在找的“数字助手”。

两个版本,两种用法:快还是深,你来选

Deep Research 标准版主打“快”。它能在几秒内完成对公开信息的整合,适合需要快速响应的场景——比如会议前临时查资料、写简报、整理新闻摘要。响应迅速,延迟低,像一个随时待命的助理。

而 Deep Research Max 则是为“深度”而生。它不追求速度,而是花上几分钟甚至更长时间,反复交叉验证信息、调用多个数据源、迭代分析逻辑,最终生成一份结构完整、引用清晰的深度报告。典型应用场景包括:尽职调查、学术文献综述、政策影响分析、财报深度解读等。

举个例子:你要评估一家新能源公司的投资价值,Standard 版可能给你一份摘要和三份新闻链接;Max 版则会帮你整理该公司近三年财报、上下游供应商信息、政策补贴变化、竞争对手动态,甚至自动对比行业平均毛利率,最终输出一份带图表和数据来源的PDF报告。

不只是搜索,还能连内部数据库

这次最大的突破,是它不再只依赖公开网页。Deep Research 系列首次支持“模型上下文协议”(MCP),这意味着它能安全接入企业内部的数据库——比如你公司的客户数据、销售记录、财务系统,甚至是受权限保护的行业研报平台(如Bloomberg、Wind、同花顺iFinD等)。

对于金融、咨询、法律、医药等行业用户来说,这意味你可以直接让AI在你自己的数据基础上做分析,而无需手动下载、粘贴、整理。数据不出内网,安全性和实用性都大幅提升。

能画图、能读文件,还能协作

过去AI生成的报告,往往只有文字。现在,Deep Research 可以直接生成清晰的图表、信息图,输出为标准HTML格式,复制粘贴进PPT或邮件里就能用,无需再用Excel重新画图。

它还能处理你上传的PDF、Word、Excel、音频、视频文件。比如你上传一份会议录音,它能自动转录、提炼重点、标注关键数据点;你给一份年报PDF,它能提取财务数据、对比历史趋势、指出异常波动。

更实用的是,开发者可以完全关闭它的网络访问功能。如果你在处理敏感项目,比如并购案或未公开产品规划,你可以让AI只在本地数据中工作,彻底避免信息外泄。

性能如何?别被数字忽悠,看实际效果

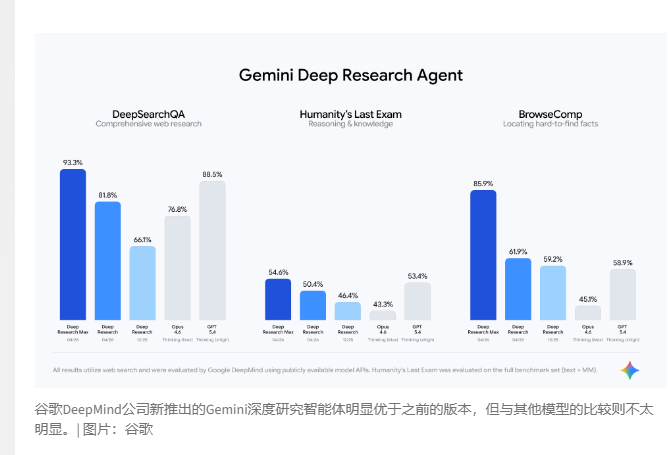

谷歌声称 Deep Research Max 在检索和推理任务上比上一代提升明显。但业内专家提醒:这类测试往往在特定数据集上进行,结果不能直接等同于真实工作中的表现。

与其纠结它是不是“比GPT-5强”,不如问问自己:它能不能帮你省下3小时?能不能把一份原本要找5个人才能凑齐的报告,一个人搞定?能不能在不漏掉关键数据的前提下,减少你的误判风险?

目前,它已经和谷歌自家的 NotebookLM、搜索研究功能打通,未来将通过 Google Cloud 推向企业市场。如果你是企业IT负责人、分析师、研究员或创业者,建议尽早申请预览资格,亲自试一试它在你日常场景中的真实表现。

从“查资料”到“做分析”:AI正在变成你的搭档

过去,AI是搜索引擎的升级版——你问,它答。

现在,Deep Research 系列开始扮演“研究搭档”的角色:你提出问题,它制定计划;你提供材料,它挖掘线索;你给出方向,它持续优化结论。它不会替你做决定,但它能帮你把模糊的想法,变成有数据支撑的判断。

这不是科幻,也不是营销话术。它正在悄悄改变专业工作者的工作方式——不是取代人,而是让人从重复劳动中解放出来,去思考真正重要的事。