大模型推理新突破:预填充能独立跑在千里之外了

你有没有遇到过这样的情况:用大模型聊天,输入一段长文后,等了足足三五秒,才冒出第一个字?不是网络慢,也不是服务器崩了,而是模型在“消化”你的输入——这个过程叫“预填充”。它像一场高强度的脑力运算,要把你发的几百个字全部理解、编码、存进缓存,才能开始一个字一个字地“说话”。

过去,这个“大脑启动”和“出口说话”的过程,全挤在一台机器上干。结果就是:算力强的GPU闲着等内存带宽,带宽再高也跟不上计算节奏。好比你让一个短跑冠军去搬砖,搬得再快,砖头堆在门口也出不来。

拆开干:预填充和解码,各回各家

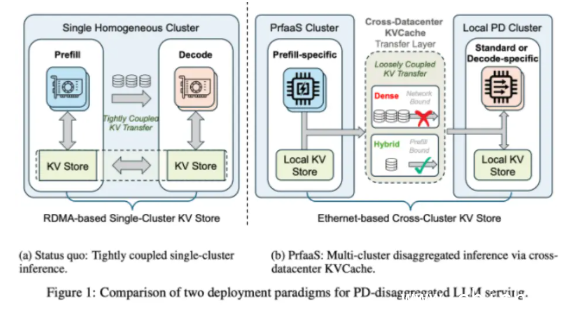

最近,Moonshot AI 和清华大学的团队搞了个挺实在的改动:把“预填充”和“解码”彻底分开,就像把厨房和餐厅拆成两个店。

你发来的长文本,不再由你正在用的App所在的服务器处理。它被自动转到一个专门的、配备大量高端GPU的“预填充中心”——可能在杭州,也可能在乌兰察布。那里专攻计算,几秒钟就把你的输入变成一坨高效缓存(KVCache),然后通过普通千兆以太网,传给离你更近的“解码节点”。

这个解码节点呢?不用装顶级显卡,用中低端卡就能跑,因为它只干一件事:一个字一个字往外吐。就像餐厅后厨把菜做好打包,前台服务员端上来,速度自然快了。

怎么保证传输不卡?靠“双时间调度”

你可能会问:那传缓存会不会慢?万一网络一堵,岂不是更卡?

他们真想明白了。系统不是一传了之,而是用“双时间尺度调度”——短周期看实时流量,长周期看趋势波动。比如早上9点用户集中提问,系统就提前多开几个预填充通道;深夜流量低,就自动收缩资源,省电省钱。

传输路径也不是随便走。系统会选最优网络链路,避开拥堵节点,甚至能动态切换运营商线路。实测中,哪怕你传的是5000字的论文摘要,延迟波动也控制在毫秒级,比传统方式稳定得多。

效果有多猛?真实数据说话

在真实业务场景中,这套叫“预填充即服务”(PrfaaS)的架构,直接让系统吞吐量提升了54%。也就是说,原来一台服务器每分钟能处理100个请求,现在能干154个。

用户最能感受到的是:第一个字出来的时间,平均缩短了40%以上。你输入“帮我写一封辞职信”,不再是等得心焦,而是几乎“秒回”第一个词。

更关键的是,硬件成本降了。企业不用再为每个服务节点都配顶配A100,中低端卡+远程预填充,能撑起同样规模的用户量。对中小公司来说,这意味AI服务的门槛,真正开始往下掉。

不只是技术升级,是服务模式的改变

这背后,其实是一次服务架构的“去中心化”尝试。过去,AI服务是“全栈一体”,现在变成“模块化服务”——计算、网络、存储各司其职,像水电一样按需调用。

未来,你可能根本不知道自己用的AI,是哪个城市、哪台机器在干活。就像你打电话,不用关心信号塔在哪,只要接得通、声音清就行。

这次合作,不是发论文刷榜,而是真在跑业务。Moonshot 已经在自家产品中上线了PrfaaS,支撑着数百万日活用户的长文本交互。而清华团队也在和几家云厂商接洽,准备把这套方案开放给更多开发者。

说白了,这不是“黑科技”,是把AI服务从“奢侈品”往“基础设施”拉的一次踏实推进。下次你再用AI写报告、改合同、总结会议,如果觉得它“突然变快了”,别惊讶——可能是千里之外,有人替你先动了脑。