谷歌新算法让大模型跑得更快、更省电

3月26日,谷歌研究团队正式发布了一项名为 TurboQuant 的新技术,专门解决大语言模型(LLM)在处理长文本时“内存吃不消”的老问题。简单说,它能让模型在不损失精度的前提下,把内存占用压缩到原来的六分之一,在 NVIDIA H100 显卡上,注意力计算速度最高提升8倍——这意味着你用一张消费级显卡,也能流畅跑起几十万字的对话或文档分析。

这项技术不靠训练模型、不改代码结构,直接“插件式”接入现有系统,像 vLLM、TensorRT 这类主流推理框架都能无缝对接。对开发者、企业、甚至个人爱好者来说,这都不是一个“实验室玩具”,而是一次实实在在的效率跃升。

为什么 KV Cache 成了大模型的“拦路虎”

大模型说话不是“想一句说一句”,它得记住前面所有内容,才能连贯回答。这个“记忆”就存在一个叫 KV Cache 的地方——每个词都会生成一组向量,存起来供后续计算使用。

问题来了:上下文从1000字变成1万字,KV Cache 就要膨胀10倍;到10万字?内存直接爆掉。很多公司跑长文本服务,不是模型不够强,而是显存不够用,被迫拆成小段处理,结果回答断断续续,体验大打折扣。

过去有人用量化技术压缩这些向量,比如把32位浮点数压成8位整数,省点内存。但问题在于:压缩后还得存一堆“校准参数”——缩放系数、偏移量,这些参数往往还是用全精度存,像给省下的钱又贴了张邮票,净节省没多少。

TurboQuant 怎么做到“压缩不丢精度”

TurboQuant 没有花哨的神经网络,而是用两步“数学 tricks”搞定:

第一步:PolarQuant —— 换个坐标系来存

传统方法把向量当“直角坐标”存(x, y, z),每个维度都要单独压缩。TurboQuant 把它转成“极坐标”——就像用角度和距离描述一个点。角度范围有限,基本在 -π 到 π 之间,不需要再算边界、归一化,省掉一大块存储开销。这就像把一堆杂乱的书,按主题分类后放进标准尺寸的书架,不再需要每个书架都定制尺寸。

第二步:QJL —— 用1比特“纠错”

转成极坐标后还是会有点误差。TurboQuant 不用再存一堆修正值,而是用一种叫 Johnson-Lindenstrauss 的数学技巧,把误差“打散”到随机方向上,再用最极端的量化方式——1比特(+1 或 -1)来记录。关键是,这套方法在计算注意力时,能自动抵消误差,完全不用额外存任何数据。

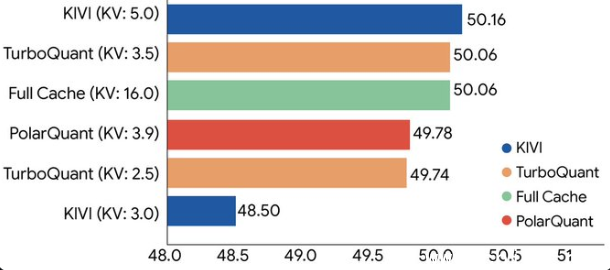

最终结果:KV Cache 从原本的每向量16~32比特,压缩到平均3比特左右,接近理论极限。更惊人的是,测试中完全没丢精度——你问它“前文第57页提到的公司名字是什么?”,它照样答得准。

实测数据:不是PPT,是真跑得动

谷歌团队在真实模型上做了测试:

- 在 Gemma、Mistral 等开源模型上,LongBench 长文本问答、代码生成、摘要任务,表现和原模型一模一样。

- 在“找针”测试(Needle In A Haystack)中,哪怕把“针”藏在10万字文档的中间,TurboQuant 也能100%找到,而传统方法早就乱了。

- NVIDIA H100 上实测:4比特配置下,注意力计算速度提升最高达8倍,内存占用下降6~8倍。

- 在 GloVe 等通用向量库上,它的检索召回率也超过 PQ、RabbiQ 等老牌压缩方法。

这意味着,如果你原本需要4张H100跑一个长对话服务,现在可能一张就够了。甚至,像 RTX 4090 这类消费级显卡,也能跑起10万token级别的上下文——过去这几乎是不可能的事。

对普通人和企业意味着什么

这不是实验室的数字游戏。它直接改变AI的使用门槛:

- 个人开发者:不再需要租昂贵云GPU,本地跑长文档分析、写小说辅助、读PDF总结,变得可行。

- 中小企业:客服机器人、合同分析、法律文书处理,成本直降,部署周期从几周缩短到几天。

- 云服务商:一台服务器能同时服务更多用户,电费、硬件折旧、散热成本大幅下降。

- 手机端AI:未来手机本地运行大模型,处理长对话、记忆用户习惯,不再是科幻。

更关键的是:它不需要你重新训练模型,也不需要改API。你现有的代码、模型、平台,加个插件就能升级——这在AI领域,几乎是罕见的“开箱即用”。

下一步:开源,还是被集成?

谷歌已将该成果提交至 ICLR 2026,并透露相关代码将逐步开源。目前,vLLM、TensorRT、Hugging Face Transformers 等主流框架团队已开始评估接入方案。业内预测,最快今年下半年,你就能在主流AI平台看到“启用TurboQuant”选项。

如果说过去AI的瓶颈在算力,那现在,真正的卡点已经变成“内存效率”。TurboQuant 不是下一个大模型,但它可能是让大模型真正走进日常的那把钥匙。