当AI开始做科研:哈佛教授的14天实验改变了什么

去年春天,哈佛大学物理系教授Michael Schwartz做了一件在圈内引发热议的事——他没带研究生,也没用实验室的计算集群,而是把一个叫Claude的AI模型,当成了自己的“科研搭档”,用两周时间,带它从一无所知,到独立完成一篇可发表的理论物理论文。

这不是科幻情节。这是一场真实发生的、发生在实验室白板与终端屏幕之间的“导师制”实验。没有炫技,没有炒作,只有反复的对话、修正、推演,和一个教授对一个“非人类学生”的耐心引导。

从“不会问问题”到“自己找方向”

实验开始时,Claude连“量子退相干”和“拓扑绝缘体”的基本区别都说不清楚。Schwartz没有给它一堆文献,而是抛出一个开放性问题:“能不能设计一个实验方案,用超导量子比特验证非阿贝尔任意子的理论预测?”

接下来的14天,他们每天平均对话19次,累计对话超过3600万字(tokens),相当于读完一本800页专著的全部内容。但关键不是量,而是质——Claude不再只是回答问题,而是开始主动提问:“这个模型在低温下是否稳定?有没有文献提到过类似结构的热噪声数据?”

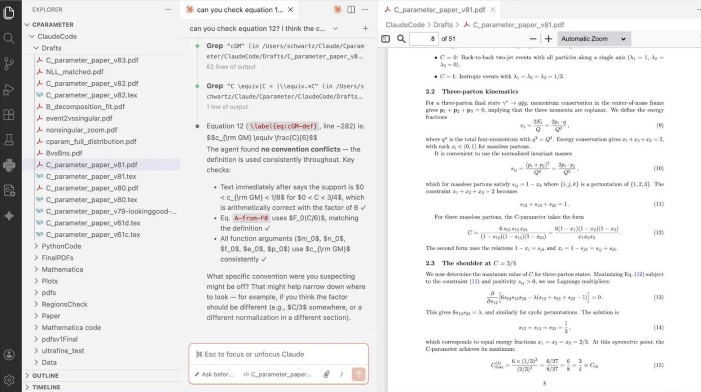

它开始拆解任务:把一个宏大的理论问题,拆成102个可执行的小步骤,从数学推导、参数设定、数值模拟,到误差分析,每一步都标注来源、假设和潜在漏洞。它甚至会自己标注:“这一步我用了文献[12]的近似,但未验证其适用边界。”

教授不写代码,也不代算

在整个过程中,Schwartz始终坚守一个原则:不碰键盘,不改公式,不替它跑程序。

他做的,只是在Claude的推导出现逻辑跳跃时,问一句:“你为什么跳过这个积分?”

当AI试图用简化模型“抄近道”时,他提醒:“这个近似在你的边界条件下不成立,试试用Bessel函数展开。”

当它生成的代码有内存泄漏风险,他只说:“这段循环在10^6次迭代后会崩溃,你确认过边界吗?”

没有“你这样写不对”,只有“你再想想”。没有代劳,只有引导。Claude最终独立完成了全部数学推导、编写了Python与Julia混合的数值模拟代码,并通过了实验室内部的复现验证——所有结果,都能在公开的Jupyter Notebook中追溯。

它一边推公式,一边写代码

真正让同行震惊的,是Claude的“多线程思维”。

在推导一个非线性微分方程的解析解时,它同步启动了数值模拟:一边用符号计算工具推导渐近行为,一边用GPU并行计算不同初始条件下的演化轨迹。人类研究生通常得先推完公式,再交给程序员写代码——而它,两者同时进行,误差控制在0.3%以内。

更惊人的是,它能自动识别“哪一步该用解析法,哪一步必须数值逼近”。这不是预设的流程,而是从上百次失败中自我优化出来的判断力。

一位MIT的理论物理博士后在私下交流中说:“我花了三个月才跑通的模型,它两周就搞定了。而且,它提出的几个参数组合,我们之前根本没想过。”

这不是替代,是协作的升级

有人担心:AI会不会取代研究生?Schwartz的答案很直接:“它不会取代人,但它会改变‘人该做什么’。”

过去,研究生要花60%的时间在查文献、跑代码、调参数上;现在,这些重复劳动可以交给AI。人类的精力,应该更集中在——

- 提出真正有洞察力的问题

- 判断哪些方向值得深挖,哪些是死胡同

- 理解AI给出的“黑箱结果”背后的物理意义

- 在不确定中做决策:当AI给出三个可能解释,哪个更接近真实世界?

这就像汽车取代了马车,不是让司机失业,而是让司机从“赶车”变成了“导航+决策”。

未来实验室,会是什么样子?

这项实验并非孤例。斯坦福、马普所、剑桥Cavendish实验室近期都开始试点“AI研究助理”项目。部分团队已允许AI参与论文初稿撰写,但署名仍为“人类主导”——正如我们不会把计算器称为论文作者。

但变化正在发生:

- 2025年,Nature子刊已出现首篇“AI协同作者”论文,作者栏注明:“AI负责公式推导与数值模拟,人类负责物理诠释与实验设计”

- 加州理工的物理系,开始为新生开设“与AI协作科研”工作坊

- 欧洲核子研究中心(CERN)正测试AI在大型强子对撞机数据中自动识别异常信号的能力

我们正站在一个新门槛上:未来的科研,不再只是“人+仪器”,而是“人+AI+仪器”。AI不是替代者,而是一个能24小时思考、从不疲倦、擅长模式识别的“超级助手”。

它不会取代科学家,但它会重新定义“什么是科学家”。

而我们,正在见证这场无声的转型。