内存太慢?谷歌新方案让大模型跑得更快、更省

你有没有遇到过这样的情况:问AI一个长问题,它卡几秒才回复;或者在手机上用大模型App,用几分钟就发热、掉帧?问题不在模型不够聪明,而在于它“记性太差”——每次对话都要把大量中间数据存进内存,越聊越卡,直到撑不住。

这背后的关键,是“KV缓存”——一种AI在生成文本时临时保存上下文的内存机制。一句话讲明白:你每多问一句,它就得记下几十KB的信息,长对话一超过几千字,内存直接爆炸。主流模型动不动就要占用几十GB显存,哪怕你用的是H100,也扛不住连续对话。

现在,谷歌研究院在2026年3月推出了一种叫 TurboQuant 的新技术,直接把这个问题“砍掉一大半”。

不改模型,不重训练,内存直接压缩到1/6

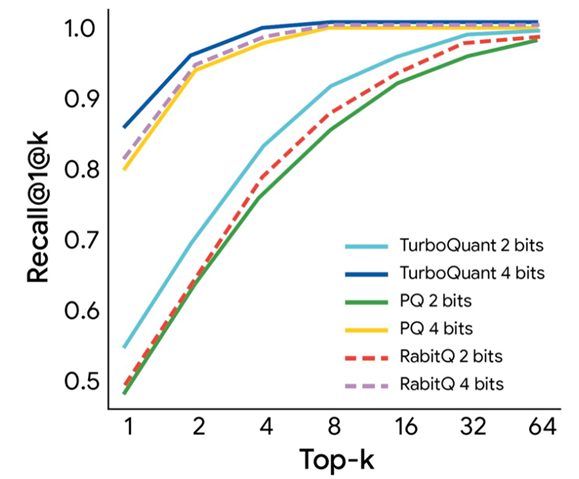

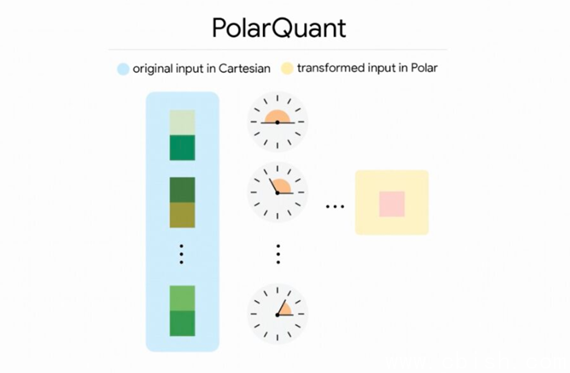

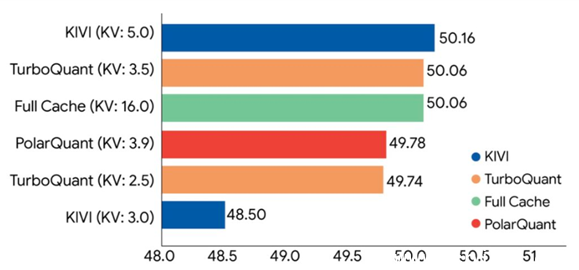

TurboQuant 不是换个新模型,也不是重新训练AI,它就像给AI的“短期记忆”装了个压缩包。传统KV缓存用32位浮点数存数据,一个词就要占128字节。TurboQuant 把它压缩到3比特——也就是原来的1/64,实际部署中通过4比特优化,综合效率提升更稳。

测试用的是Gemma、Mistral这些开源模型,没动过一行代码,没加任何微调。在“大海捞针”这种极端测试里——把关键信息藏在5万字文本中间,让AI找出来——TurboQuant 依然能100%答对,精度零损失。

这不是理论数据,是实打实跑出来的结果。开发者可以直接插进现有系统,像换内存条一样简单。

H100上速度提升8倍,手机端也能跑大模型

光省内存还不够,关键是快。

在NVIDIA H100上,TurboQuant 把推理速度从原来的基准提升了整整8倍。这意味着什么?

- 原来10秒才能生成的长回复,现在1.2秒就出来;

- 原来只能支持2000字上下文,现在轻松撑到1.5万字;

- 企业部署一个客服AI,服务器数量能砍掉70%。

更关键的是,它让“本地运行大模型”变得现实了。以前你得靠云服务,现在用RTX 4090甚至M3 Max的Mac,都能流畅跑70亿参数模型的长对话。苹果和安卓开发者已经在悄悄测试,未来几个月,你可能在微信、钉钉、Notion里,直接用上不卡顿的本地AI助手。

下个月正式开源,开发者可立即上手

TurboQuant 计划在2026年4月的ICLR大会上公开论文,同日开源核心代码和量化工具包。GitHub页面已提前开放预注册,首批接入的包括Hugging Face、vLLM、Llama.cpp等主流推理框架。

对个人开发者:你可以用它在自家笔记本上跑70B模型,不用开会员、不用等API排队。

对企业用户:部署成本直降,云服务账单可能减少一半。

对硬件厂商:内存带宽压力下降,未来AI芯片设计方向将更聚焦算力而非显存容量。

这不是“又一个AI论文”,这是真正能落地的性能革命。如果你正在开发AI应用、做模型部署、或者只是想用上更顺滑的AI助手——TurboQuant,是你接下来半年最该关注的技术。