苹果联合威斯康星大学推出新框架,让AI看图更像人

过去,AI描述图片总显得“隔靴搔痒”——看到一张餐桌照片,它可能会说“桌上有一件食物”,却分不清是苹果还是橙子;看到街景,它可能笼统地提一句“有人在走路”,却说不清是穿红外套的老人,还是远处正在等公交的孩子。这种“看得见却说不清”的问题,一直困扰着计算机视觉领域。

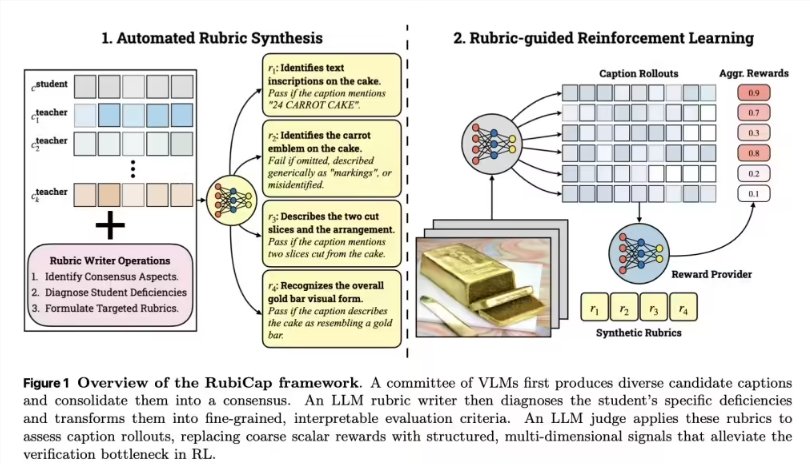

近日,苹果公司联合威斯康星大学麦迪逊分校发布了一套名为 RubiCap 的全新训练系统,目标很明确:让AI像人一样,逐寸观察图片,说出每一个值得留意的细节——不是“有个人”,而是“左下角穿灰色风衣、提着购物袋、正低头看手机的女性”。

不靠堆参数,靠“好老师”教AI看细节

传统方法依赖人工标注,成本高、效率低;用大模型自动生成描述,又容易“脑补”——明明没看到狗,它偏说“一只金毛在草地上奔跑”。为了解决这个问题,团队设计了一套“教练+裁判”机制。

系统先让GPT-5和Gemini 2.5 Pro生成几十种可能的描述,然后由Gemini 2.5 Pro提炼出“什么样的描述才算好”——比如,要包含位置、颜色、动作、关系,不能凭空添加不存在的元素。最后,由Qwen2.5担任“裁判”,对每条描述打分:哪里说对了,哪里多编了,哪里漏了关键细节。

这套机制不靠海量数据“喂”模型,而是像教孩子认图一样,反复指出错误、引导修正。结果是:模型学会了“看准了再说”,而不是“猜一个听起来合理的答案”。

小模型赢了大模型:70亿参数吊打720亿

最让人意外的是,这套系统训练出的RubiCap模型,参数规模远小于行业主流。最顶尖的版本只有70亿参数,却在多个盲测中击败了参数高达720亿的模型——在“幻觉率”(即编造不存在内容的次数)上,RubiCap低了近40%。

更颠覆认知的是,一个仅30亿参数的“轻量版”RubiCap,在某些精细描述任务上,表现甚至超过了70亿版本。这说明,模型的“聪明程度”,不在于体积多大,而在于训练方式是否精准。

业内专家指出,这可能是图像理解领域的一次“范式转移”——从“越大越好”转向“越准越好”。未来,手机、无人机、智能眼镜等设备,或许能用更小的模型实现实时、高精度的图像描述,而不再依赖云端大模型。

不只是实验室成果,真实场景已开始测试

据苹果内部人士透露,RubiCap已在部分iOS功能中进行小范围测试,例如:为视障用户实时朗读照片内容、在照片App中自动生成更精准的标签、甚至辅助家庭监控系统识别“孩子独自在客厅”或“老人跌倒后未起身”等关键场景。

威斯康星大学团队也表示,他们正与医院合作,尝试用该技术辅助放射科医生分析X光片——不是替代医生,而是帮AI更准确地指出“右肺上叶有模糊阴影,疑似结节,建议复查”。

这项技术没有炫目的术语,也没有“颠覆性革命”的口号。但它做了一件更实在的事:让AI不再“说废话”,而是真正学会“看清楚、说清楚”。而这,或许才是AI走向实用的第一步。