影视级配音新标准:Fun-CineForge 让声音真正“活”在画面里

你有没有看过一部动画或剧集,配音听起来“对不上嘴”?明明角色张嘴了,声音却慢了半拍;情绪明明在爆发,声音却平得像念稿?这些问题,困扰了影视后期行业多年。传统AI配音能念出字,却读不懂情绪,更跟不上唇动。现在,通义实验室带来了真正为影视制作而生的解决方案——Fun-CineForge,一个开源、可落地、专为高精度配音设计的多模态大模型。

不只是“念台词”,而是让声音和角色一起呼吸

Fun-CineForge 不是又一个文字转语音工具。它从一开始就瞄准了影视级制作中最难啃的骨头:

- 唇动精准匹配:哪怕角色只动了0.1秒的嘴角,声音也能卡在那个帧上,不是“差不多”,而是“刚刚好”。

- 情绪有层次:愤怒不是大声,是气息的撕裂;悲伤不是低沉,是声带的颤抖。模型结合面部微表情和台词语境,让声音自带情绪温度。

- 角色音色不漂移:同一个角色,从清晨对话到深夜怒吼,音色始终如一。不再出现“主角突然变声优”的尴尬。

- 遮挡也能对得上:角色转身、被道具挡住、甚至只露半张脸——只要时间轴在,声音就能准时切入,毫秒不差。

这些不是实验室里的理想参数,而是实拍片场里导演和音效师天天在对抗的问题。Fun-CineForge 让他们第一次有了“能用”的AI工具。

背后的真功夫:数据和时间,才是秘密武器

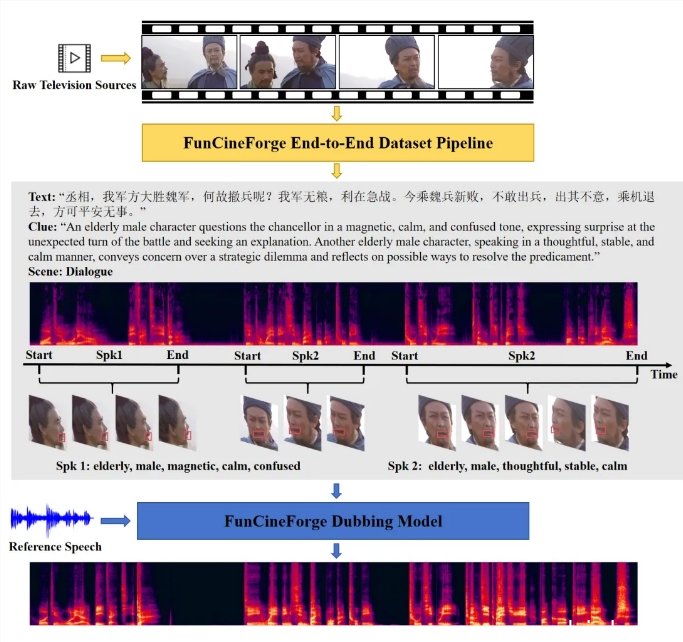

要让AI听懂“画面里的声音”,光靠算法不够。通义实验室花了两年,构建了业内首个专为影视配音训练的高质量数据集——CineDub。

这个数据集不是简单剪辑片段拼起来的。它通过“思维链纠错”技术,自动清洗了数万小时的影视原声,将中英文转录错误率压到1%-2%——远低于行业平均的5%-8%。说话人分离错误率更是降到1.2%,意味着哪怕十个人同时说话,系统也能准确分辨谁在说哪句。

更关键的是,Fun-CineForge 首次引入了“时间模态”——这不是视觉、音频或文本的简单叠加,而是把“时间”本身当作一个可学习的维度。模型不再依赖“看到脸”才能对口型,它学会了“听节奏、看帧序、猜动作”。即使画面里角色被黑影遮住、镜头切到空镜,它依然能精准预测声音该在哪儿出现。

真实效果:不只是比AI强,是让专业团队愿意用

在与 DeepDubber-V1 等主流模型的对比测试中,Fun-CineForge 在词错率(WER)、唇动同步度(LSE-C/D)和音色相似度三项核心指标上全面领先。但真正让行业侧目的是——它第一次稳定支持双人及以上对话的连贯配音。

过去,AI配音在多人对话中极易“抢话”或“断连”。而 Fun-CineForge 在30秒以内的多角色对白片段中,表现稳定、自然,几乎没有“AI感”。一位参与内测的动画工作室负责人说:“我们试了三个版本,只有这个,导演没喊‘重来’。”

它不追求“炫技”,只解决一个最朴素的问题:让声音,看起来是角色发出来的。

开源,免费,即用

Fun-CineForge 完全开源,不设商业门槛。无论是独立动画人、小型工作室,还是大型影视公司,都可以直接下载使用。

- GitHub: https://github.com/FunAudioLLM/FunCineForge

- Hugging Face: https://huggingface.co/FunAudioLLM/Fun-CineForge

- ModelScope: https://www.modelscope.cn/models/FunAudioLLM/Fun-CineForge/

配套的 CineDub 数据集和构建流程也一并开放,方便社区持续优化。我们不希望它成为大厂的专属工具,而是希望它成为每一个认真做内容的人,都能用上的“声音画笔”。

配音,不该是后期的妥协,而该是创作的一部分。Fun-CineForge,让声音回归角色。