Kotlin开源库Tracy专注于增强AI应用的可观测性,能够追踪LLM调用、工具执行与应用程序流程。该库基于OpenTelemetry构建,帮助开发者调试失败情况、测量执行时间,并掌握模型调用、工具调用与自定义应用程序逻辑的运行状况。

Tracy支持常见的Kotlin与LLM集成栈,包括OkHttp与Ktor客户端,也可与OpenAI、Anthropic和Gemini等相关客户端配合使用。其设计重点在于,不要求开发者必须通过特定AI框架的API发起调用才能生成追踪数据,而是可通过API客户端或HTTP客户端层级的追踪机制收集遥测数据,再结合函数或代码块层级的追踪,梳理AI组件与AI代理内部状态之间的时间顺序与因果关系。

与Spring AI、Koog等具备内置可观测性的AI框架相比,官方指出,这类框架通常要求LLM调用必须通过框架自身的API发起,才会生成追踪数据,且较难覆盖框架外部的应用流程。Tracy提供三种高级追踪方式:使用withSpan包裹特定代码块、直接为LLM客户端启用追踪,以及通过@Trace注解追踪函数或接口方法。以工具调用为例,开发者只需在接口方法上添加@Trace注解,所有实现类均可自动继承相同的追踪配置,减少逐个手动添加追踪代码的工作量。

在数据内容方面,Tracy默认追踪的是元数据,例如调用的API、模型与参数,不会直接记录输入与输出内容。若开发者在开发阶段需要保留LLM的输入与输出以便调试,也可通过编程方式启用,或通过环境变量开启。

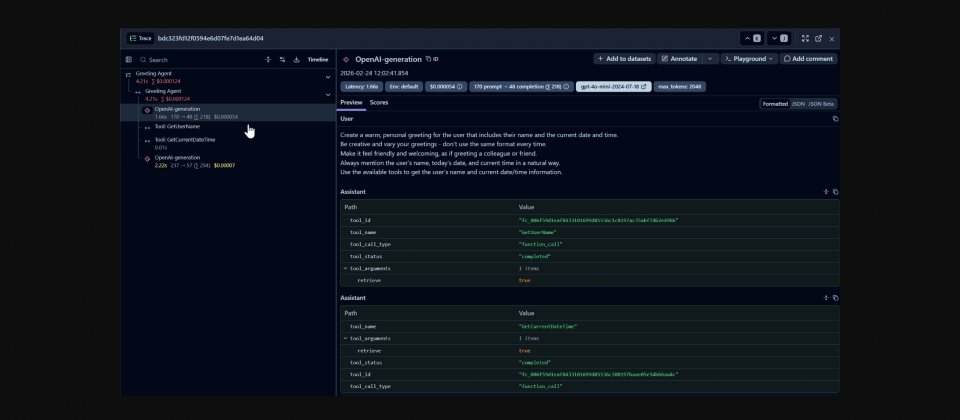

Tracy收集的追踪数据可导出至各类兼容OpenTelemetry的后端,包括Jaeger、Zipkin与Grafana,也可直接集成Langfuse与Weights & Biases Weave等LLM工程平台。官方还提到,代码仓库已提供多个示例,包含将文章中的聊天应用示例接入追踪与遥测导出的完整实现。