谷歌AI助手开始“自己操作手机”了,真不是特效

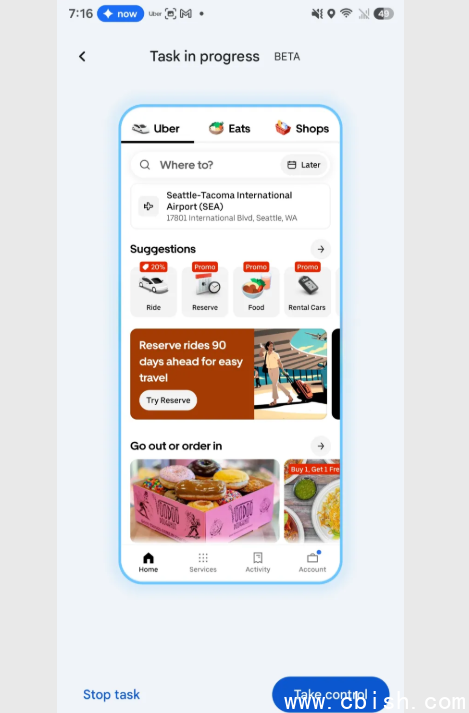

你有没有想过,手机能听懂你说“帮我叫辆车去机场”,然后自己打开Uber、选航站楼、填地址、点确认——全程不用你动一下手指?这不是科幻片,也不是PPT演示,而是谷歌今天正式开启Beta测试的全新功能:基于Gemini的“任务自动化”。它不靠后台接口,不靠开发者配合,就靠“看屏幕”和“点屏幕”,像真人一样用你的手机。

它不是在回答你,是在替你做事

过去你问AI:“今天天气怎么样?”它会回你一段文字。现在你问:“帮我点杯Flat White和牛角包”,它会自己打开星巴克App,滑到菜单页,找到你要的单品,加进购物车,甚至能识别出“双份浓缩”和“无糖”这种细节——不是靠预设关键词,是真正在“看”屏幕、认图标、读文字。

打车也一样。你说“去浦东机场T2”,它会自动启动Uber,弹出航站楼选项,等你点头确认,再自动输入地址、选车型、下单。全程你只需要说一句话,剩下的,手机自己搞定。

这功能目前优先支持美团、饿了么、滴滴、Uber这些日常高频应用。你不用等商家适配,也不用装什么插件,只要手机里有这些App,它就能“上手操作”——就像你把手机借给朋友,让他帮你点个外卖。

安全不是口号,是每一步都让你看着

有人担心:它自己点单,万一点错了、多付了怎么办?谷歌没躲这个问题——每一步你都看得清清楚楚。

当你让它操作时,手机会弹出一个小窗口,实时播放它在做什么:滑到哪、点哪个按钮、输入什么内容。你想停?随时点“接管”就能夺回控制权。最关键的是,付款前它会死死卡住,不让你点“确认”,必须你亲手点下去才执行。这不是“智能”,这是“有分寸的帮手”。

去年就有用户反馈,某些AI助手“自作主张”订了错的餐厅、选了贵的车型。这次谷歌直接把“最终决定权”交还给人——AI是司机,但钥匙在你手里。

为什么这次不一样?因为它不靠“写代码”

过去想让App自动帮你做事,得靠开发者写API、对接系统、申请权限,费时费力。比如你想要一个“一键叫车”功能,得等滴滴、高德、Uber都愿意开放接口——这在现实中几乎不可能。

而这次,谷歌绕开了所有技术壁垒。它不靠后台通信,不靠系统权限,就是像你一样——用手指“看”屏幕、“点”按钮。这意味着,哪怕是一个没开放API的小众外卖平台,只要它能用,AI就能学着用。

这背后是谷歌多年积累的视觉识别和操作预测能力,但你不需要懂这些。你只需要知道:以后你不用在十几个App里来回切换了。一句话,手机自己跑完所有流程。

现在能用吗?怎么体验?

目前该功能仅在部分Android设备上开放Beta测试,主要面向美国、英国、加拿大等地的谷歌账号用户,国内用户暂未开放。但如果你是Pixel 8 Pro或更新机型,且系统更新到Android 15以上,可以去“Google Assistant”设置里看看有没有“任务自动化”入口。

谷歌官方表示,未来几个月会逐步扩大范围,支持更多城市、更多应用,包括订电影票、买日用品、预约理发等高频场景。他们没说什么时候上线中国,但根据过往节奏,一旦海外验证成熟,国内版大概率会在2025年中前跟进。

别再问“AI能帮我什么”了,现在该问“它还能帮你做什么”

我们曾以为AI助手是“语音版的搜索引擎”——问天气、查新闻、设闹钟。但现在,它开始接管那些琐碎、重复、让人烦躁的日常任务:点餐、打车、买咖啡、订票……这些事,以前你得花5分钟在手机里“打转”,现在,你只需要说一句:“帮我弄一下”。

这不是升级,是生活方式的改变。你不再是一个“操作手机的人”,而是一个“指挥生活的人”。

它还不够完美——有时候会慢半拍,偶尔认错图标,遇到复杂菜单还会犹豫。但它的方向很清晰:手机,不该再是你每天花半小时折腾的工具。它该是那个,默默替你把杂事做完的“数字管家”。