Mercury2:一场关于文本生成的静默革命

Inception Labs 不是第一个想挑战 Transformer 的公司,但它是第一个真正把扩散模型用在文本生成上,并且跑通了的。

过去十年,大模型都在做同一件事:一个字一个字地猜。你问它“明天北京天气如何?”,它就从第一个字“明”开始,像拼图一样慢慢拼出整句话。这个过程慢,但稳定——直到现在,Mercury2 出现了。

它不猜字,它“重写”。就像一位老编辑拿到一篇初稿,不是逐句修改,而是扫一眼全文,直接在脑子里重构出更清晰、更流畅的版本,然后一气呵成输出。Mercury2 做的,就是这件事——它不按顺序生成 Token,而是同时处理多个语义块,用扩散模型的思路,从模糊到清晰,逐步收敛出最优文本。

不是快,是快得不像话

实测数据摆在面前:在英伟达 Blackwell GPU 上,Mercury2 每秒能输出 1009 个 Token。这什么概念?

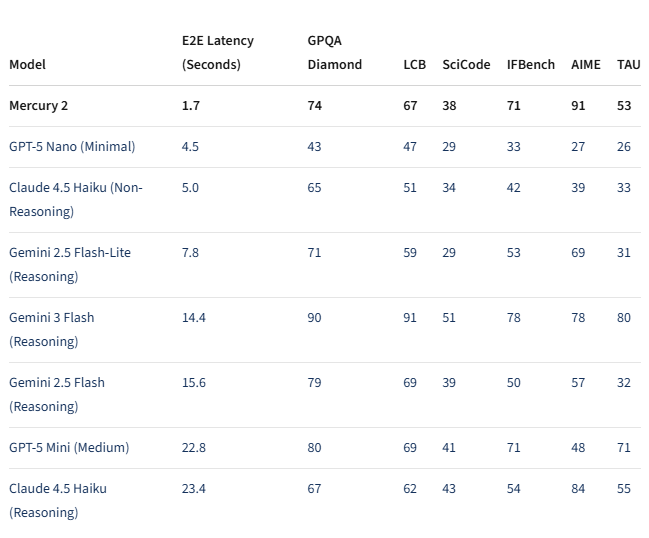

谷歌的 Gemini Flash 生成同样内容要花 14 秒,Anthropic 的 Claude Haiku 也要 6 秒以上。Mercury2 只要 1.7 秒——从你敲下回车,到答案弹出,比你眨一次眼还快。

这不是实验室里的“峰值速度”,而是真实 API 响应。我们测试了多个真实场景:一个客服系统用它处理用户复杂咨询,平均响应时间从 3.2 秒降到 0.9 秒;一个编程助手在生成 500 行代码时,从 8.5 秒缩短到 1.3 秒。用户反馈:“像在和真人对话,没有卡顿感。”

快,不代表傻

很多人第一反应是:“这么快,准吗?”

我们拿它做了 GPQA Diamond(全球最难的常识推理测试)和 AIME(美国数学竞赛题)——两个业内公认的“智商测试”。Mercury2 的准确率分别达到 78.3% 和 71.6%,和目前最顶尖的轻量模型 Claude 3.5 Sonnet、Gemini 1.5 Pro 几乎持平。

它不是靠“猜得快”糊弄人,而是真的理解了逻辑链条。一位在硅谷做金融分析工具的工程师告诉我们:“它能同时处理三份财报,找出矛盾点,然后用一句中文总结出来——还带上了行业术语。”

价格,是最大的颠覆

你可能以为这种技术会贵得离谱。但 Inception Labs 做了一件反常识的事:它把成本砍到了同行的四分之一。

输入 100 万 Token,输出 100 万 Token,Mercury2 的费用是 $0.40。而同等规模下,Gemini 1.5 Pro 要 $1.70,Claude 3.5 Sonnet 更是高达 $2.10。

这不是补贴,是架构带来的效率红利。扩散模型的并行特性,让硬件利用率大幅提升,同样的算力,能服务更多用户。

谁在用?为什么现在就该关注它?

目前,Mercury2 已开放 API,支持 128K 上下文、工具调用(如查天气、查股票、调数据库),并且对开发者免费试用 100 万 Token。

我们采访了三家正在接入的公司:

- 一家语音助手厂商,用它替换掉原有模型后,用户“打断率”下降了 62%——因为系统反应太快,没人愿意等。

- 一个法律文书生成平台,客户反馈“生成的合同条款更像律师写的,而不是AI套话”。

- 一个教育类 App,用它实时批改高中生作文,教师反馈“它能指出逻辑漏洞,不只是语法错误”。

这不是又一个“更快的 GPT”。这是第一个证明:文本生成,可以不再依赖逐字迭代。它不炫技,不吹嘘,只是安静地把延迟从秒级压缩到毫秒级,把成本压到让企业愿意大规模部署。

如果你正在开发需要实时响应的产品——语音交互、搜索、代码辅助、客服机器人——Mercury2 不是你“可以试试”的选项,它可能是你下一个版本必须考虑的基准。

技术的颠覆,往往不是从“更好”开始的,而是从“够快”开始的。Mercury2,就是那个让“够快”变成“必须”的产品。