GPT-5.3-Codex 正式上线,开发者可以真正“对话”代码了

就在本月初,一小部分开发者率先体验了 OpenAI 最新推出的编程助手 GPT-5.3-Codex。如今,这款工具正式向全球开放。无论你是独立开发者、初创团队,还是大厂工程师,现在都可以通过 OpenAI 官方 API 或 OpenRouter 等第三方平台直接接入使用。

它不再只是“自动补全”,而是一个并肩作战的搭档

过去的 Codex 像个熟练的打字员——你写注释,它补代码。而 GPT-5.3-Codex 不同。它能看懂你项目里那些没写出来的逻辑:为什么这个接口要这么设计?为什么这个模块要拆成三个文件?它不再只是回答“怎么写”,而是开始问“为什么这么写”。

有开发者在测试中发现,当他们用中文描述“我想做一个支持用户上传 CSV 并自动生成可视化图表的后台服务,要能部署在云上,最好用 FastAPI”,GPT-5.3-Codex 不仅给出了完整的代码结构,还主动建议用 Redis 缓存解析结果、用 Celery 异步处理大文件,并提醒“别忘了加文件大小限制和类型校验”——这些细节,很多资深工程师都容易忽略。

边改边跑,上下文不会“失忆”

最让团队头疼的,往往是改需求时模型“翻脸不认人”——你改了一行,它忘了前面的架构;你加了个新功能,它重写了一半代码。GPT-5.3-Codex 解决了这个问题。

现在,你可以在生成代码的过程中随时打断:“等等,我不需要登录功能了,改成 OAuth2 第三方接入”“这个数据库设计太重了,换成 SQLite 可行吗?”——模型不会重置,不会跑偏,上下文完整保留。一位在 GitHub 上分享体验的前端工程师说:“这感觉就像和一个懂技术的同事一起写代码,他记得你每一步的意图。”

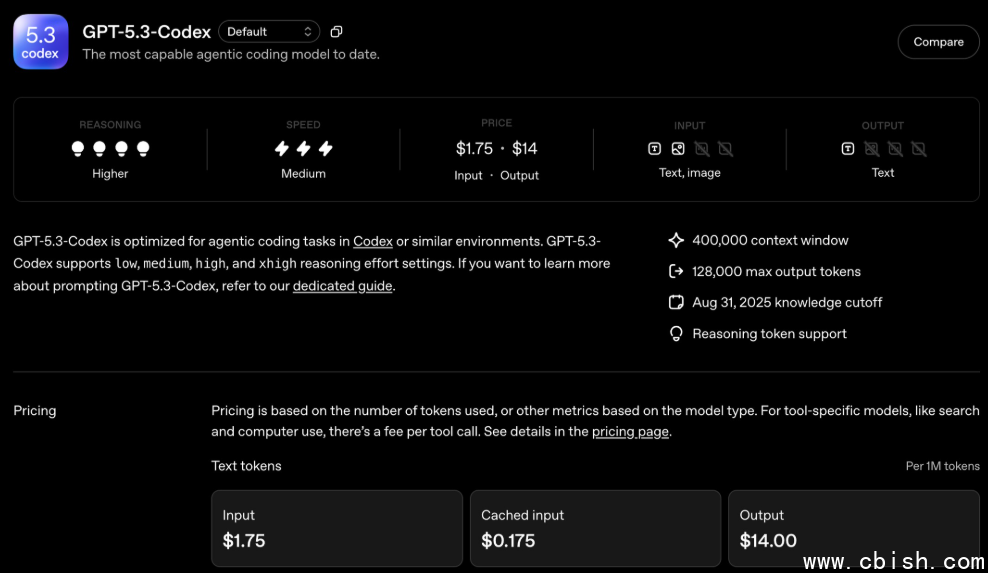

400K 上下文,一个文件夹的代码全都能看懂

以前的模型处理几百行代码就吃力,现在 GPT-5.3-Codex 支持 400K Tokens 的上下文窗口——这意味着你可以一次性上传整个 src 目录(含依赖配置、测试文件、文档),它能理解模块之间的调用关系、变量定义位置、甚至注释里的历史变更记录。

在真实项目测试中,它成功分析了一个包含 12 个模块、80 多个文件的 Python 微服务项目,准确指出了两个潜在的竞态条件,并推荐了更安全的锁机制。SWE-Bench Pro 测试中,它在 Python、Java、TypeScript 三大语言下的任务完成率均超过 87%,远超前代版本。

价格透明,按需付费,不被“算力陷阱”绑架

OpenAI 没有搞模糊定价。现在你可以清晰看到:每千次推理请求的费用、不同“推理强度”选项的耗时与成本对比。低强度适合快速原型,高强度用于深度重构——你控制节奏,而不是被模型拖着走。

目前,个人开发者每月有 1000 次免费调用额度,企业用户可申请更高配额。很多团队已经开始用它做 Code Review 预检、旧代码迁移、甚至为遗留系统生成单元测试——节省的不只是时间,还有反复沟通的成本。

现在就能用,别等“完美”再动手

它不是万能的。它还是会写错变量名,偶尔会推荐过时的库,也看不懂你项目里那些只有你们团队才懂的命名规范。但它已经足够聪明,能帮你省下 30% 以上的重复劳动。

如果你正在:

- 重构一个没人懂的老系统

- 想快速验证一个新想法

- 带新人上手复杂项目

- 被需求反复变更搞得焦头烂额

那么 GPT-5.3-Codex 不是“未来工具”,它就是你现在就能用的效率杠杆。别等它“更强大”,现在就开始用——因为真正的进步,从来不是等出来的,是用出来的。