苹果新研究:AI 设计师,真的能看懂美感了

你有没有试过让 AI 生成一个 App 界面?结果往往是:按钮排得像军训方阵,配色像老式 Windows 95,整体看着“能用”,但就是提不起兴趣点开。这不是 AI 不够聪明,而是它从来没真正“看过”一个好设计是怎么来的。

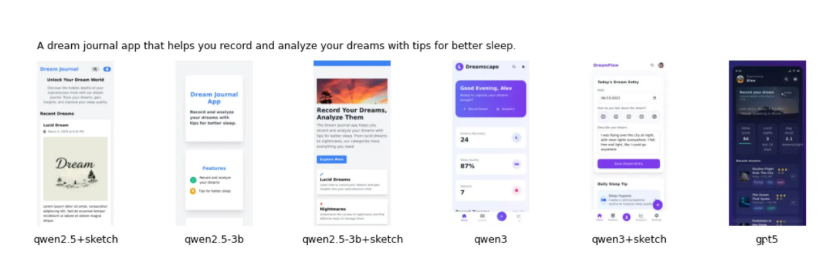

苹果最近公布了一项低调却颠覆性的研究——他们没用更多算力,也没堆参数,而是请了 21 位一线 UI/UX 设计师,手把手教 AI 怎么“看懂设计”。结果令人意外:一个参数量远小于 GPT-5 的开源模型 Qwen3-Coder,在界面逻辑、视觉节奏和细节处理上,竟然赢了。

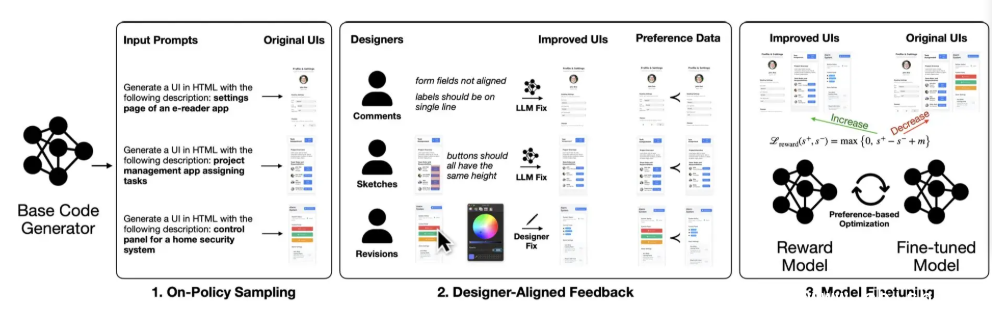

不是打分,是“画给你看”

过去,AI 训练靠的是“打分”:这个界面 7 分,那个 8 分。可设计师都知道,美感不是数字能说清的。一个按钮放左还是右?间距该是 8px 还是 12px?这些决定背后,是多年积累的视觉直觉。

苹果团队做了件很“笨”但很有效的事:他们让设计师直接在 AI 生成的界面上“动刀子”——用 Sketch 或 Figma 修改布局,手绘草图标注哪里太挤、哪里缺呼吸感,甚至贴上便签写:“这里颜色太吵了”“这个图标太卡通,和品牌对不上”。

1460 条真实反馈,不是冷冰冰的评分,而是带着温度的修改痕迹。团队把这些“修改痕迹”转化成 AI 能理解的信号,教会它:不是“好看”,而是“为什么好看”。

181 个草图,就够了

最让人惊讶的,是效率。传统方法要几万条数据才能微调,而 Qwen3-Coder 只用了 181 个设计师亲手修改的草图样本,性能就跃升了一个台阶。

为什么这么少?因为这些反馈不是“平均值”,是“精准靶点”。当设计师画一条线,把两个元素拉近,AI 不只是学“距离变小”,它学会了“视觉重心转移”;当设计师把紫色背景换成灰白,AI 懂了“情绪氛围”比“饱和度”更重要。

研究还发现一个关键数据:传统打分方式下,不同设计师对同一界面的评分一致性只有 49%——换句话说,两个人给同一个界面打分,有一半时间意见完全相反。但用“修改稿”做反馈,一致性直接飙升到 76%。这说明:**设计共识,藏在动作里,不在语言里。**

未来,设计师不是被取代,是被放大

这不只是一个“AI 更懂设计”的故事,而是一个协作模式的转折点。

未来的开发流程,可能不再是“产品经理写需求 → 设计师画稿 → 开发者写代码 → 反复修改”。而是:

- 你随手画个线框图,AI 一分钟内生成三个专业级版本;

- 你圈出一个按钮,说“这里太突兀”,AI 自动调整阴影、颜色、间距,甚至推荐符合品牌规范的替代图标;

- 你不再花 3 天改 10 个页面,而是用 1 小时聚焦在真正重要的决策上。

苹果的这项研究,没有吹嘘“AI 替代设计师”,反而证明了:**最好的 AI,是能听懂你没说出口的那句话的助手。**

对开发者和设计师来说,这意味着:你不再需要成为全栈专家,也不用再熬夜改像素。工具在进化,但创意的主导权,永远在人手里。

这不是 AI 设计的终点,而是人机协作的起点。