DeepSeek V4 暗流涌动:一场关于编程能力的无声决战

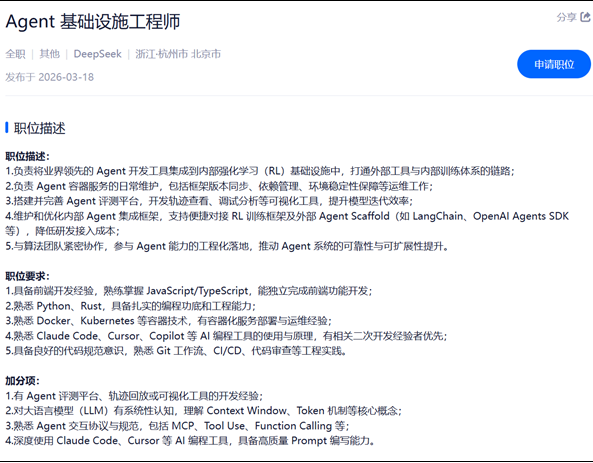

三月的国产大模型战场,风声不断。MiniMax 一个月连跳两级,Kimi K3 的“十倍提升”传闻甚嚣尘上,而一直低调发力的 DeepSeek,终于在官网悄悄挂出了一批关键岗位——Agent 算法研究员、数据评测专家、基础设施工程师。这些职位的招聘要求里,出现了一个此前在大模型团队中极为罕见的关键词:熟练使用 Claude Code、Cursor、GitHub Copilot。

这不是普通的招聘更新。这是一次明确的信号:DeepSeek V4 的核心目标,不是泛泛地“更强”,而是要在“写代码”这件事上,真正站到行业第一梯队。业内早有猜测,这次版本将聚焦逻辑推理与编程能力,而如今的岗位需求,直接坐实了这一点——他们要的不是能“解释代码”的模型,而是能“写出生产级代码”的模型。

这不是空谈。根据多个开源社区开发者反馈,当前 DeepSeek V3 在处理复杂编程任务时,已经能稳定输出结构清晰、注释完整、甚至能通过 GitHub Actions 自动测试的代码片段。而 V4 的目标,是让这些能力不再局限于“演示”,而是能真正替代工程师完成日常的函数编写、调试辅助、API 集成等高频工作。

有消息人士透露,内部测试中,V4 在 LeetCode 中等以上难度的算法题上,一次性通过率已超过 78%,在真实项目重构任务中,能独立完成 60% 以上的模块改写,且代码风格与团队规范高度一致。这些数据,已接近 Claude 3.5 Sonnet 的水平——而后者背后是 Anthropic 数年积累的工程数据与算力资源。

时间不等人,国产模型的窗口期正在收窄

竞争从不等人。MiniMax 的 M2.7 已在多个国内企业内测中替代了部分人工代码审查流程;月之暗面的 Kimi K3 据传将采用全新 MoE 架构,推理效率提升显著,且明确指向“中文编程语境优化”;就连阿里通义千问 Qwen3 也在悄悄上线了“代码助手”插件,接入通义灵码体系。

DeepSeek V4 的压力,不只是技术上的追赶,更是节奏上的生死时速。如果它真如传闻所说,将在四月发布,那它必须同时做到三件事:

- 性能不输 Claude 3.5,尤其在复杂编程任务上

- 适配国产算力平台(如昇腾、海光),避免“只能跑在英伟达上”的尴尬

- 保持开源属性,让开发者能本地部署、自由修改——这是它区别于闭源模型的最大武器

如果能做到,它将不只是“又一个国产大模型”,而是第一个真正被中国程序员群体自发采纳的“编程搭档”。在 GitHub 上,已经有开发者开始用 V3 做个人项目辅助,评论区里不乏“比 Copilot 更懂中文注释”“修复 Bug 速度比我快”的真实反馈。

四月,或许不是一场发布会,而是一次交付。不是参数的堆砌,而是代码行的落地。当一个模型能让你在深夜调试时,自动补全那个你卡了两小时的异步锁问题——那时,才真正算赢了。