苹果新突破:一张照片,秒变真实3D模型

你有没有想过,只需用iPhone拍一张普通照片,就能立刻在空间中看到一个立体、逼真、能从任何角度查看的3D物体?这不是科幻,苹果团队刚刚让这个场景成为现实。

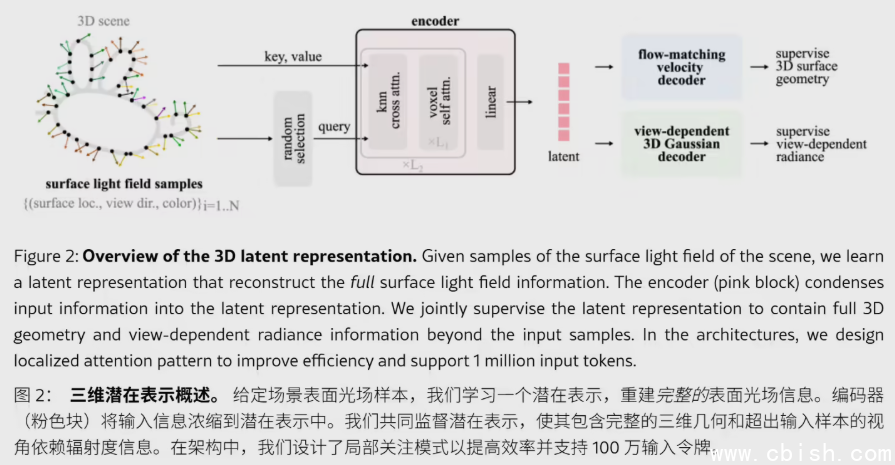

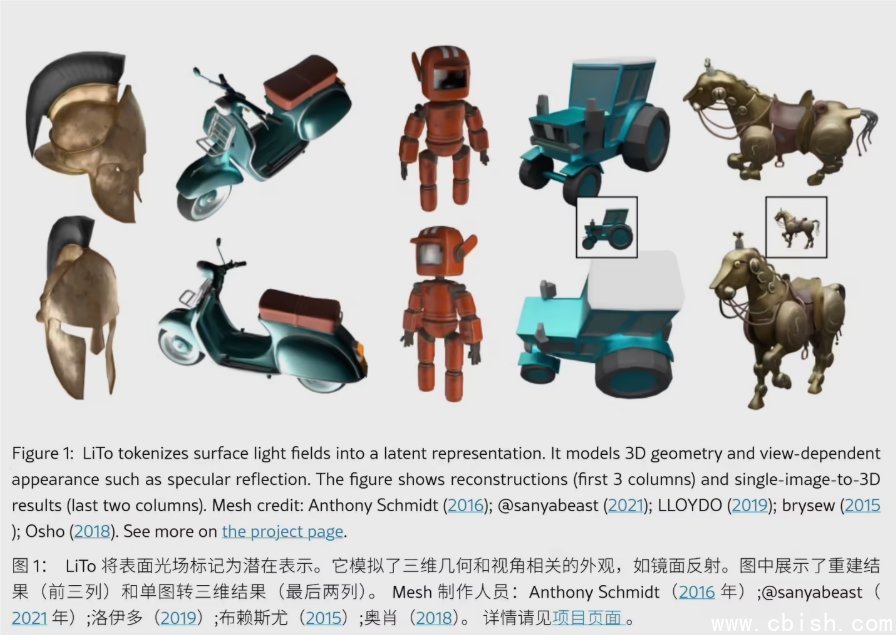

他们发布了一项名为“LiTo”(Surface Light Field Tokenization)的新技术,能在单张2D照片的基础上,重建出具备真实光影效果的3D模型。没有复杂的扫描设备,不需要多角度拍摄,甚至连反光、阴影、镜面高光这些最难模拟的细节,都能自动还原。

为什么这张照片能“活”起来?

过去,从一张照片生成3D模型,最大的问题就是“假”。你转个角度,物体表面的反光就乱了,高光像贴上去的贴纸,阴影方向对不上,看着像玩具模型。这不是技术不够,而是系统只记住了“像素长什么样”,没理解“光是怎么照在物体上的”。

LiTo不一样。它不是靠“看图背答案”,而是像一个经验丰富的摄影师,懂光、懂材质、懂结构。它通过学习成千上万个真实物体在不同光线和角度下的表现,掌握了“光与表面如何互动”的物理规律。哪怕你只拍了正面,它也能推断出背面的镜面反射、玻璃的折射、金属的冷光,甚至织物的微弱漫反射。

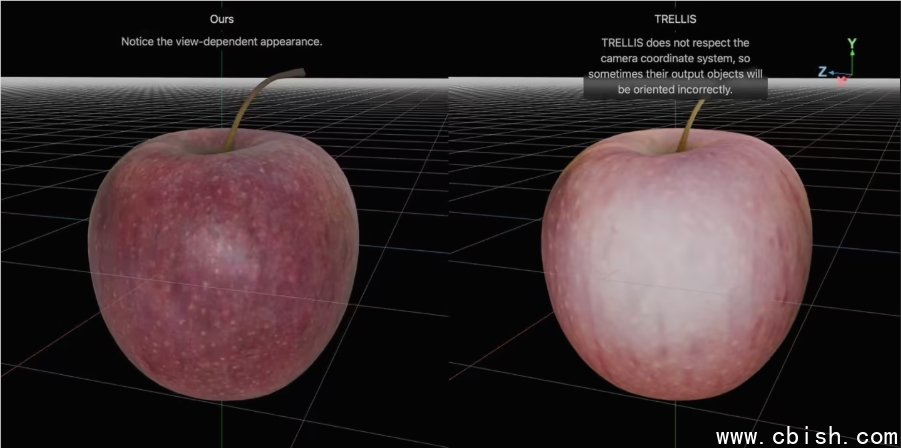

在苹果内部的对比测试中,LiTo在光影一致性、边缘细节、材质还原上,全面超越了当前业界公认的顶级模型TRELLIS。更关键的是——它不需要多张图片输入,一张就够了。

不是实验室demo,而是为Vision Pro量身打造

这项技术不是为了发论文。苹果训练LiTo时,用了超过5000个真实3D物体模型,在150种不同拍摄角度和3种标准光照环境(自然光、室内灯、侧光)下反复验证。每一个细节都经过真实物理数据校准——这不是AI“猜”的,是“算”出来的。

它的目标非常明确:让Vision Pro的虚拟世界,能无缝接入你手机里的现实世界。想象一下:

- 你在客厅拍下你最喜欢的咖啡杯,几秒钟后,它就出现在你的虚拟桌面上,你能绕着它走一圈,看到杯沿的反光、手柄的阴影、陶瓷的微小颗粒。

- 你拍下祖母的老怀表,不用3D建模师,不用专业软件,直接在空间中把它“放”进收藏柜,光线随房间变化,反射依然自然。

- 设计师拍下一件实物家具,立刻在AR中调整尺寸、颜色、摆放位置,所见即所得。

这不只是“好看”,而是彻底改变了内容创作的门槛。过去,3D建模是专业设计师的专利;现在,普通人用手机就能成为3D内容的创作者。

苹果的真正野心:让3D像拍照一样简单

苹果从不追求“最先进”,它追求“最自然”。当其他公司还在堆参数、拼算力时,苹果已经悄悄把复杂技术藏进了一个最简单的动作里——按下快门。

这不是第一次。iPhone的智能HDR、夜景模式、人像模式,都是把复杂的图像处理藏在“拍照”这个动作背后。LiTo,是这一逻辑的延续。

未来,当你在Apple Store试戴一副新眼镜,系统能立刻用你拍的照片生成它的3D模型,让你在虚拟镜中试戴;当你在二手平台想卖一件古董,只需拍张照,系统自动生成可旋转展示的3D商品页——不需要专业设备,不需要学习软件,不需要等待渲染。

这或许就是苹果在AI时代最深的布局:不是和OpenAI拼对话,不是和谷歌拼搜索,而是让每个人,都能用最熟悉的工具,创造最真实的数字世界。