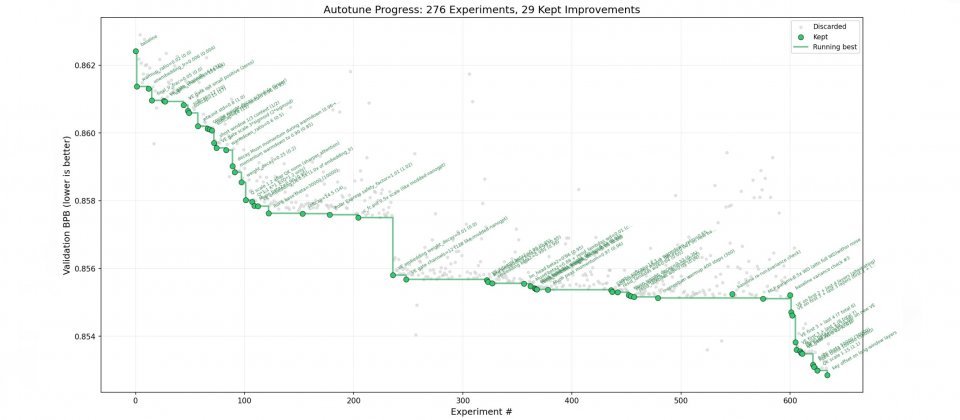

Andrej Karpathy使用Autoresearch自动调校nanochat语言模型约2天,经过276次实验后,累计29项可提升验证表现的调整。

OpenAI创始成员之一Andrej Karpathy在GitHub上发布了新项目Autoresearch,尝试将大型语言模型研究中原本依赖人工操作的流程,转化为可由AI代理反复执行的自动化实验循环。该项目一经发布便引发广泛关注,提供了一个轻量级的LLM训练框架,使AI代理能够在固定时间内修改训练脚本、启动实验、评估结果,并决定保留或放弃变更,从而在有限计算资源下,自动化处理原本由研究人员手动完成的参数调整与对比工作。

Autoresearch发布后迅速吸引开发者社区的关注。GitHub页面显示,该项目已获得约1.8万颗星标和约2300次分叉,并已有数十个议题和拉取请求。Andrej Karpathy在X平台发布的介绍帖文,累计观看量超过889万次,转发4300次,点赞2.6万次。

Autoresearch将整个实验架构简化至最小可行规模。Andrej Karpathy指出,整个代码库真正核心的仅有三个文件:prepare.py负责固定常量、数据准备与执行工具;train.py是唯一由代理修改的训练主程序;program.md则由人类编写,用于说明任务目标与背景信息。用户无需像传统研究流程那样直接修改多段Python代码,而是通过文字描述设定代理的工作框架,由代理自行尝试不同的模型结构、超参数与训练配置。

该项目强调可比较性,而非追求单次实验的最优结果。Autoresearch每次训练均限制在5分钟内,并以验证集上的指标评估模型表现,确保即使修改模型深度、批量大小、优化器或注意力机制,也能在相同时间预算下进行公平比较,更易识别真正有效的调整。Andrej Karpathy后续提到,他让Autoresearch持续调优nanochat模型约2天,累计发现约20项可降低验证损失的变更,其中一批调整在更大模型上仍能保持效果,最终使模型达到GPT-2水平所需时间,从2.02小时缩短至1.8小时。

Autoresearch的运行条件包括单张NVIDIA GPU、Python 3.10以上版本,以及uv包管理工具,目前主要测试平台为H100,CPU、Apple MPS及其他平台暂非主要支持对象。