谷歌推出Gemini 3.1 Flash-Lite:更快、更便宜、更实用

谷歌刚刚发布了Gemini系列的最新轻量级模型——Gemini 3.1 Flash-Lite。这不是一次炫技式的更新,而是一次实实在在的“降维打击”:它不追求参数规模,也不搞花哨概念,而是专注做一件事——让AI响应更快、用起来更便宜,让普通开发者和中小企业也能轻松用上高性能AI。

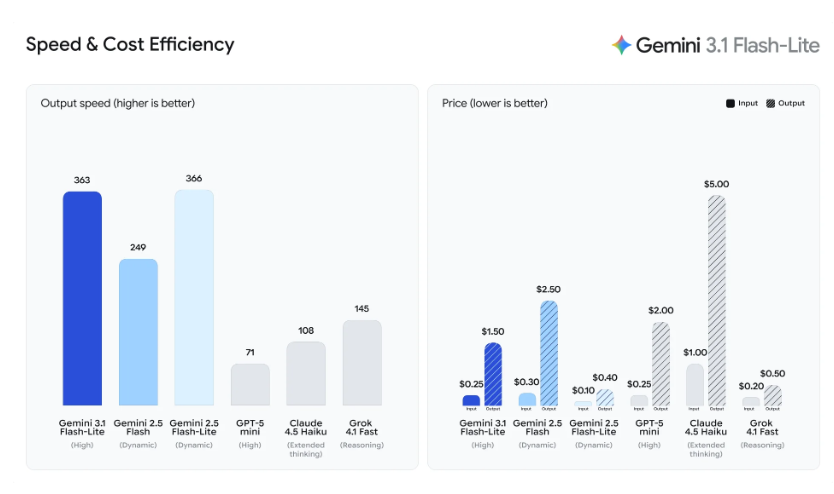

如果你用过之前的Gemini 2.5 Flash,你会发现这次升级几乎是“肉眼可见”的快。根据多个开发者实测,新模型从你输入问题到第一个字弹出来,平均时间缩短了近60%。也就是说,原本需要800毫秒的等待,现在不到350毫秒就回应了。这在聊天机器人、客服系统、实时翻译、语音交互这些场景里,体验差别巨大——用户根本感觉不到“卡顿”,就像在和真人对话。

价格低到让人意外

如果说速度是“体验”,那价格就是“门槛”。Gemini 3.1 Flash-Lite的定价直接打穿了行业底线:每百万输入Token只要0.25美元。换算一下,你用它处理100万次简单提问,成本不到3块钱人民币。

对比一下:OpenAI的GPT-4o Mini每百万Token约0.15美元输入,但输出要0.6美元;而Anthropic的Claude 3 Haiku输入约0.25美元,输出却要1.25美元。Gemini 3.1 Flash-Lite不仅输入便宜,输出也保持同样低价,整体成本比多数竞品低30%-50%。对于每天要处理数百万请求的SaaS产品、内容审核平台、自动化工具来说,这笔账算下来,一年能省下几十万甚至上百万。

不是“缩水版”,而是聪明的精简

很多人以为“轻量级”就是功能缩水。但Gemini 3.1 Flash-Lite偏偏反其道而行——它在多项基准测试中,表现甚至超过了上一代更大、更重的模型。比如在多语言翻译准确率、中文语义理解、逻辑判断题(如数学推理、因果分析)上,它的得分比Gemini 2.5 Flash高出10%-15%。

一位在硅谷做AI客服系统的工程师告诉我:“我们测试了5个轻量模型,只有它能在保持0.3秒响应的同时,正确识别用户话里的潜台词,比如‘这功能怎么用啊?’其实是抱怨操作太复杂,而不是真问说明书。”

它不是靠堆参数赢的,是靠训练数据和架构优化。谷歌这次把重点放在了“高频实用场景”上:电商客服、内容过滤、自动摘要、表单填写辅助、多语言实时对话——这些才是大多数开发者真正需要的。

能“调深度”,不是一刀切

最实用的一个新功能,叫“思考层级”(Thought Levels)。你不用再纠结“要快还是要准”——你可以自己选。

- 选“轻量模式”:处理简单任务,比如审核评论、翻译一句话、生成邮件草稿,速度飞快,成本极低。

- 选“深度模式”:遇到复杂需求,比如分析销售数据趋势、生成带图表的周报、推理用户意图链条,它会自动调用更强的推理能力,结果更严谨。

这个功能不是噱头。在Google AI Studio和Vertex AI里,开发者只需要在API调用时加一行参数,就能切换模式。不需要换模型、不需要重新训练,一套系统,两种用法。

现在就能用,但别等“完美”

目前,Gemini 3.1 Flash-Lite已开放给Google AI Studio的预览用户和企业级客户(Vertex AI)使用。普通开发者可以免费申请试用,额度足够做小项目测试。

它不是万能的。如果你要做科研级的数学推导、长篇小说创作、高精度医学诊断,它不是目标用户。但如果你是个创业者、独立开发者、中小团队,想快速上线一个AI功能,又不想被成本压垮——它可能是你今年见过最靠谱的选择。

谷歌这次没喊“革命”,也没吹“通用人工智能”。它只是默默做了一件事:让AI真正变得可用、可负担、可落地。