Google DeepMind 推出 Gemini 3.1 Flash-Lite:快到飞快,但不便宜

Google DeepMind 刚刚上线了 Gemini 3.1 Flash-Lite 的预览版——这不是一次小升级,而是一次“快得离谱”的重新定义。它继承了前代 Gemini 2.5 Flash-Lite 的闪电响应能力:每秒处理超 360 个 token,平均响应时间稳定在 5.1 秒左右。这意味着你输入一个问题,几乎在你打完句号的同时,答案就已经出现在屏幕上。

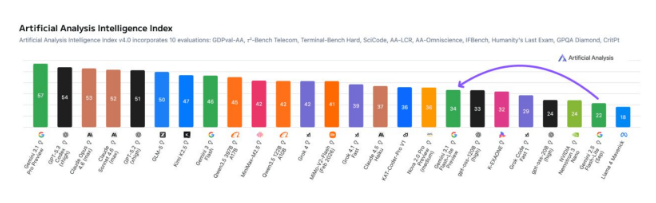

但这次,它不只是快。在 Artificial Analysis 的智能指数评估中,它的得分从 22 分跃升至 34 分,进步幅度高达 12 分,直接冲进全球开源和闭源模型的前五。在 Arena.ai 这个以“人类偏好”为标准的排行榜上,它以 1432 的 Elo 分数,击败了包括 Claude 3.5 Sonnet 在内的多个主流模型,成为目前最“讨人喜欢”的轻量级模型之一。

不只是快,还很聪明

很多人以为“Flash”系列就是个“快而弱”的工具人,但 Gemini 3.1 Flash-Lite 打破了这种偏见。在 GPQA Diamond(一个专门测试专家级科学推理的硬核测试)里,它拿下了 86.9% 的准确率——这个成绩,比 OpenAI 的 GPT-4o 和 Anthropic 的 Claude Opus 4.6 都要高。在 MMMU-Pro(多模态理解的终极挑战)中,它也达到了 76.8% 的准确率,能看懂复杂图表、理解医学影像中的细节,甚至能分析一份带公式的物理题截图。

更实用的是,它支持开发者自定义“思考深度”。你可以让它像普通聊天机器人一样快速回复“今天天气怎么样”,也可以让它切换成“深度模式”,花几秒钟分析一段代码、生成一个完整的 React 组件,或者帮你从一张产品图里提取所有参数并生成电商详情页文案。这种“一模型多用”的灵活性,让中小企业和独立开发者也能用上以前只有大厂才敢用的推理能力。

便宜?别想了,这次是为性能买单

但天下没有免费的午餐。Gemini 3.1 Flash-Lite 的价格变了。

输入 token 价格从原来的 $0.15 上调到 $0.25/百万,看起来还能接受。但输出价格——也就是你真正“拿到答案”的部分——从 $0.40 暴涨到 $1.50,涨幅高达 275%。换句话说,你以前花 1 美元能换 2500 个输出 token,现在只能换 666 个。

这不是“割韭菜”,而是现实的代价。要同时做到超高速、高准确率、多模态理解,计算资源消耗远超以往。Google 没有选择“压低价格换用户”,而是明确告诉你:如果你要的是“接近大模型的智能,但闪电般的速度”,那就得付相应的成本。

谁该用它?谁该绕道走?

如果你是:

- 做实时客服机器人的团队——它能秒回,还能理解用户上传的截图;

- 开发自动化工具的独立开发者——它能帮你写脚本、解析表格、生成 UI 代码;

- 教育或科研人员——它能快速解析论文图表、解释公式、做基础科学推理;

那它就是你目前能找到的最平衡的选择。

但如果你:

- 只是想每天问它“写首诗”“讲个笑话”;

- 需要每天处理数百万 token 的长文本摘要;

- 预算紧张,追求极致低价;

那你可能更适合 Claude Haiku 或 Llama 3.1 8B 这类真正便宜的模型。

现在能用吗?怎么试?

已经开放了。你可以在 Google AI Studio 和 Vertex AI 上直接注册测试,免费额度依然存在,适合先试再买。Google 没有搞“内测封号”,而是把门槛放得很低——这说明他们不只想卖 API,更想让开发者用起来,真正看到它的价值。

这波操作,不是在打价格战,而是在重新定义“轻量模型”的标准:不再是谁便宜谁赢,而是谁能在“快”和“聪明”之间,做得最像人。