GPT-5.4悄然现身:一场被泄露的行业地震

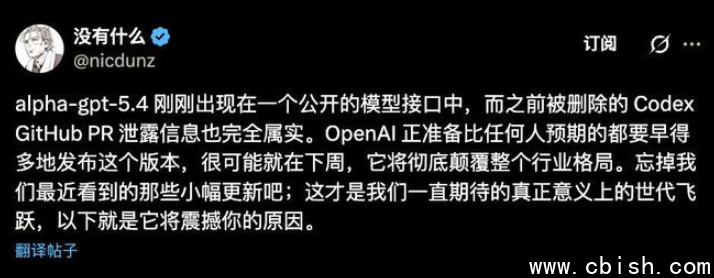

2026年3月2日凌晨,GitHub 上 OpenAI 的 Codex 仓库出现了一次异常提交。一名工程师误将“gpt-5.4”写入了模型版本判断逻辑,短短三分钟内,这段代码被数以千计的开发者截图、转发、分析。OpenAI 几乎立刻强制回滚了提交,改称“这是5.3的内部测试分支”,但没人相信这是一次简单的失误。

当晚,Reddit 的 r/MachineLearning 板块涌入超过8万条讨论,Twitter 上#GPT54话题在两小时内登上全球热搜。不是因为宣传,而是因为——这次泄露的东西,太像一个新时代的开端。

200万上下文:它不再“忘记”你

真正让人头皮发麻的,不是数字本身,而是背后的逻辑变化。

过去,AI 对话像一场场短暂的邂逅——你今天和它聊项目,明天重启会话,它就忘了你上周改过的代码、你偏好的注释风格、你用的调试工具链。GPT-5.4 不是“记住”了更多内容,而是第一次实现了真正的“状态延续”。

据多个独立开发者在 Discord 私域群组中分享的测试片段,该模型在跨会话后仍能准确调用你上一次使用的 API 密钥、记住你正在调试的 Docker 容器配置、甚至追踪你三次修改但未提交的前端组件结构。一位硅谷的全栈工程师在测试后写道:“它不像助手,更像一个坐在我工位对面、从不请假的同事。”

这背后是全新的 KV 缓存架构。据芯片分析师透露,OpenAI 已在内部部署了定制化 HBM3e 内存集群,单实例缓存容量突破 1.2TB,足以支撑百万级 token 的长期上下文维持。这不是算法升级,是硬件与系统的一次重构。

图像识别:不再“猜图”,而是“看图”

过去,AI 看图总像戴着毛玻璃眼镜——你给它一张 4K UI 设计稿,它说“这个按钮颜色太暗”,却分不清是 #2D2D2D 还是 #2E2E2E;你上传一张电路原理图,它误把电阻当电容。

GPT-5.4 的新图像处理模块,直接绕过了 JPEG、PNG 的压缩流程,从原始字节层开始解析。这意味着:你拖进去一张 Figma 导出的 SVG 文件,它能精确识别每个图层的坐标、字体字号、颜色十六进制值;你扔进一张 PCB 布局图,它能标出哪个电容焊点存在短路风险,甚至推测出设计者可能用的元器件型号。

有前端团队已开始用它做自动化设计评审。一位来自 Shopify 的工程师说:“我们以前要花两小时人工核对设计稿和代码实现的一致性,现在它半小时就能列出37处偏差,连字体行高差了0.5px都标出来了。”

它不再陪你聊天,它在替你干活

OpenAI 没有再提“多轮对话”“情感理解”这类老生常谈。他们的内部文档里,关键词是:Agent、Task Execution、Autonomous Workflow。

GPT-5.4 不再是“回答问题”的工具,而是能主动完成任务的数字员工。测试中,它能:

- 收到“把产品页的按钮颜色改成品牌蓝,适配暗黑模式”后,自动打开 Git 仓库、修改 CSS、生成对比截图、提交 PR 并附上测试报告;

- 监听你 Slack 上的讨论,发现“用户反馈登录页加载慢”,自动分析性能日志、定位瓶颈、提出优化方案并通知运维团队;

- 在你写代码时,默默在后台跑单元测试,发现失败就直接标注问题行,并建议修复方案。

这不是科幻。一位使用内测版的创业公司 CEO 告诉《The Information》:“我们裁掉了两个 junior engineer。他们干的活,现在由一个 GPT-5.4 实例和三个自动化脚本完成了。”

谁在为这场变革买单?

这场升级的代价,远不止代码。NVIDIA 在 2026 年初的财报电话会上首次承认:“我们正在为下一代 AI 推理需求做超前产能储备。”其 H100 和 B200 芯片的订单量在 2025 年第四季度激增 210%,主要来自云服务商和大型科技公司。

微软、亚马逊、谷歌都在紧急加购 HBM 内存模块。有供应链消息指出,SK 海力士的 HBM4 产能已全部被预订至 2027 年。

而 OpenAI 没有公布发布时间。他们只是悄悄在官网更新了 API 文档——新增了一个名为 stateful_session 的参数,文档写着:“适用于长期任务代理,需申请白名单。”

你不需要等官宣。当你发现某个你常用的工具突然能“记住”你过去的所有操作,不再问你“你上次说的项目是哪个?”——那才是真正的开始。