手机+20美元支架,就能采集机器人训练数据?蚂蚁数科这项技术让行业震惊

过去,训练一个能帮机器人做家务、开柜门、拿杯子的AI模型,需要昂贵的实验室设备:动辄十几万的高精度动作捕捉系统、多摄像头阵列、专业传感器,还得配一支工程师团队盯着数据。而现在,蚂蚁数科天玑实验室推出了一套“手机+颈挂支架”的方案,成本不到20美元,就能采集到高质量的第一人称交互视频——这不再是科幻场景,而是正在发生的现实。

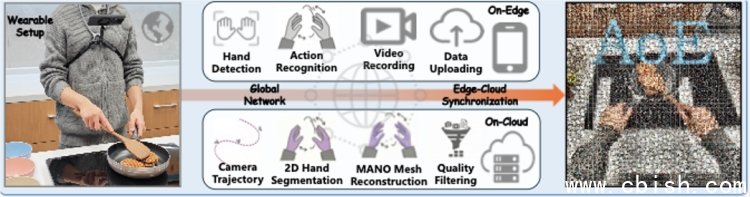

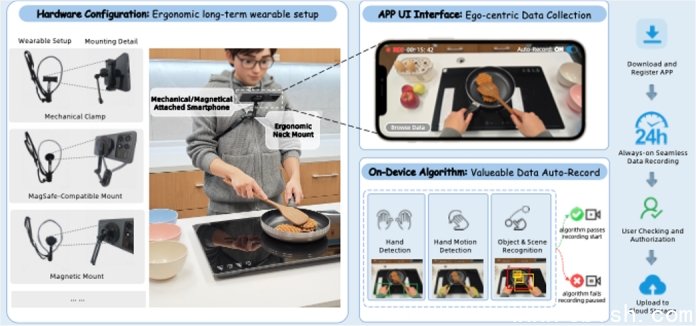

这套名为AoE(Always-On Egocentric)的系统,核心是一枚轻巧的颈挂支架,用磁吸或夹具把普通智能手机固定在胸前,像戴项链一样自然。用户日常走路、开门、拿东西、做饭,手机就在你眼前,持续记录你双手和物体的互动。没有复杂布线,不用专业训练,也不用改变生活习惯——你做什么,它就录什么。

50条数据成功率45%,200条AoE数据直接飙到95%

技术好不好,得看效果。团队用Unitree G1机器人做了一个简单测试:让它学会“打开柜门”。用传统遥操作方式,只给50条人工操控数据,机器人成功率只有45%。而换成200条由普通人用手机拍下的真实操作视频——有人是上班族,有人是老人,有人是孩子——机器人成功率直接跳到95%。

这不是偶然。在真实世界里,人开柜门的动作千差万别:有人先拉把手,有人先压门板;有人用拇指,有人用掌心。这些“不标准”的细节,恰恰是AI最需要学习的。专业设备拍的是“理想动作”,而AoE拍的是“真实生活”。

更关键的是,这套系统能同时支持上千台手机并发采集。数据自动上传云端,系统会自动剪辑、打标签、去重、过滤模糊画面。以前一个数据工程师忙一天,可能只能处理几十分钟视频;现在,系统一天能处理上百小时,准确率还超过90%。

不是“拍视频”,是自动变成“机器人教科书”

很多人以为,只要把手机对着手拍就行。但真实情况远不止如此。

AoE的真正突破,在于它能“读懂”视频里发生了什么。手机端有个轻量模型,一检测到手和物体接触超过1秒,就自动开始录制。录完后,云端的大模型会把一段30秒的视频,拆成一个个“动作单元”:比如“伸手→抓住把手→向左旋转→拉动→关门”——每个动作都自动打上标签,像教科书一样清晰。

这背后是蚂蚁数科团队两年多的打磨:他们训练模型识别200多种日常手部动作,从拧瓶盖到插充电线,从拉开抽屉到递杯子。这些动作,过去只能靠人工逐帧标注,耗时耗力。现在,系统自己就能完成。

一位参与测试的高校研究员说:“我们以前要花三个月整理100小时数据,现在一周就能拿到500小时、带语义标签的高质量数据。这简直是把‘数据工厂’搬进了每个人口袋。”

不只是机器人,养老、家政、工业维修都可能被改变

这项技术的潜力,远不止于实验室里的机器人。

在养老场景,老人自己操作电饭煲、开药盒、取药片的过程,可以被安全采集,用来训练助老机器人;在家庭保洁领域,清洁工擦窗、收衣服、整理沙发的动作,能教会扫地机器人更懂“家”;在工业维修中,老师傅拆装一台设备的每一个步骤,都能被记录下来,成为新员工的“数字师傅”。

更现实的是,它打破了数据垄断。过去,只有大公司能负担得起数据采集成本,小团队根本玩不起。现在,一个创业公司、一所地方高校,甚至一个独立开发者,只要买个20美元的支架,就能获得过去只有谷歌、OpenAI才有的数据资源。

蚂蚁数科的“AI落地”正在悄悄变快

这不是一次孤立的技术实验。2026年以来,蚂蚁数科明显加快了AI在产业端的落地节奏:成立“大模型技术创新部”,发布企业级大模型计划,重点押注AI+金融、AI+安全、AI+具身智能。

天玑实验室的负责人在接受采访时表示:“我们不想做空中楼阁的AI。我们想解决真实世界里,那些没人愿意做、但又特别重要的事——比如让机器学会人类的日常动作。”

目前,AoE技术已开放部分数据集供学术研究,部分合作企业正在测试其在物流分拣、老年陪护机器人等场景的应用。未来,不排除推出面向开发者和中小企业的低成本数据采集套件。

一个普通人,一部手机,一个20美元的支架,就能为下一代机器人提供“第一手经验”。这或许是AI走向真实世界最朴素、也最有力的一次转身。