通义实验室发布两款全新语音模型:一句话生成专业级声音

今天,阿里通义实验室正式推出两款全新的语音生成工具:Fun-CosyVoice3.5 和 Fun-AudioGen-VD。它们不是又一个“AI语音合成器”,而是真正能听懂你意思的声音助手——你只要说清楚想要什么,它们就能给你做出你想要的声音。

Fun-CosyVoice3.5:说句话,声音就变

如果你做过配音、播客,或者用过语音合成工具,你一定知道有多烦人——调参数、试音色、改语速,来回折腾半小时,结果还是不像人说的。

Fun-CosyVoice3.5 改变了这一切。你不需要懂什么“音高”“基频”“包络”,你只要说:“这句话说得再坚定一点”“语速慢点,带点疲惫感”“像个刚睡醒的人一样说”,它立刻就能调整出来,而且听起来自然得不像AI。

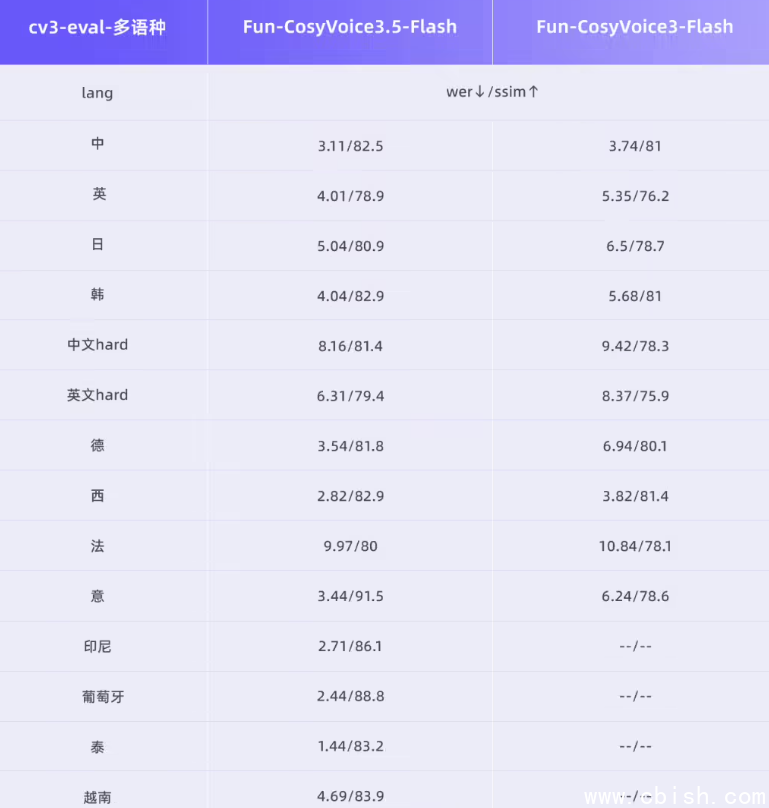

这次升级,不只是“更好听了”。它现在能准确念出泰语、印尼语、葡萄牙语和越南语——这些语言之前很多系统连基本发音都磕磕巴巴,现在它的转写准确率和音色还原度,已经稳居行业前列。更别说那些老是念错的生僻字,比如“龘”“犇”“靐”,以前错得离谱,现在错误率直接从15%降到5%以下,连方言区的用户都说:“这次真能听懂。”

响应速度也快了不少。首包延迟降低35%,意味着你在直播、语音助手、客服系统里用它,几乎感觉不到卡顿。不是“还能用”,而是“真能当人用”。

Fun-AudioGen-VD:你描述的场景,它直接给你配出声音

想象一下:你写了个游戏剧情——主角在暴雨夜的废弃教堂里,一边颤抖着念日记,一边能听见远处狼嚎和滴水声。你不用找音效师,不用去素材库翻半天,你只要在输入框里打:

“一个30岁左右的男性,声音沙哑,带着哭腔,边念日记边喘气,背景是大雨拍打铁皮屋顶,偶尔有风声和远处狼叫,空间感像在空旷教堂里。”

——然后,它就给你生成了。

Fun-AudioGen-VD 不只是生成人声,它是“声音导演”。你可以指定性别、年龄、口音,甚至细到“像老烟枪那种低沉带气音”“像刚哭完的高中生”。它能模仿客服的礼貌腔调,也能模拟播音员的沉稳,甚至能做出“表面镇定,其实手在抖”的心理层次——这种细节,以前只有专业配音演员才能做到。

环境音也不再是贴上去的背景噪音。它能自动匹配空间感:在浴室里说话有回声,在地铁站里声音被淹没,在水下听人说话是闷闷的、模糊的。这些都不是靠叠加音效,而是模型自己“理解”了空间和声学原理。

已经有独立游戏团队在试用。有人用它为一款恐怖游戏生成了12个不同角色的内心独白,全程没请一个配音演员,成本降了90%。还有播客主用它批量制作不同语气的开场白,一周内更新了20期,观众根本没发现是AI做的。

谁在用?为什么重要

这不是实验室的炫技。这两款工具,正在悄悄改变内容创作的底层逻辑。

独立创作者、小团队、教育机构、有声书制作人——他们不再需要花几千块请配音员,也不用买几十个音效包。一个普通人,用一句话,就能做出过去需要整个团队才能完成的声音内容。

如果你是做短视频的,你可以让AI用“东北大妈唠嗑”的语气讲科技新闻;如果你是做儿童教育的,可以让声音变成“温柔但有点调皮的老师”;如果你是做影视后期的,现在连环境音都能一键生成,省下几周剪辑时间。

通义实验室没说“全球首个”,也没吹“颠覆行业”。他们只是把复杂的东西,做成了简单到你根本不需要学就会用的样子。

这,才是真正的进步。