语音转文字新标杆:ElevenLabs 和谷歌双双登顶

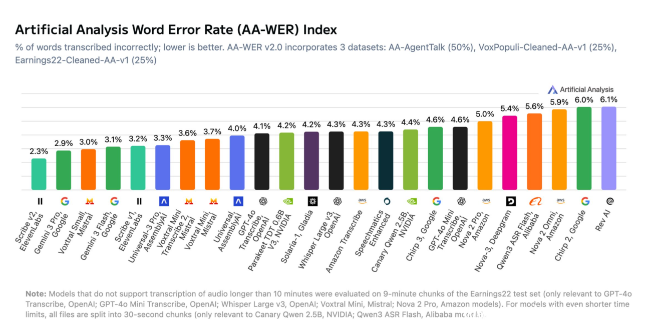

近日,AI评测机构 Artificial Analysis 推出了全新的语音转文字基准测试 AA-WER v2.0,结果出人意料又在情理之中——ElevenLabs 的 Scribe v2 和谷歌的 Gemini 3 Pro 凭借近乎完美的转录准确率,牢牢占据榜单前两名。

在衡量语音识别准确度的核心指标——词错率(WER)上,ElevenLabs 的 Scribe v2 以仅 2.3% 的错误率拿下第一。这个数字意味着每100个词里,平均只错不到3个,几乎接近人类听写水平。紧随其后的是谷歌的 Gemini 3 Pro,错误率为 2.9%。值得注意的是,谷歌并没有为转录任务专门优化过 Gemini 3 Pro,它的出色表现完全来自其强大的通用语言理解能力,这说明大模型的“通才”属性正在悄然改变语音识别的游戏规则。

其他主流模型的表现也颇具参考价值:

- Mistral 的 Voxtral Small 以 3.0% 错误率位列第三,开源社区的新星表现不俗;

- 谷歌 Gemini 3 Flash 以 3.1% 的错误率稳居第四,轻量版也能打,实用性很强;

- OpenAI 的 Whisper Large v3 作为过去几年最受开发者欢迎的开源模型,这次以 4.2% 的错误率排在中游,虽不再遥遥领先,但依然是免费方案中的首选;

- 而阿里巴巴的 Qwen3-ASR Flash(5.9%)、亚马逊的 Nova2 Omni(6.0%)和 Rev AI(6.1%)则明显落后,尤其在复杂口音、背景噪音或快速语速场景下,错误率偏高,商用落地仍有提升空间。

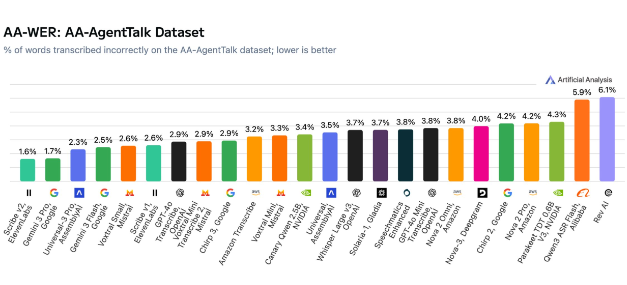

语音指令场景:Scribe 和 Gemini 几乎“听懂你的心声”

除了通用转录,AA-WER v2.0 还新增了针对语音助手的专项测试——AA-AgentTalk,专门评估模型对“打开导航”“播放周杰伦”“提醒我下午三点开会”这类短指令的识别能力。

结果更惊人:Scribe v2 在这类场景下错误率低至 1.6%,Gemini 3 Pro 为 1.7%。这意味着,在你对着手机喊“关灯”“定个闹钟”时,它们几乎不会听错。这不仅仅是技术参数的胜利,更是体验上的质变——用户不再需要重复指令、不再担心智能音箱“听不懂人话”。

反观一些传统语音服务商,即便在简单指令下仍会出现误识别,比如把“播放周杰伦”听成“播放周杰伦的歌”,或把“关掉空调”误判为“打开空调”。这些小错误在日常使用中累积起来,就是巨大的挫败感。

目前,Scribe v2 已向部分企业客户开放,而 Gemini 3 Pro 的语音能力正逐步接入 Google Assistant 和 Android 系统。如果你是内容创作者、播客编辑、客服系统开发者,或者只是厌倦了语音输入总是出错,这场技术竞赛的结果,或许值得你重新评估手中的工具。