智元发布GenieReasoner:让机器人“想得明白,做得精准”

2025年初,智元机器人推出GO-1大模型,引爆了具身智能领域的数据飞轮——机器人开始能看懂指令、理解场景、自主规划。但很快,工程师们发现一个扎心的问题:机器人“脑子”越来越聪明,手却总在关键时刻“掉链子”。

你可能见过这样的场景:机器人听懂了“把红色杯子放在蓝色托盘上”,也识别出了目标物体,可抓取时却歪斜、滑脱、甚至碰倒其他物品。这不是硬件问题,而是“脑手脱节”——视觉语言模型(VLM)和动作控制模块各自训练、互不沟通,一个在推理,一个在硬拼,结果谁也救不了谁。

今天,智元具身研究中心正式发布第二代一体化具身系统——GenieReasoner。这不是一次简单的升级,而是一场对机器人“神经架构”的根本性重构。

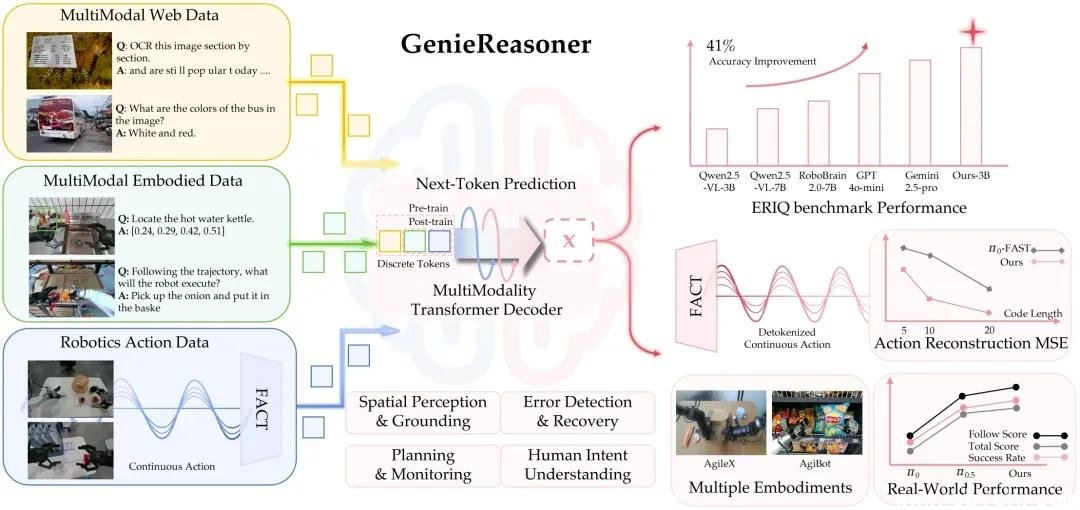

革命性突破:把动作“说”出来

传统机器人系统中,大脑(语言理解)和小脑(运动控制)像两个说不同语言的部门。VLM输出的是语义向量,控制器要的是毫秒级的关节力矩序列,两者训练目标截然不同,梯度互相打架,模型只能在“聪明”和“灵巧”之间二选一。

GenieReasoner的突破口,来自一个看似简单却极为巧妙的洞察:动作,也是一种语言。

团队首创“离散动作词表”技术,将连续的机械臂轨迹、抓取力、姿态变化,编码成一串类似文本Token的离散符号。在模型眼里,预测“抓取杯子”和预测下一个词“然后”没有本质区别——它们都在同一个语义空间里被联合训练。

这意味着,当机器人理解“把左边的工具递给穿蓝衬衫的人”时,语言推理和动作生成不再是两个模块接力,而是同步思考、共同输出。大脑不再只是“下命令”,而是和小脑一起“想象”整个动作流程。

精度不打折:FACT编解码器让离散动作重回高保真

但问题来了:如果动作被离散化,会不会像压缩图片一样丢失细节?过去十年,业内尝试过多种离散化方法,不是精度崩塌,就是算力爆炸。

智元团队带来的答案是FACT(Flow-matching Action Tokenizer)——一套基于流匹配(Flow Matching)的全新编解码架构。

不同于传统“映射标签”式的离散化,FACT把每个动作Token看作一条“概率路径”的起点。解码器不是简单查表还原动作,而是从标准高斯噪声出发,沿着一条学习好的连续概率流,逐步还原出毫米级精度的物理轨迹。

实测数据显示:在同等Token数量下,FACT的轨迹重建误差比当前最优离散方法(如π0-FAST)降低了**90%以上**,逼近纯连续模型的精度水平。换句话说,它既保留了语言模型的泛化推理能力,又拿回了工业级操作的稳定性和细腻度。

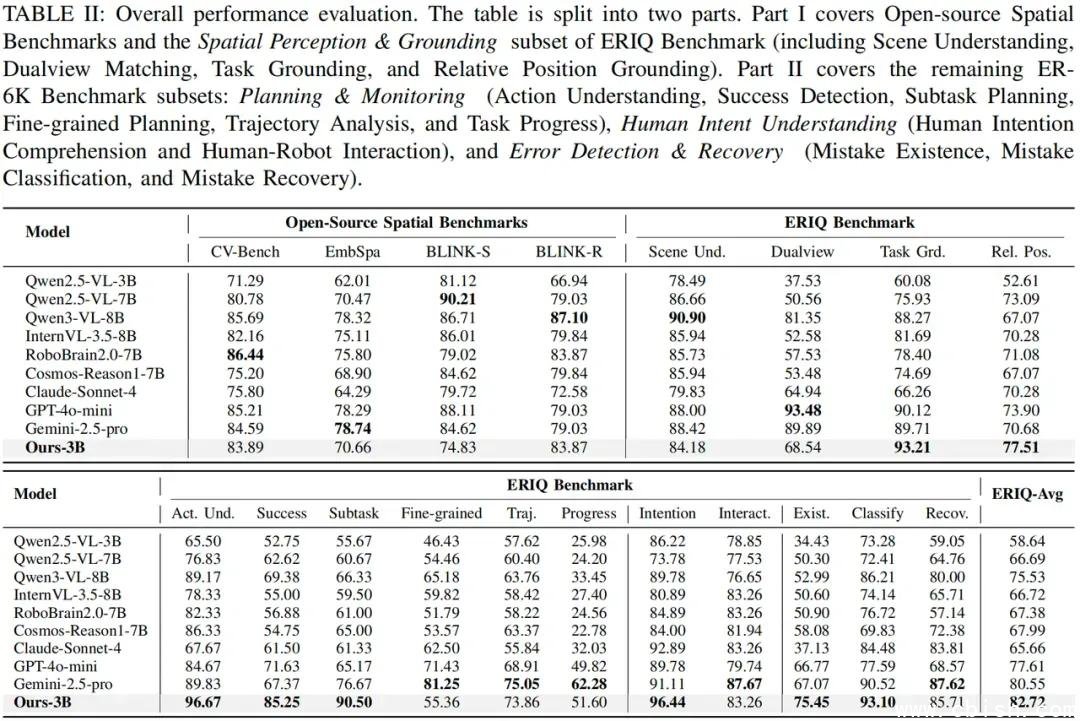

ERIQ评测基准:第一次,真正区分“看不懂”和“做不好”

过去,我们用“任务成功率”评价机器人,但这个指标太粗糙了。失败了?是没听懂指令?还是听懂了但手抖?根本分不清。

为此,智元同步开源了行业首个具身推理评测集——ERIQ(Embodied Reasoning and Instruction Quantification)。

ERIQ包含6,000+个真实场景样本,覆盖家庭、仓储、超市、工厂等100+种环境,题目形式为单选题或判断题,全部由人类专家标注审核。评估维度细分为四大类、15项子指标:

- 空间感知与定位(如“哪个物体在最里面?”)

- 任务规划与监测(如“先开抽屉,再拿工具”是否合理?)

- 错误识别与恢复(如“我拿错了,该怎么办?”)

- 人机协作理解(如“用户指了指,但没说话,该怎么做?”)

更惊人的是,实验发现:在ERIQ上得分高的VLM,实际操作成功率也显著更高。这首次用数据证明:“脑子好,手才稳”不是口号,而是可量化的因果关系。

真机实测:未知物体、颜色指令、极端姿态,全都能扛

技术再牛,也要上真机跑一跑。GenieReasoner已在智元多款机器人平台完成全面验证,包括AgiBot G1、ARX、AgileX等,测试场景覆盖五大类高难度挑战:

- 未知物体(从未训练过的工具、容器)

- 复杂颜色指令(“深灰偏蓝的杯子”、“接近橙色但更暗的那个”)

- 极端空间位姿(物体被遮挡、倾斜、堆叠)

- 语义模糊指令(“帮我拿一下那个东西”)

- 多步动态任务(“先倒水,等5秒,再关盖”)

对比测试结果令人震撼:

- 相比离散基线模型(π0-FAST),GenieReasoner在保持同等理解能力前提下,任务成功率提升**37%以上**;

- 相比连续基线模型(π0.5),在复杂颜色和新物体任务中,指令跟随准确率提升**52%**,且无一例“过度拟合”错误;

- 在“未知物体”任务中,其成功率首次突破78%,远超所有SOTA模型(平均约55%),真正实现“见过的会做,没见过的也能猜”。

未来已来:具身智能进入“统一架构”时代

GenieReasoner的意义,远不止于一个新模型。它验证了一个颠覆性观点:机器人不需要“大脑”和“小脑”两个系统,它们本该是一体的。

就像人类不需要分开训练“思考”和“伸手”,我们的神经网络天然融合感知、推理与运动。GenieReasoner第一次在工程层面实现了这种生物式的统一。

目前,GenieReasoner核心代码、FACT编解码器、ERIQ评测集已全部开源,模型权重开放申请。智元表示,下一步将推动该架构接入更多开源机器人平台,加速行业生态共建。

如果你曾为机器人“看得懂、做不好”而困扰,那么今天,答案来了。

项目主页:https://geniereasoner.github.io/GenieReasoner