OpenAI在ChatGPT Atlas的代理模式中推出安全更新,为浏览器代理引入新的对抗训练模型检查点,并强化周边防护机制。OpenAI表示,此次更新主要基于内部自动化红队演练发现了一类新型提示词注入攻击手法,因此提前修复,以降低代理在执行用户任务时被误导的风险。

所谓代理模式,是指系统可在用户浏览器中读取网页内容并代为点击、输入,也可能在处理邮件、文档或日历等工作流程中接触大量外部内容。OpenAI提醒,当代理能够在登录状态和既有工作上下文中执行操作时,攻击者可能将恶意指令嵌入邮件、附件、共享文档或普通网页中,诱使代理将不可信文本误认为应遵循的指令,从而偏离用户原本的意图。

OpenAI内部自动化红队演练发现了一类新型提示词注入攻击手法。以OpenAI演示的场景为例,攻击者可先向收件箱投放一封包含恶意指令的邮件,随后用户要求代理撰写外出自动回复时,代理在查阅未读邮件过程中被误导,反而向用户的上级或CEO发送辞职信,导致外出自动回复未能完成。也就是说,这种提示词注入攻击无需依赖传统网站漏洞,甚至不需要通过钓鱼诱导用户主动交互,也可能在日常办公流程中被触发。

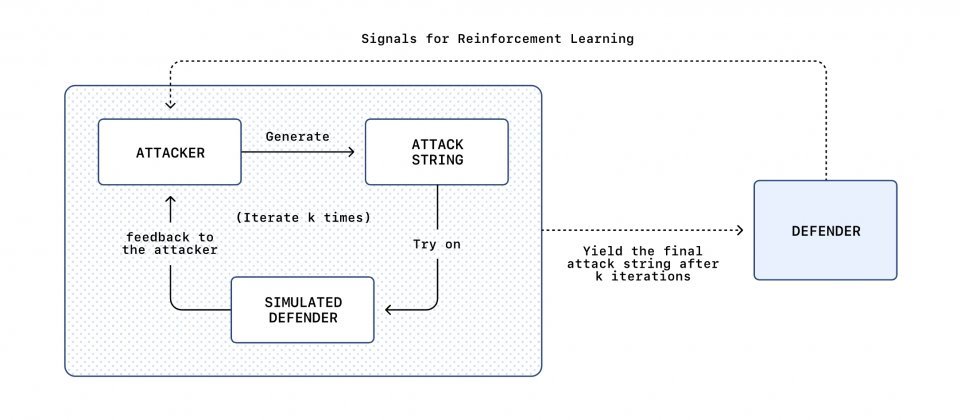

OpenAI已为Atlas浏览器代理推出安全更新,内容包括新版经过对抗训练的模型检查点,以及增强的周边防护措施。OpenAI还介绍了其自动化红队的运作方式:基于大型语言模型,通过强化学习训练自动攻击者,在模拟环境中反复试探各类提示词注入策略,并以目标代理的推理过程和操作轨迹作为反馈,快速识别出能够成功误导代理的方法。

当自动化红队发现新的有效攻击模式后,防御端会将这些案例纳入对抗训练,并利用攻击轨迹优化模型之外的防护体系,例如加强监控机制、在模型上下文中嵌入安全指令,以及部署系统层保护措施,使代理在接触不可信内容时更能优先遵循用户意图,并在执行关键操作前要求人工确认。

针对用户端的风险管理,OpenAI建议在任务不需要登录时尽量以登出或未登录状态运行,并在系统要求确认发送邮件、购买等高风险操作时仔细核对内容。OpenAI同时提醒,下达任务时应避免使用过于宽泛的指令,改用更明确、范围更小的描述,以降低不可信内容干扰代理判断的可能性。