中国AI公司DeepSeek近期发布最新研究成果DeepSeek-OCR,提出名为“光学压缩(Optical Compression)”的全新技术架构。这项技术旨在突破大语言模型(LLM)面临的长上下文瓶颈,使模型能够以极少量Token处理并理解超长篇文档图像,在不损失语义与结构信息的前提下,实现约10倍以上的上下文压缩率。

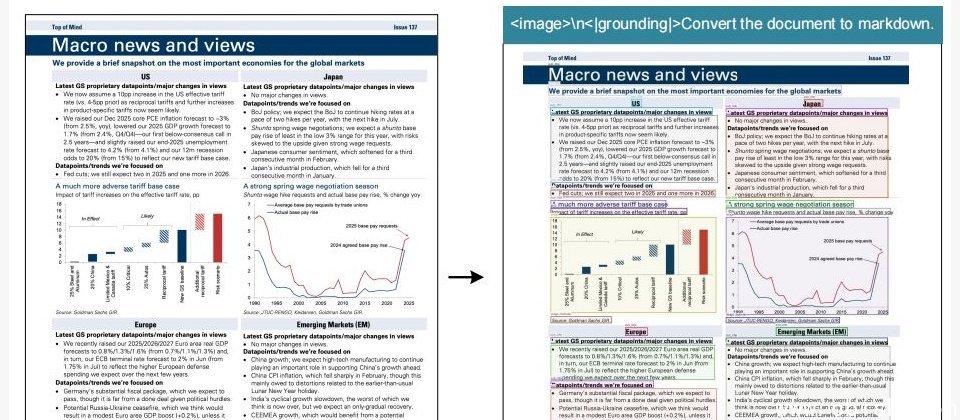

与传统OCR(光学字符识别)不同,DeepSeek-OCR并非单纯将图像中的文字转换为可编辑文本,而是通过语义层级的“视觉压缩”重构整份文档。系统的核心组件DeepEncoder会直接将整张文档图像转换为少量高密度的“视觉Token”,这些Token并非像素数据,而是携带语义与排版关系的表征向量。随后,由DeepSeek-3B-MoE解码器进行还原与重建,使模型得以在极低Token成本下重现完整文字、表格与图表信息。

论文指出,通过这种光学压缩策略,模型在仅使用64至100个视觉Token的情况下,便能准确重建出约600至1300个文字Token的内容,精度达96%至98%。当压缩比提高至20倍时,虽然细节部分略有损失,但语义主干依然可被正确识别。研究团队形容,这就像让AI“以理解的方式阅读文字”,而非逐字处理。

DeepSeek表示,这一技术不仅能大幅降低长上下文文本任务的计算开销,也为AI智能体与文档理解模型提供了新的设计思路。未来若结合多模态训练与长期记忆机制,光学压缩有望应用于法规文件、科研报告、金融报表等需要高效语义保留的长文本任务。

研究团队并指出,光学压缩的潜力不仅限于OCR领域,还可能成为下一代多模态AI的基础技术。通过以视觉为核心的压缩与理解方式,AI将能以更低的成本处理更庞大的信息量,开启真正意义上的超长上下文智能。