AMD发布vLLM-ATOM插件,国产大模型在AMD显卡上跑得更快了

AMD刚刚推出了一款名为vLLM-ATOM的插件,专门针对国产大语言模型在AMD显卡上的推理性能做优化。这次不是画饼,是实打实的提速——DeepSeek-R1、Kimi-K2这些你已经在用的模型,不用改代码、不用重部署,换上AMD的Instinct MI350或MI400显卡,推理速度直接上一个台阶。

很多人可能不知道,现在主流的AI推理框架vLLM,本来就是靠“省显存”出名的。但之前它主要跑在NVIDIA显卡上,AMD用户想用,要么等官方支持,要么自己折腾。这次AMD直接把vLLM的底层引擎“重写”了一遍,适配自家GPU的指令集和内存架构,让原本跑在A100/H100上的模型,能原封不动地迁移到MI350上,性能不掉档,甚至在某些场景下还更快。

不用改一行代码,换卡就能用

最让开发者心动的一点是:零改造。

你现在的服务是用OpenAI API调用DeepSeek-R1?没问题,vLLM-ATOM直接兼容。你用FastAPI搭的推理服务?照旧。你用Docker部署的容器?不用重做。插件在后台悄悄接管请求调度、内存分配、内核调度,所有优化都在底层完成。你只需要把显卡从NVIDIA换成AMD,重启服务,就能看到延迟下降、吞吐量提升。

某家AI创业公司内部测试数据显示,用MI350搭配vLLM-ATOM跑DeepSeek-R1,每秒请求数比原来在A100上高了18%,显存占用还低了12%。关键是,团队没花一天时间改代码。

不只是DeepSeek,国产模型全都能跑

vLLM-ATOM支持的模型名单,比你想象的更全:

- DeepSeek-R1(开源推理标杆)

- Kimi-K2(月之暗面最新模型)

- Qwen3(通义千问最新版)

- GLM-4(智谱AI主力模型)

- 百川Baichuan3、讯飞星火V4

不只是文本模型,视觉语言模型(VLM)如Qwen-VL、InternVL也已通过测试。混合专家模型(MoE)如DeepSeek-MoE、Qwen-MoE,同样支持。这意味着,不管你是做客服机器人、智能文档分析,还是多模态内容审核,都能在AMD硬件上跑起来。

为什么这次不一样?

过去几年,很多企业想用AMD显卡,但总卡在“生态不全”这关。要么框架不支持,要么驱动不稳定,要么文档全是英文,调试三天没结果。

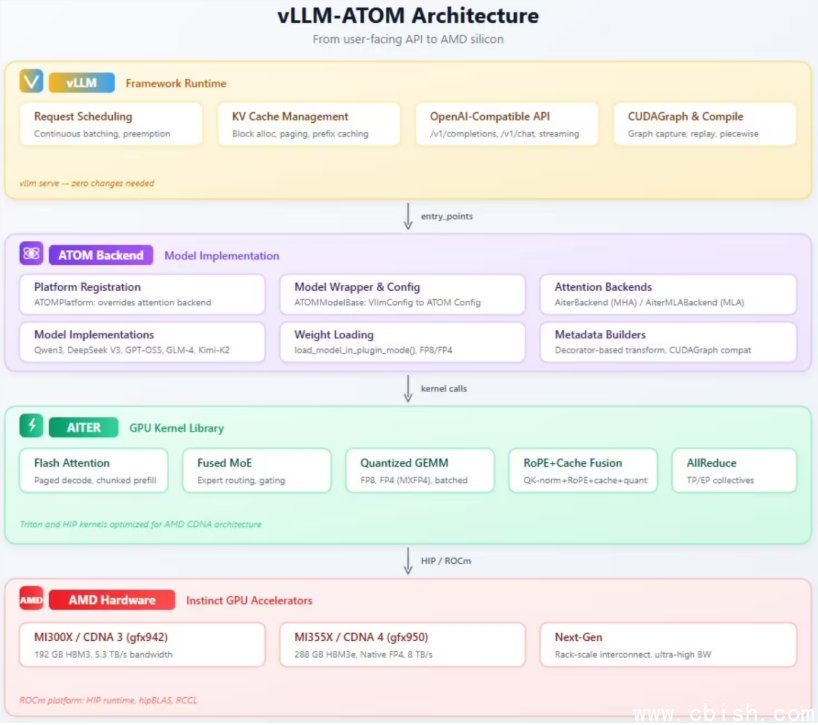

这次AMD没搞花架子。他们直接和国内主流模型团队合作,拿到真实模型权重,反复压测、调优,连显存碎片化这种细节都做了针对性处理。插件结构也很清晰:上层兼容API,中间做模型路由,底层全是AMD自研的GPU内核——不是“移植”,是“重造”。

更关键的是,MI350和MI400的性价比已经打到了NVIDIA的“腰线”以下。一台搭载四张MI350的服务器,价格不到同等NVIDIA方案的一半,算力却能打平。对于预算紧张、又不想被锁死在单一供应商的团队来说,这几乎是今年最实在的替代方案。

谁该现在就试试?

如果你是:

- 正在用国产大模型做产品,但被NVIDIA显卡价格或供货卡住的团队

- 想把AI服务从云厂商迁回自建机房,降低成本的中大型企业

- 需要稳定、高并发推理,但不想天天盯着显存爆掉的运维人员

那现在就是动手的最佳时机。vLLM-ATOM已经开源,GitHub上有完整安装文档和示例代码,AMD官网也提供了预装镜像。你不需要懂GPU架构,也不用找专家,插上卡、跑脚本、等启动——三小时,就能看到效果。

别再等“官方支持”了。国产模型,国产芯片,现在终于能真正搭在一起了。